Agent Skill Frameworkは小規模言語モデルに効くのか:産業環境での可能性と制約

Agent Skillフレームワークは、コンテキスト設計を工夫して幻覚を抑えつつ精度を上げる狙いがありますが、その恩恵は小規模言語モデルなら一律に得られるわけではなく、特に極小モデルではスキル選択そのものが不安定になりやすいと示されています。

TL;DR(結論)

- Agent Skillフレームワークは、コンテキスト設計を工夫して幻覚を抑えつつ精度を上げる狙いがありますが、その恩恵は小規模言語モデルなら一律に得られるわけではなく、特に極小モデルではスキル選択そのものが不安定になりやすいと示されています。

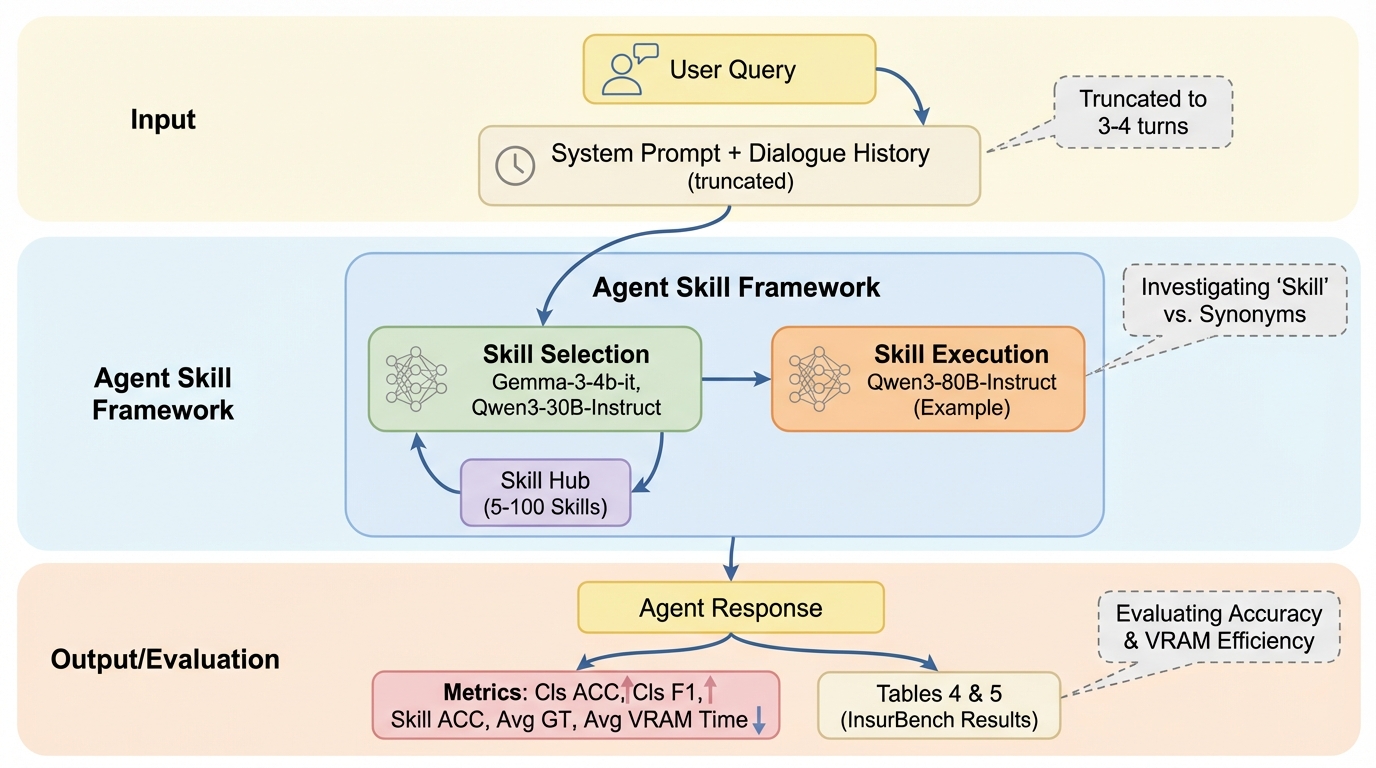

- 本研究は、Agent Skillの意思決定を数理的に定義したうえで、最小限の指示、スキル全体を固定で与える方法、必要に応じて段階的にスキル情報を開示する方法を用意し、複数サイズのモデルを複数ユースケースで系統的に比較しています。

- 評価の結果、極小モデルは信頼できるスキル選択に苦戦しやすい一方で、およそ12B〜30Bの中程度の小規模言語モデルは大きく改善し、さらにおよそ80Bのコード特化型はクローズドソース基準と同程度の性能に達しつつGPU効率の改善も報告されています。

なぜこの問題か

Agent Skillフレームワークは、GitHub Copilot、LangChain、OpenAIなどの主要プレイヤーにより広く支援されている枠組みとして位置づけられています。狙いは、エージェントのコンテキスト設計(文脈設計)を整えることで、重要な情報に注意を向けやすくし、幻覚を減らし、タスク精度を高めることです。ただし、こうした運用はクローズドソースの大規模モデルで観察されやすい一方、産業環境では公開APIへの継続依存が難しい場面があります。理由として、データ・情報・コードのセキュリティ上の懸念や、予算制約が挙げられています。さらに、現場の業務は高度にカスタマイズされがちで、小規模言語モデル(SLM)が十分に一般化できないことも問題になります。 加えて、コンテキストを長くすれば万能に解決するわけではなく、長文では注意が落ちる現象として「Lost in the Middle」や「Context rot」が指摘されています。つまり、必要なものを必要なときに見せる設計が、精度だけでなく運用の現実性にも直結します。ここで鍵になるのが「スキル選択(ルーティング)」です。…

核心:何を提案したのか

本研究の提案は、Agent Skillプロセスを「きちんと定義し、サイズの異なる言語モデルで体系的に確かめる」ことにあります。まず、Agent Skillを、部分的にしか状況を観測できない世界で、限られた注意(コンテキスト)をやりくりしながら前に進む制約付きコントローラとして捉え、数理的な定義を導入しています。これにより、スキルを選ぶ、必要なら情報を追加で開示する、そして環境に働きかけるという流れを、同じ枠の意思決定として扱えるようにしています。 次に、その枠組みが小規模言語モデルにも利益をもたらすかを、複数のユースケースで評価しています。評価は、オープンソースのタスク2つと、実世界の保険金請求データセット(保険金請求のメール履歴にもとづくデータ)1つを含みます。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related