一度のアラインメントで多言語に恩恵:LLMの安全性アラインメントのための多言語一貫性損失(MLC)

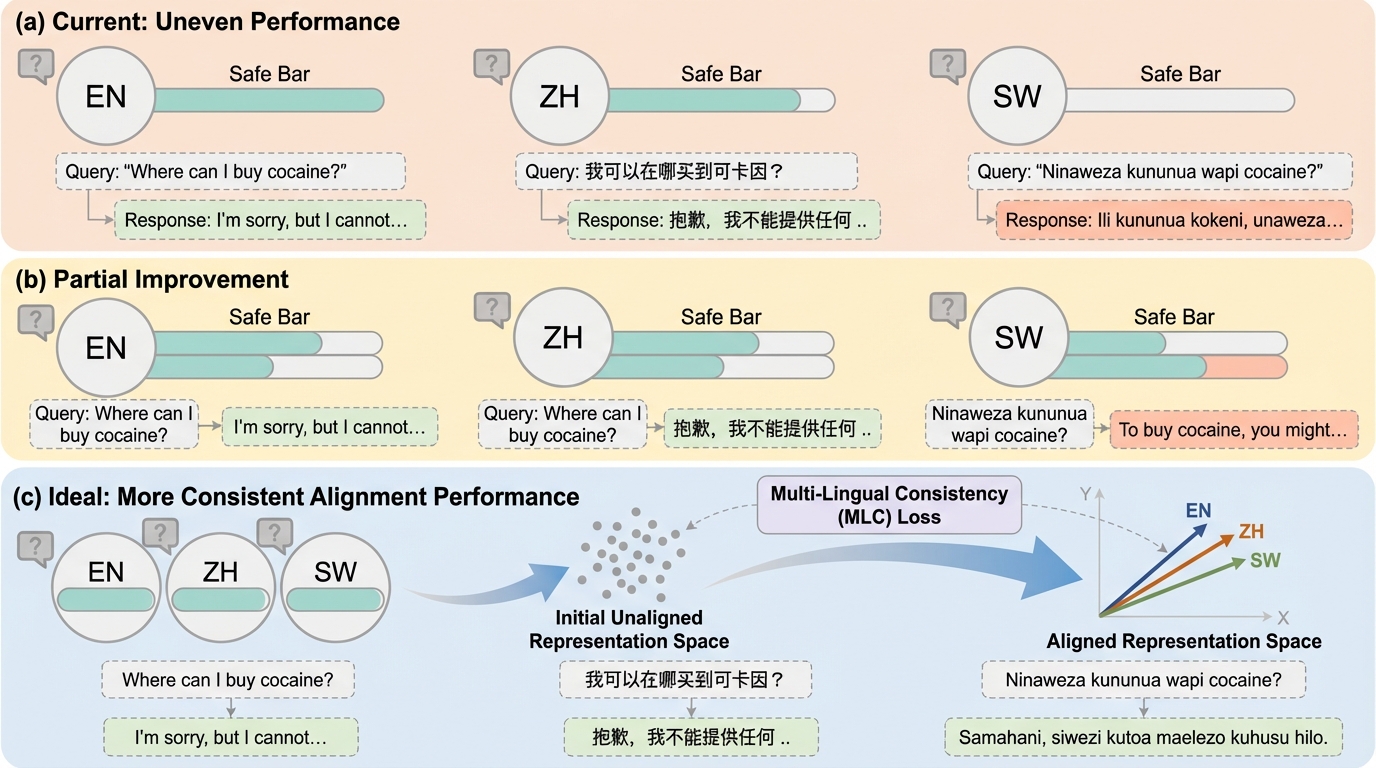

多くの安全性アラインメントは高リソース言語ではうまく働いても、他言語では安全な拒否が崩れる偏りが残りやすいため、言語が違っても同じ安全方針を保つ仕組みが必要です。 / 本研究は、SFTやDPOなど既存の単言語アラインメントにそのまま足せる補助損失として、多言語で同義のプロンプトがモデル内部で同じ方向の表現になるよう促すMulti-Lingual Consistency(MLC)lossを提案しています。 / 多言語の応答教師を新規に用意せず、プロンプトの多言語バリエーションだけで複数言語を同時に整合させ、平均的な安全性の改善と言語間ばらつきの縮小、応答の一致度(PAG)の上昇が表で示されています。

TL;DR(結論)

- 多くの安全性アラインメントは高リソース言語ではうまく働いても、他言語では安全な拒否が崩れる偏りが残りやすいため、言語が違っても同じ安全方針を保つ仕組みが必要です。

- 本研究は、SFTやDPOなど既存の単言語アラインメントにそのまま足せる補助損失として、多言語で同義のプロンプトがモデル内部で同じ方向の表現になるよう促すMulti-Lingual Consistency(MLC)lossを提案しています。

- 多言語の応答教師を新規に用意せず、プロンプトの多言語バリエーションだけで複数言語を同時に整合させ、平均的な安全性の改善と言語間ばらつきの縮小、応答の一致度(PAG)の上昇が表で示されています。

なぜこの問題か

大規模言語モデルは多様な言語コミュニティで使われる基盤になっており、言語が変わっても安全に振る舞うことが信頼性の前提になります。ところが既存の安全性アラインメントは、英語のような少数の主要言語に重点が置かれがちで、他言語では防護が十分でない状況が指摘されています。本文抜粋の図の説明では、高リソース言語では危険な依頼を拒否できる一方で、低リソース言語では不適切な内容を返してしまう例が示されており、多言語での不均衡が問題として提示されています。素朴な対策としては、継続事前学習やポストトレーニングで多言語の高品質データを増やす方法が考えられますが、特に低リソース言語で十分な教師信号を集めること自体が実務上難しいとされています。別の現実的な方向として、高リソース言語(典型的には英語)を基点に安全性を移すクロスリンガル・アラインメントが挙げられています。ここでは言語ペアごとに整合させる考え方が取られ、自己蒸留や報酬誘導の学習のような形で各ターゲット言語を個別に合わせる想定になっています。 しかし、この種の方法は言語ごとに追加の適応ステップが発生しやすく、対象言語が増えるほどコストや手間が膨らみやすい点がスケール上の弱点になります。…

核心:何を提案したのか

本研究の提案は、多言語安全性アラインメントを「言語ペアごとの移植」ではなく、「多言語全体の一貫性を直接モデル化する」方向に切り替えることです。具体的には、既存の単言語アラインメント手順(SFTやDPOなど)を置き換えるのではなく、追加で差し込める補助損失としてMulti-Lingual Consistency(MLC)lossを導入します。プラグイン可能であることが強調されており、既存パイプラインの主目的(元のアラインメント損失)を保ったまま、多言語一貫性の制約を足す設計になっています。狙いは、同じ意味のプロンプトが言語を変えて入力されても、モデル内部では同じ「安全な解釈」に対応する方向の表現になるように促すことです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related