論文級の科学図を“自動で整える”AutoFigure入門

科学の図は、なぜ作るのにこんなに時間がかかるのでしょうか? ボトルネックは「描く」だけでなく、「構造」と「見栄え」を両立する設計にあります。単に要素を並べるのではなく、読み手が迷わず理解できる流れと、ぱっと見て受け入れられる整い方を同時に満たす必要があるからです。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

科学の図は、なぜ作るのにこんなに時間がかかるのでしょうか? ボトルネックは「描く」だけでなく、「構造」と「見栄え」を両立する設計にあります。単に要素を並べるのではなく、読み手が迷わず理解できる流れと、ぱっと見て受け入れられる整い方を同時に満たす必要があるからです。

プリプロで「このカット、成立する?」を最短で確かめるにはどうすればいいのでしょうか。 頭の中では見えているのに、チームに伝えた瞬間に“別の映像”へ変換されてしまう――そんなズレを減らす手段は、いつも不足しています。そこには、アイデアの鮮度が高いほど言葉や静止画だけではこぼれ落ちやすい、という制作のジレンマがあります。

継続学習で「昔のタスクのデータなし」に、どうやって忘却を防ぐのでしょうか。 鍵は追加データでも特別な記憶でもなく、事前学習済みネットワークに潜む“幾何学的な余り”でした。 この記事では、PLATEがどんな発想で更新を制御し、可塑性と保持のトレードオフを扱おうとしているのかを追います。

LLMが「相談相手」から「意思決定の相棒」になったとき、いちばん怖い落とし穴は何でしょうか? それは誤答そのものよりも、流暢な同意がそのまま“判断”に見え、いつのまにかチームの決定を押し流してしまうことです。

Infinite-Worldは、現実世界の複雑な環境において1000フレームを超える長期的な視覚的一貫性を維持できる、堅牢なインタラクティブ世界モデルです。階層的ポーズフリーメモリ圧縮器(HPMC)により、過去の情報を固定のメモリ予算内に再帰的に凝縮することで、計算コストを抑えつつ幾何学的な事前知識なしで長期的な空間的一貫性を実現しました。不確実性を考慮したアクションラベル付けと、30分程度の高密度な再訪問データセットを用いた学習戦略により、ノイズの多い現実の動画データからでも正確な操作性とループクローズ能力を効率的に獲得することに成功しました。

難問で、LLMはどうやって“学ぶための手がかり”を手に入れるべきなのでしょうか? 正解が出ないなら強化学習は止まり、模範解答を真似ても逆に崩れる──ここが意外な落とし穴です。 この記事では、専門家の解答を“学習可能な推論”へ変換して使うDAILの狙いと仕組みを、論文の範囲で追います。

狙いは、三段論法のような形式推論を、語の意味的もっともらしさに引っ張られず評価できるようにすることです。 / そのために、抽象入力で得られる内部表現を「抽象アクティベーション空間」として定義し、内容つき入力の推論中にその空間へ表現を寄せる介入を行います。 / 結果として、Chain-of-Thought より bias-penalised accuracy で強く、SFT と比べても重みを変えずに内容依存の推論バイアスを抑えられる可能性を示しています。

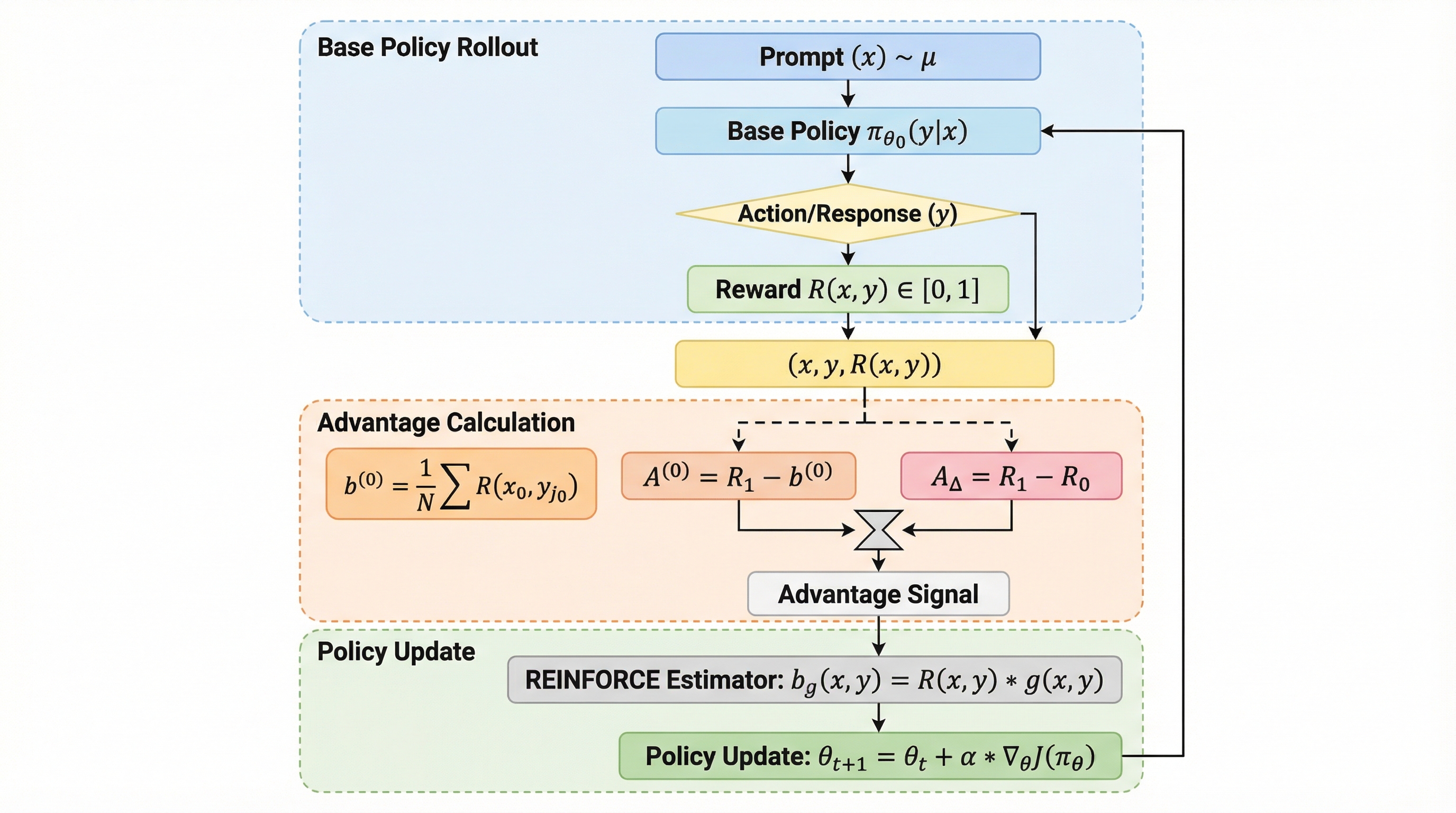

あなたは「一発で良い答え」を求めるのに、学習中のLLMはなぜ“やり取り”に頼りがちなのでしょうか? 実は、RLの学習信号は「正解/不正解」の1ビットに近く、豊かな改善の手がかりを捨てている可能性があります。

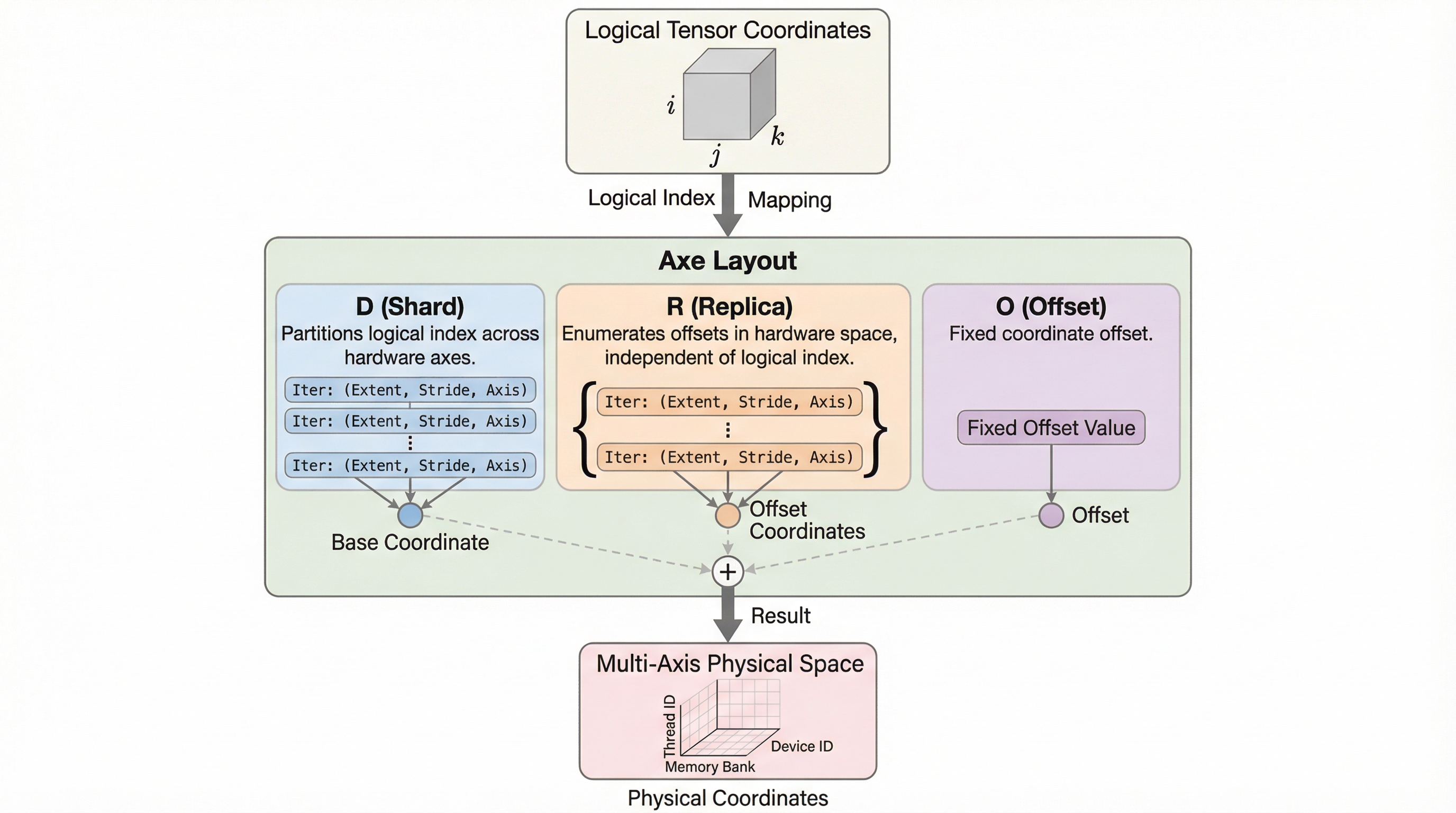

モデルの「分散」と「カーネル最適化」は、同じ言葉で語れないまま別々に進化してきたのでは? 分散はデバイスメッシュの上で語られ、カーネルはスレッドやメモリ階層の上で語られる──その“距離”が、最適化の議論そのものを難しくしているようにも見えます。

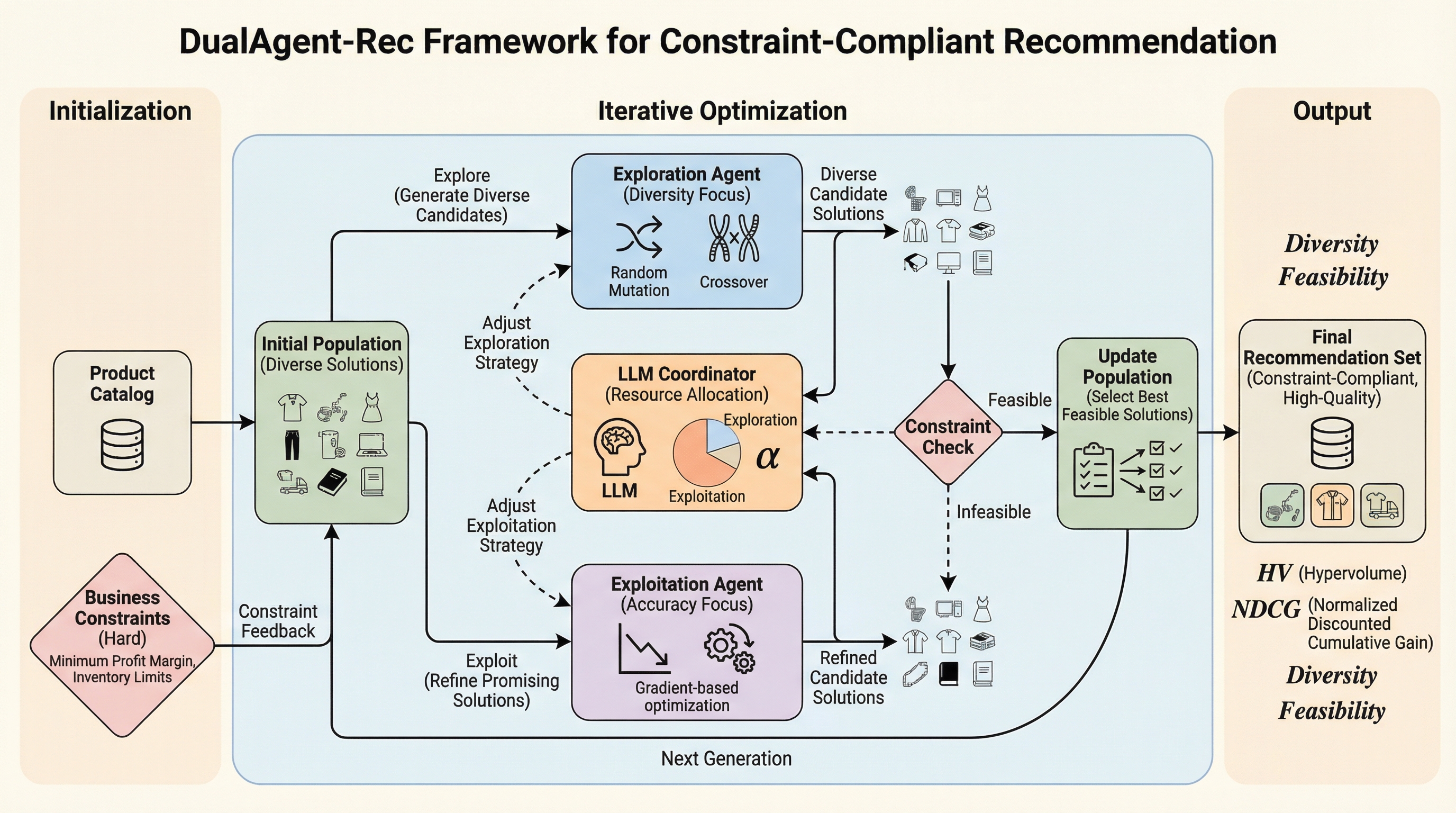

DualAgent-Recは、LLMを高度なオーケストレーターとして活用し、推薦精度と多様性の最適化、および公平性や出品者カバレッジといった厳しいビジネス制約の完全な遵守を両立させる新しいマルチエージェント・フレームワークです。