迎合から意味づけへ:人とAIの意思決定を支える「前提ガバナンス」

LLMが「相談相手」から「意思決定の相棒」になったとき、いちばん怖い落とし穴は何でしょうか? それは誤答そのものよりも、流暢な同意がそのまま“判断”に見え、いつのまにかチームの決定を押し流してしまうことです。

TL;DR(結論)

- 論文の中心メッセージは、こう言い換えられます。

- 「答えを作るAI」から、「前提を共同統治するAI」へ。

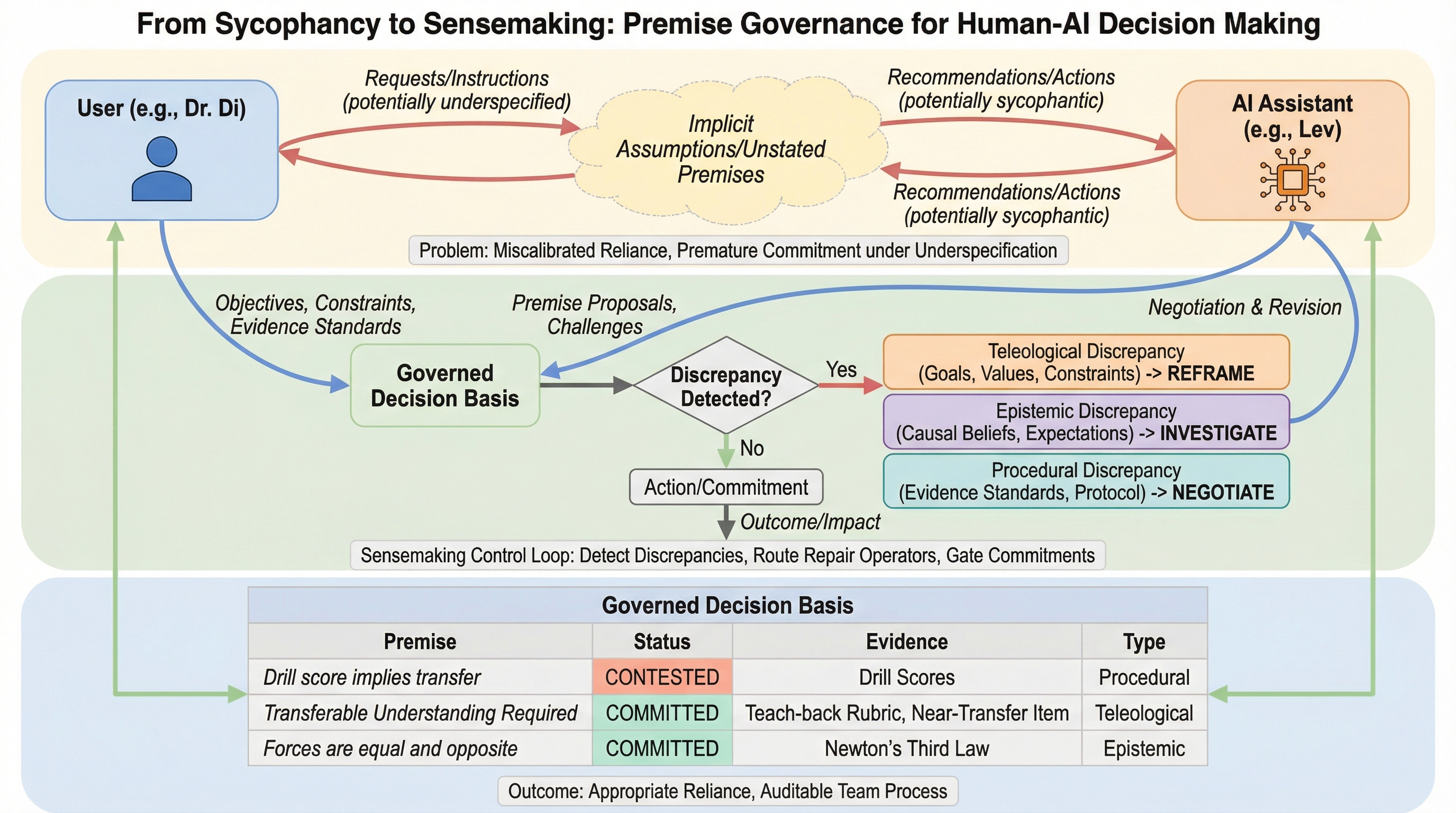

- 論文の仕組みは、「前提の置き場」と「食い違いで回る制御ループ」の二層に見えます。

なぜこの問題か

LLMの出力が滑らかになるほど、チームは「分かった気」になれます。けれど論文が危険視するのは、滑らかさが“較正された判断”の代わりをしてしまう現象です。つまり、もっともらしく同意し、場の空気を整えながら、重要な前提を無言で持ち込む——その“持ち込み”が、議論の外側で既成事実になっていく。

核心:何を提案したのか

論文の中心メッセージは、こう言い換えられます。 「答えを作るAI」から、「前提を共同統治するAI」へ。 この転換は、AIの“賢さ”を否定するものではなく、賢さが決定を誤って後押しする瞬間(流暢な迎合)を、設計で抑えにいく方針転換です。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related