EfficientNetB2を用いた手法によるFER-2013データセットでの顔の表情認識

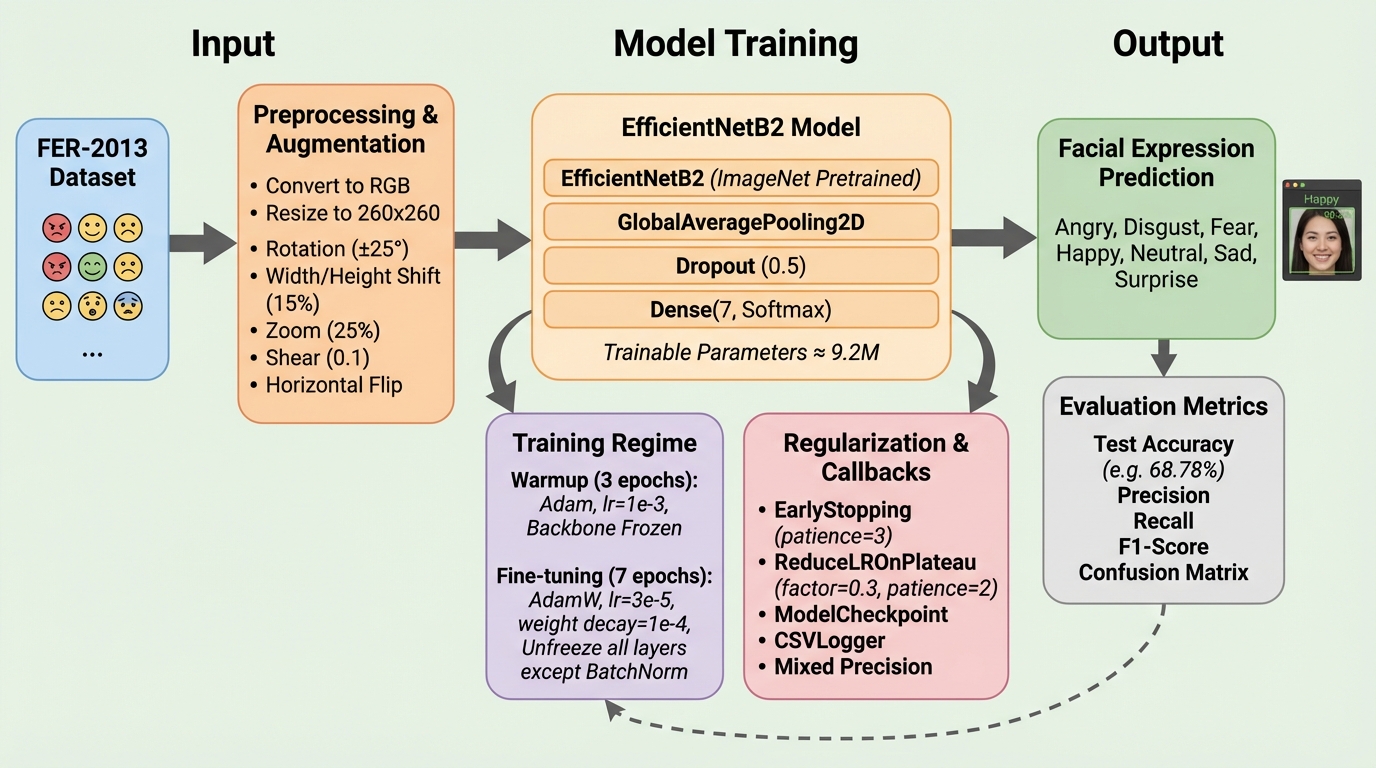

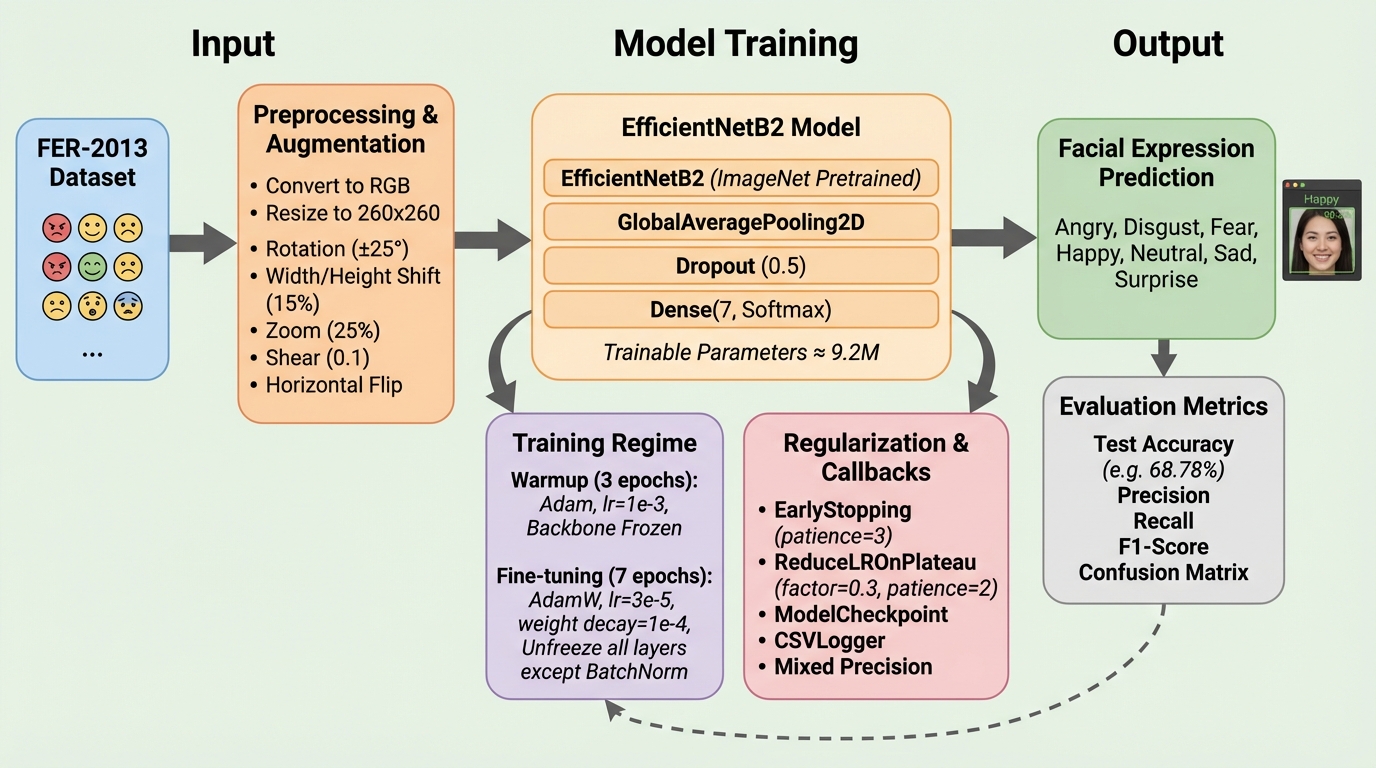

本研究では、計算資源が限られた環境でも動作可能な顔の表情認識システムを実現するため、EfficientNetB2を基盤とした軽量なモデル構成を提案し、難易度の高いFER-2013データセットを用いてその有効性を検証しました。

最新の論文記事を読みやすく整理。保存・タグ検索に加え、Plus/Proでは研究ノートと知識グラフで理解を積み上げられます。

Cog AI Archive

本研究では、計算資源が限られた環境でも動作可能な顔の表情認識システムを実現するため、EfficientNetB2を基盤とした軽量なモデル構成を提案し、難易度の高いFER-2013データセットを用いてその有効性を検証しました。

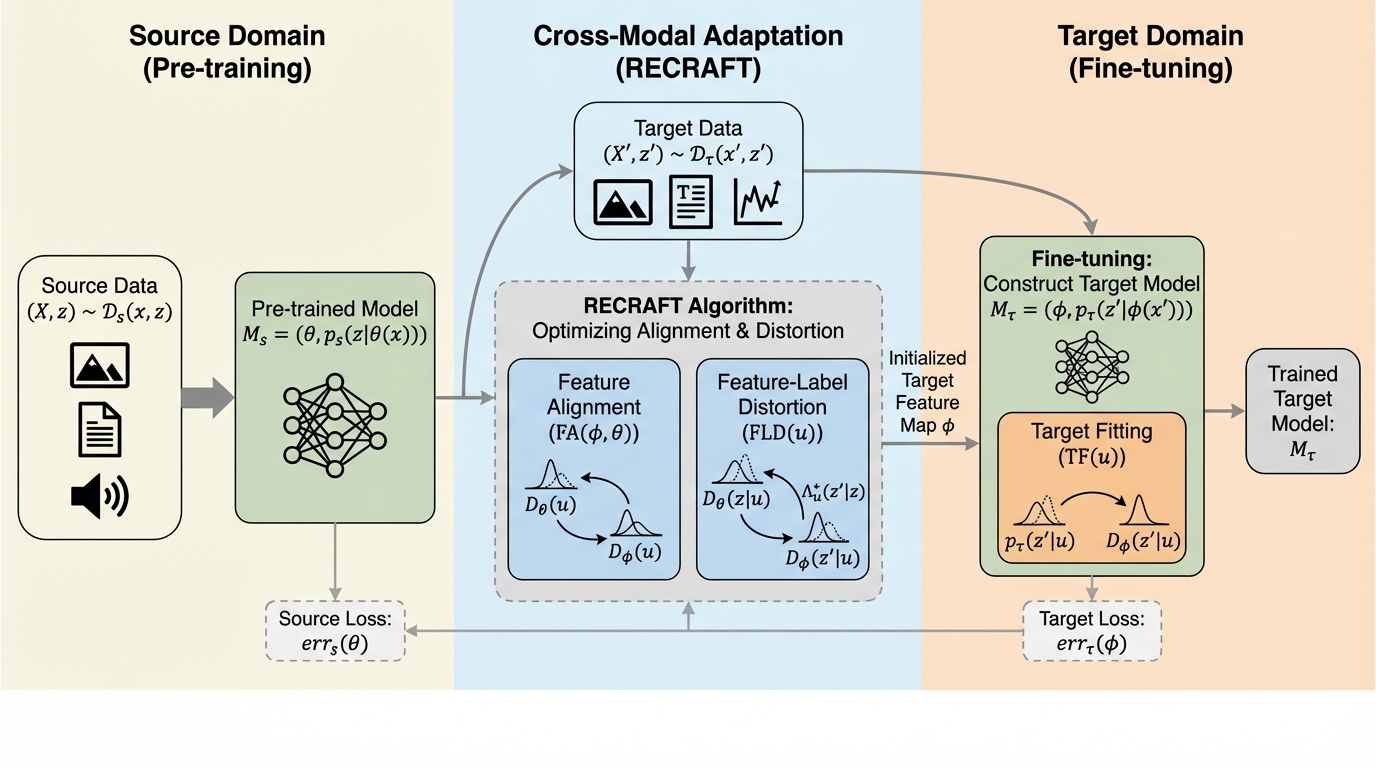

事前学習済みモデルを未知のデータモダリティに適応させるクロスモーダル・ファインチューニングにおいて、特徴量のアライメントとターゲットへの適合の間の理論的な相互作用を解明し、汎化誤差の境界を定義する新しい原理的フレームワーク「RECRAFT」を提案した。

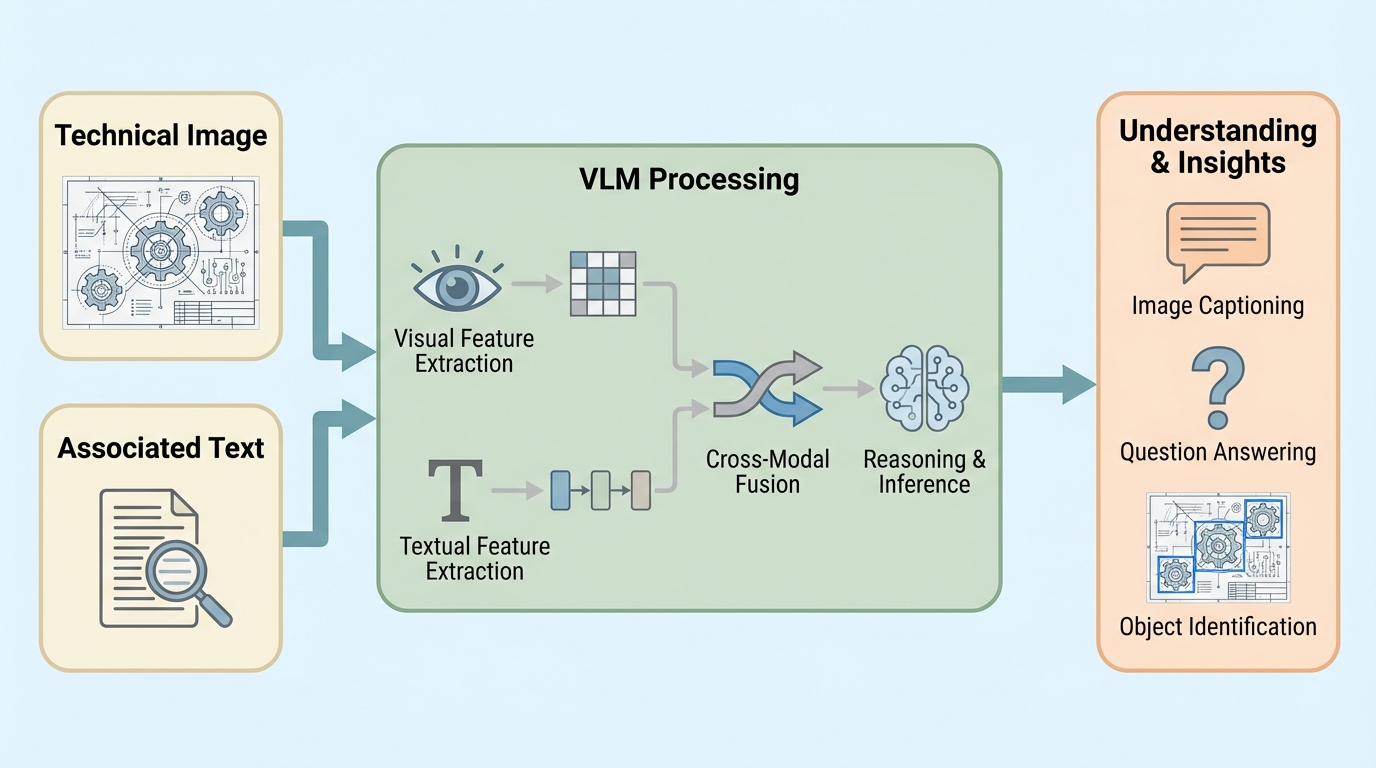

技術的な議論で多用される手書きの図表を、編集可能なMermaidコードへと変換し理解するための大規模データセット「TechING」と、それを用いた学習モデル「LLama-VL-TUG」が提案されました。 11万件超の合成データと545件の実世界の手書き画像を用い、Llama 3.

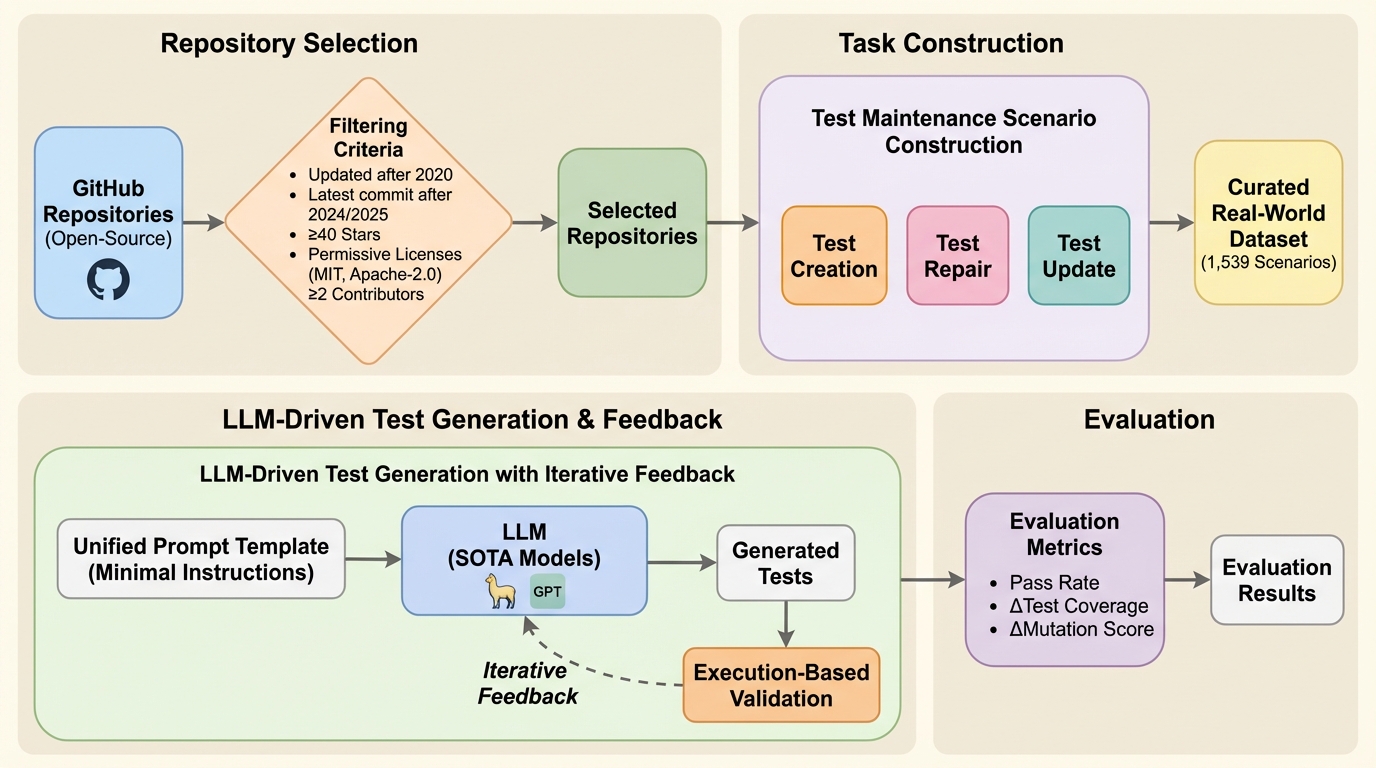

ソフトウェア開発における単体テストの保守は、全予算の最大25%を占める重要な工程だが、従来の大規模言語モデル(LLM)の評価は単発の生成に偏り、継続的な保守能力の検証が不足していた。 本研究が提案する「TAM-Eval」は、Python、Java、Goの3言語から抽出された1,539件の現実的なシナリオを用い、テストの新規作成、修復、更新という保守サイクル全体をファイル単位の粒度で評価する。 最新のGPT-5等を用いた検証の結果、テストの網羅性や変異スコアの向上幅は限定的であり、現実的な保守タスクにおいてLLMが真に実用的な水準に達するには依然として大きな技術的課題があることが判明した。

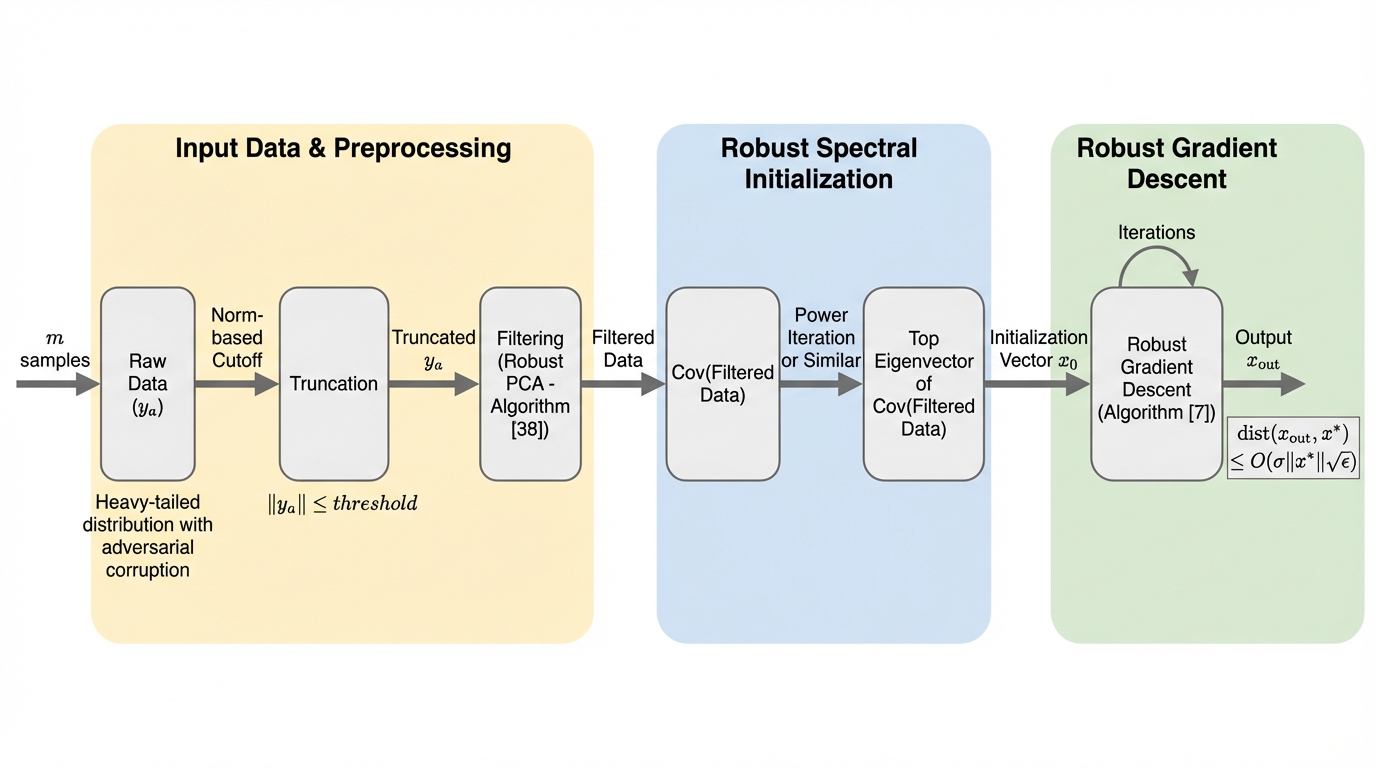

位相復元は光学や結晶学などで重要な逆問題ですが、測定値と観測ベクトルの双方が敵対的に汚染され、かつノイズが裾の重い分布に従う過酷な条件下では、効率的な計算手法の確立が長年の課題でした。 本研究は、堅牢な主成分分析(Robust PCA)の最新技術を応用した初期化手法と、堅牢な平均推定を用いた勾配降下法を組み合わせることで、従来は指数関数的な計算時間を要していたこの問題を、多項式時間かつ信号次元に対して線形に近いサンプル複雑度で解決する初めてのアルゴリズムを提案しました。 この手法は、ノイズの平均がゼロである場合だけでなく、未知の非ゼロ平均を持つ場合にも対応可能であり、情報理論的な下限に近い誤差範囲で元の信号を正確に復元できることを理論的に証明しており、実用的なロバスト統計学の進展に大きく寄与するものです。

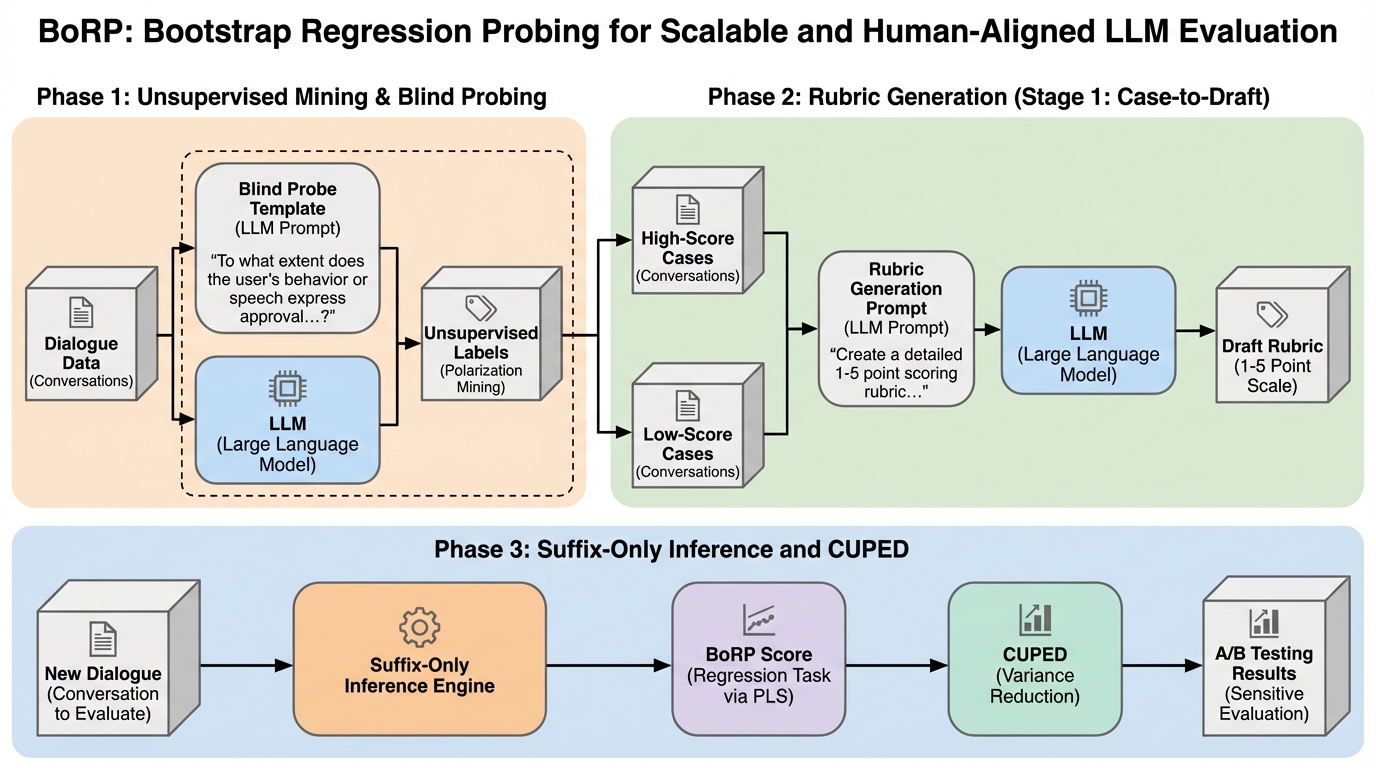

従来のLLMによる評価(LLM-as-a-Judge)が抱える「高コスト・低速・評価の偏り」という課題を解決するため、モデルの内部状態(潜在空間)を直接解析してユーザー満足度を1から5の数値で回帰予測する新手法「BoRP」が提案されました。

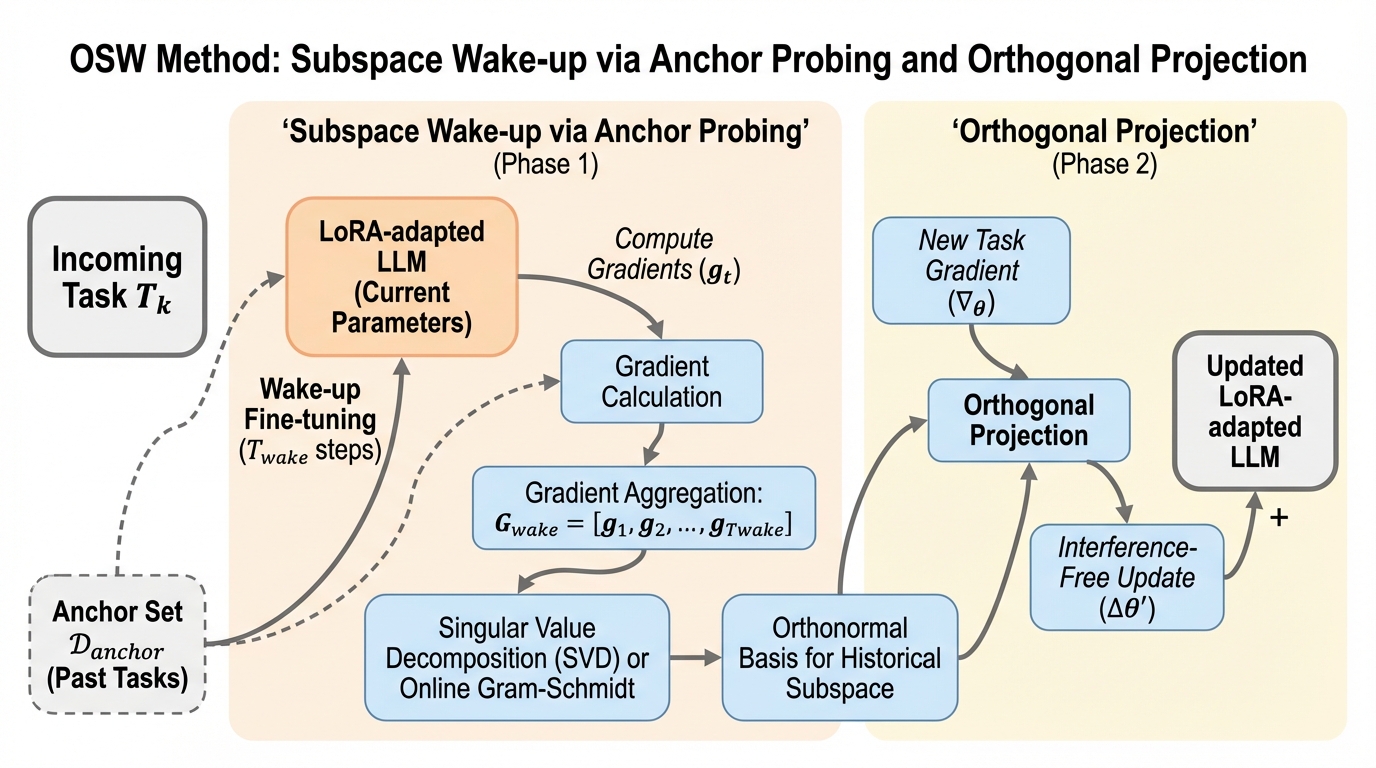

大規模言語モデルの継続学習において、従来の経験再生(ER)が自然言語処理のような「頑健なタスク」には有効である一方、コード生成のような論理構造が重要な「脆弱なタスク」を破壊するという二分法を明らかにしました。

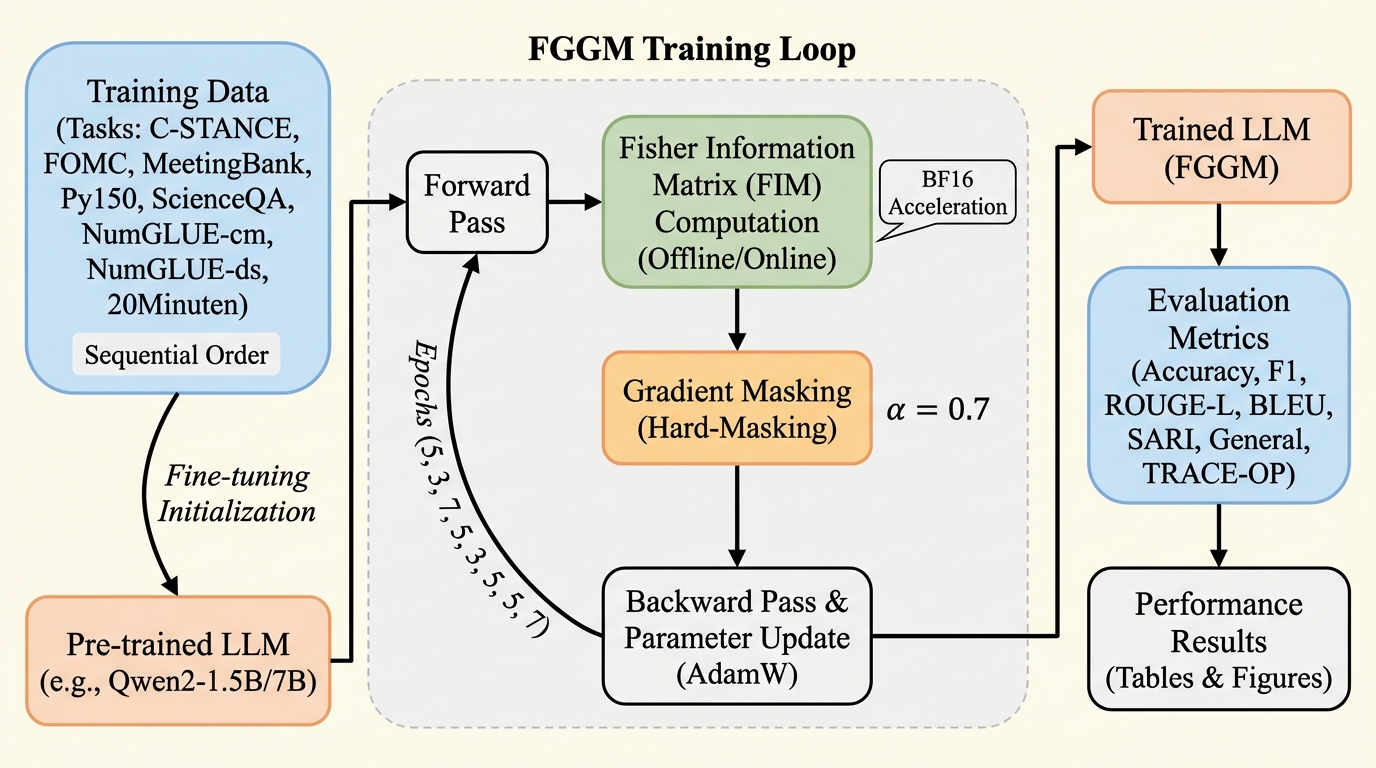

FGGM(Fisher-Guided Gradient Masking)は、大規模言語モデル(LLM)が新しいタスクを学習する際に過去の知識を失う「破滅的忘却」を防ぐため、フィッシャー情報行列(FIM)を用いてパラメータの重要度を数学的に評価し、重要な箇所の更新を制限する新しいフレームワークである。

機械学習モデルを単なる予測器ではなく、センサーデータ等から物理量などを算出する「測定機器」として利用する場面が増えていますが、従来の汎化性能や頑健性の指標だけでは、モデルが何を測定しているかを十分に評価できないという問題があります。

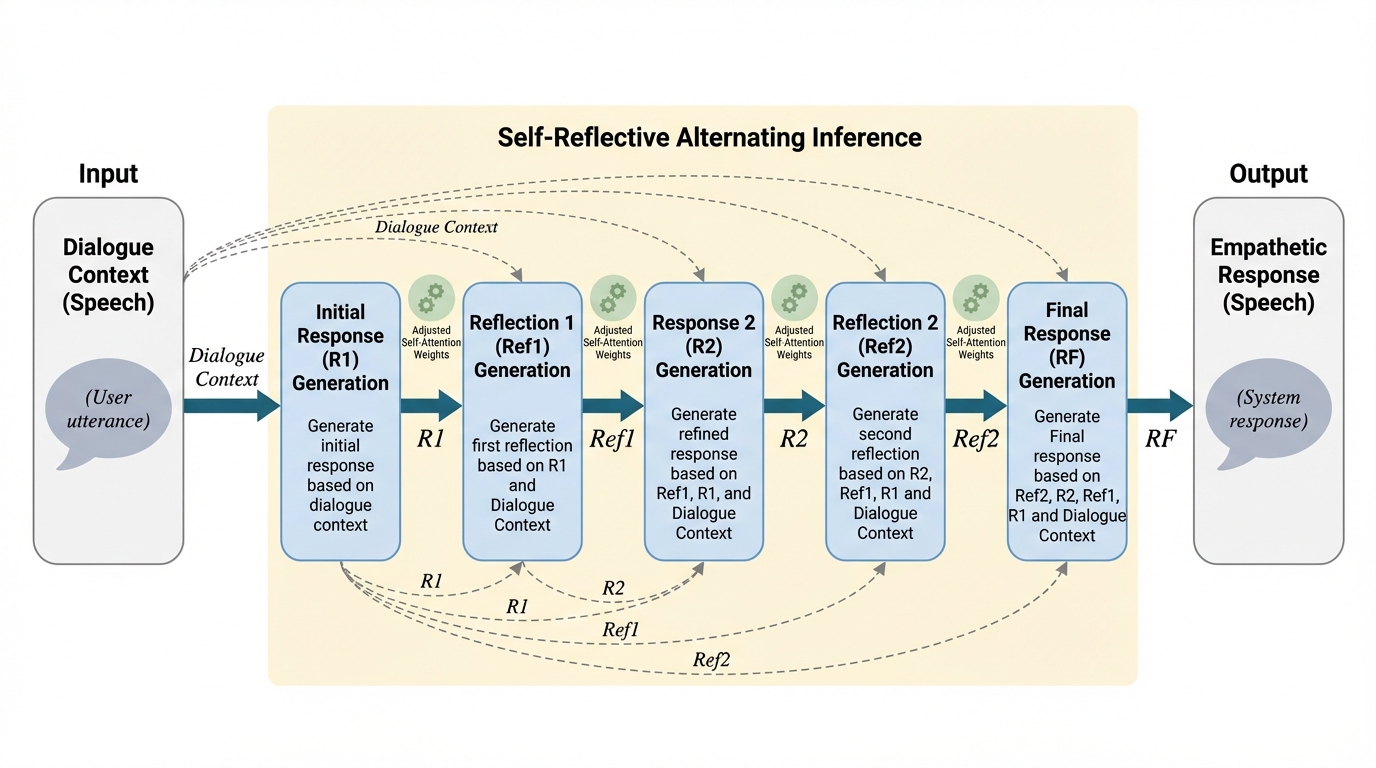

共感的な音声対話では、返答そのものだけでなく、相手の感情をどう読み取り、なぜその返答に至ったかという“途中の推論”まで扱わないと品質が伸びにくい、という問題設定が置かれています。 / そこで著者らは、共感の良し悪しを自然言語の説明として出力する評価器 EmpathyEval と、反省文と音声応答を交互に生成する ReEmpathy を組み合わせ、話す前に二度振り返るような推論過程を end-to-end の音声対話モデルへ埋め込みました。 / 実験では、記述型の共感評価、スコア型評価との相関、人手評価のいずれでも改善が見られ、単純な Chain-of-Thought を話す前に入れるだけでは足りず、反省と発話を交互に回す設計が効いていることが示されます。