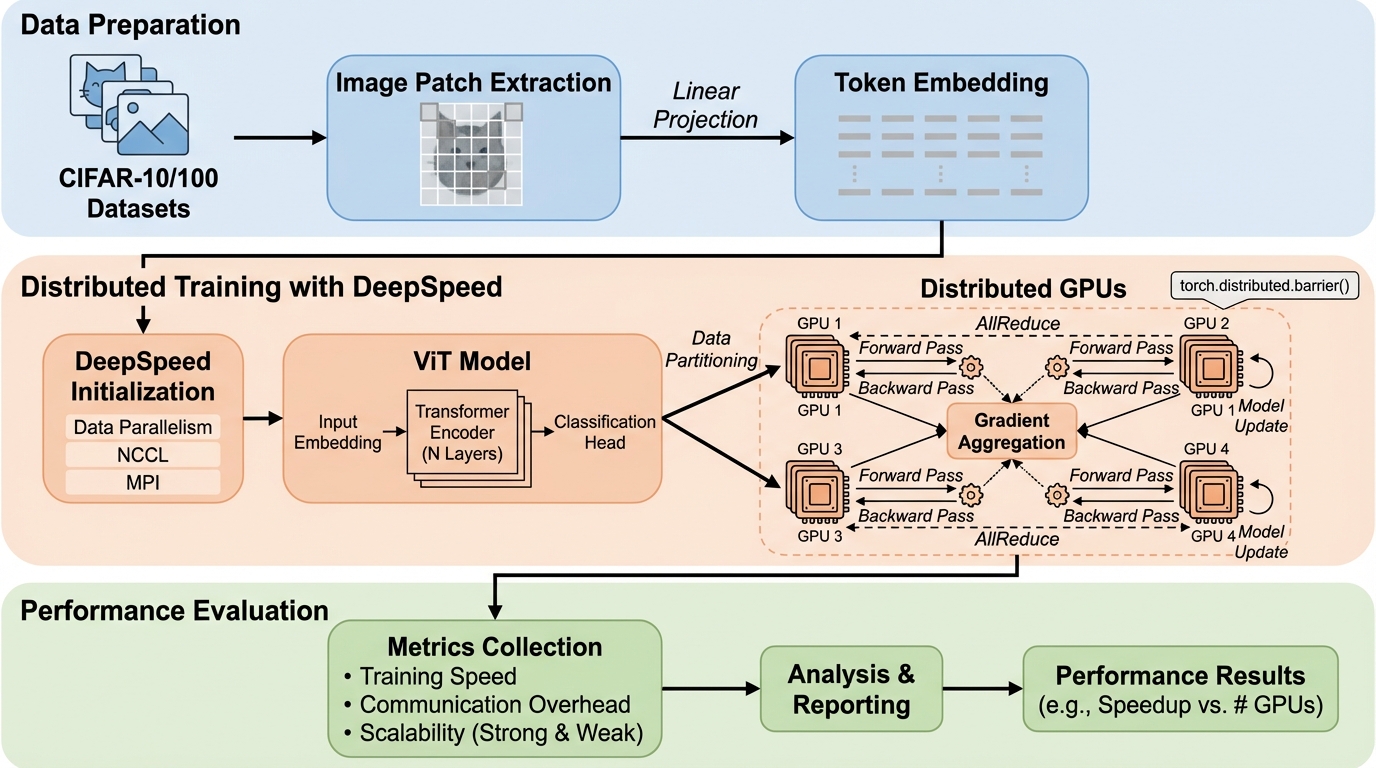

Vision Transformerのスケーリング:画像中心のワークロードにおけるDeepSpeedの評価

Vision Transformerは画像内のパッチ間の関係を自己注意で同時に扱える一方、計算量とメモリ要求が大きく、GPUを増やしても学習が素直に速くならない状況が起こり得ます。 / 本研究はDeepSpeedをVision Transformer(ViT b16)の学習に組み込み、ノード内・ノード間のデータ並列を複数GPU構成で動かし、学習時間・通信オーバーヘッド・強いスケーリングと弱いスケーリングの傾向を、主にCIFAR-10とCIFAR-100で追跡しています。 / 実測では、GPUの同質性が崩れると同期待ちが増えてスケーリングが乱れやすく、またバッチサイズを大きくすると同期コストが下がる傾向が見られ、64または128が通信とメモリの折り合いとして有望だと整理されています。