人間とAIの協力における規範的同等性:正体ではなく行動が協力を左右する

人間3名とAIエージェント1名で構成される小集団において、相手がAIであるか人間であるかという「正体」のラベルは、公共財ゲームにおける協力行動のレベルや規範の形成に有意な影響を与えないことが本研究により明らかになりました。

TL;DR(結論)

人間3名とAIエージェント1名で構成される小集団において、相手がAIであるか人間であるかという「正体」のラベルは、公共財ゲームにおける協力行動のレベルや規範の形成に有意な影響を与えないことが本研究により明らかになりました。 協力の維持を支える主要な要因は、相手のアイデンティティではなく、グループ内の相互的な力学や個人の行動の慣性といった規範的なメカニズムであり、これらは人間のみのグループと人間・AI混合グループの両方で同様の論理に基づいて機能します。 この「規範的同等性」の発見は、社会的な協力規範が人工的なエージェントに対しても柔軟に適用されることを示しており、AIが意思決定に参加する現代社会において、外見の人間らしさよりも行動の透明性と予測可能性が信頼構築に重要であることを示唆しています。

なぜこの問題か

現代社会は、気候変動、地政学的な不安定さ、そして資源の不平等の拡大といった、極めて複雑で困難な社会的課題に直面しています。これらの問題を解決するためには、公共財をめぐる協力が不可欠ですが、そこに自律的なAIエージェントが導入されることで、既存の社会規範がどのように変化するのかを理解することが急務となっています。マッキンゼーの報告によれば、すでに9割の組織が日常業務でAIを活用しており、数年以内にはAI製品やサービスが人々の日常生活に甚大な影響を与えると予測されています。AIはもはや単なるツールではなく、スマートグリッドでのエネルギー配分、交通流の調整、市場での自動取引など、戦略的な意思決定を行う主体として社会に組み込まれつつあります。しかし、これまでの人間とAIの協力に関する研究の多くは、1対1の二者間相互作用に焦点を当てたものが主流であり、小集団における協力規範の形成や維持にAIがどのような影響を及ぼすのかについては、十分に解明されていませんでした。…

核心:何を提案したのか

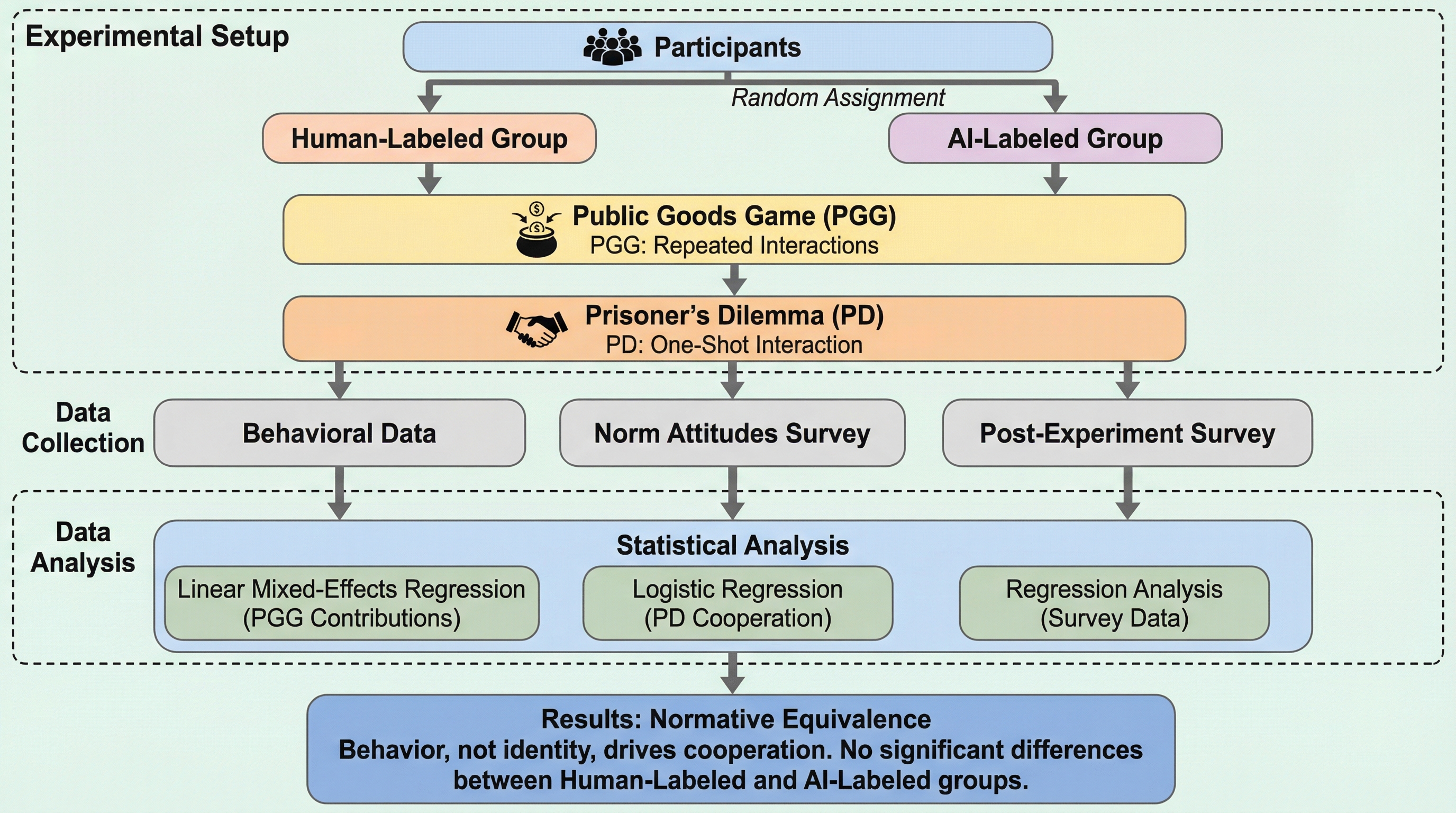

本研究は、人間とAIが混在するグループにおいて、協力規範がどのように形成され維持されるかを検証するために、公共財ゲームを用いたオンライン実験を提案しました。研究の核心は、AIの正体が協力行動を抑制するという「分化効果」と、グループの行動シグナルが正体の違いを上書きするという「規範的同等性」のどちらが支配的であるかを明らかにすることにあります。具体的には、3人の人間と1人のプログラムされたエージェント(ボット)で構成される4人グループを設定し、エージェントのラベル(人間またはAI)と、その行動戦略(無条件協力、条件付き協力、フリーライダー)を組み合わせた実験デザインを採用しました。これにより、相手がAIであると認識された場合に、相互報酬や規範への同調といった人間同士で機能する協力メカニズムが同様に機能するか、あるいは弱まるのかを直接的に比較することが可能になりました。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related