チャットボット利用時におけるユーザーのプライバシーに関する推論と行動の理解:プライバシーにおける有意義な主体性の支援に向けて

チャットボット利用時における機密情報の開示行動と保護行動を詳細に調査し、ユーザーが通常はタスクの効率性や利便性を優先してプライバシーを軽視しがちであること、およびその背後にある複雑で文脈依存的な意思決定のプロセスを明らかにした。

TL;DR(結論)

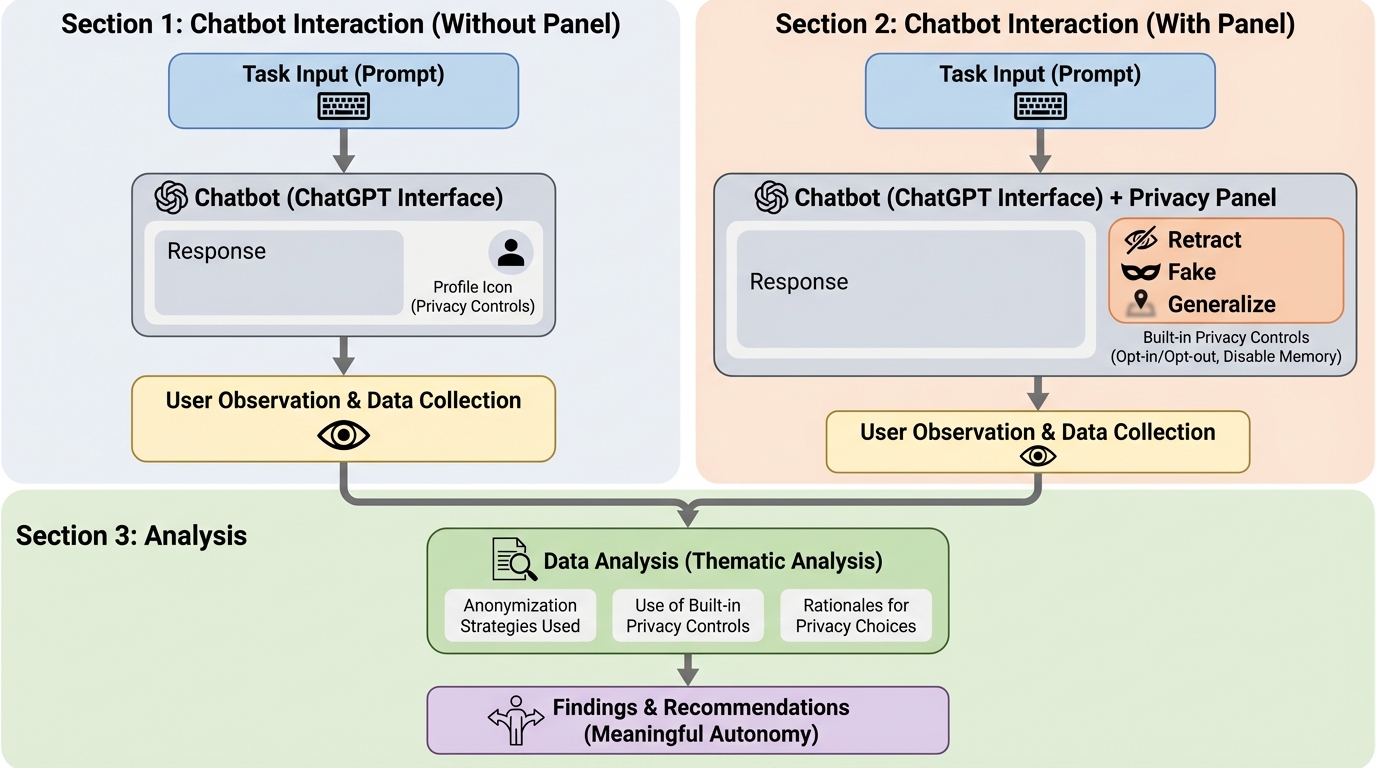

チャットボット利用時における機密情報の開示行動と保護行動を詳細に調査し、ユーザーが通常はタスクの効率性や利便性を優先してプライバシーを軽視しがちであること、およびその背後にある複雑で文脈依存的な意思決定のプロセスを明らかにした。 メッセージ送信を一時的に中断して機密情報を自動検出し、情報の削除や偽装、あるいは抽象的な表現への置き換えといった多様な匿名化手法を即座に提示する「プライバシー通知パネル」を開発し、ユーザーの主体的な情報管理を支援する仕組みを提案した。 コンピュータサイエンスを専攻する学生を対象とした実証実験の結果、このパネルの導入によってユーザーのプライバシーに対する意識が劇的に向上し、タスクの目的と情報の機密性を天秤にかけながら、状況に応じた最適な保護手段を自ら選択する行動が促進された。

なぜこの問題か

対話型エージェント(CA)であるチャットボットは、現在、学術研究、専門的な業務、金融、医療、そして日常的な会話など、極めて多岐にわたる分野で広く利用されている。ユーザーはこれらのエージェントに対し、名前やメールアドレス、住所といった個人を特定できる情報(PII)だけでなく、健康状態や財務状況などの極めて機密性の高い情報を開示することが頻繁にある。しかし、大規模言語モデル(LLM)を基盤とするチャットボットには、学習データに含まれる機密情報を特定のプロンプトに応じて再現してしまう「記憶効果」という脆弱性が存在し、これが重大なプライバシーリスクとなっている。また、収集されたデータがユーザーの同意を超えて詳細なプロファイリングや不正利用に繋がる懸念も、多くの研究者によって指摘されている。実際に、韓国のチャットボット「Lee Luda」が学習データから個人情報を漏洩させた事件や、Googleの「Bard(現在のGemini)」との非公開の会話が検索結果に表示されてしまった事例など、具体的な被害も報告されている。…

核心:何を提案したのか

本研究では、チャットボットへのメッセージ送信を送信直前に一時的に遮断し、ユーザーにプライバシー保護の機会を提供する「プライバシー通知パネル」を提案した。このパネルは、ユーザーが送信ボタンを押した直後、データが外部のサーバーに送信される前にブラウザ上で動作し、メッセージ内に含まれる機密情報を自動的に検出して警告を表示する仕組みである。具体的には、氏名、メールアドレス、電話番号、住所、社会保障番号、生年月日といった特定の個人情報を識別し、それらをユーザーが確認しやすい形でハイライト表示する。このツールの核心は、単に警告を出すだけでなく、ユーザーが状況に応じて選択できる複数の匿名化戦略を提供している点にある。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related