KV Bindingを用いたTest-Time Trainingは「記憶」ではなく学習された線形注意として理解できる、という再定式化。

KV binding型のTest-Time Trainingは、テスト時にキーと値の対応を作って保持し、クエリで検索する「一時的な記憶装置」だと説明されがちですが、観測される挙動にはその説明と噛み合わない点が複数あります。

TL;DR(結論)

- KV binding型のTest-Time Trainingは、テスト時にキーと値の対応を作って保持し、クエリで検索する「一時的な記憶装置」だと説明されがちですが、観測される挙動にはその説明と噛み合わない点が複数あります。

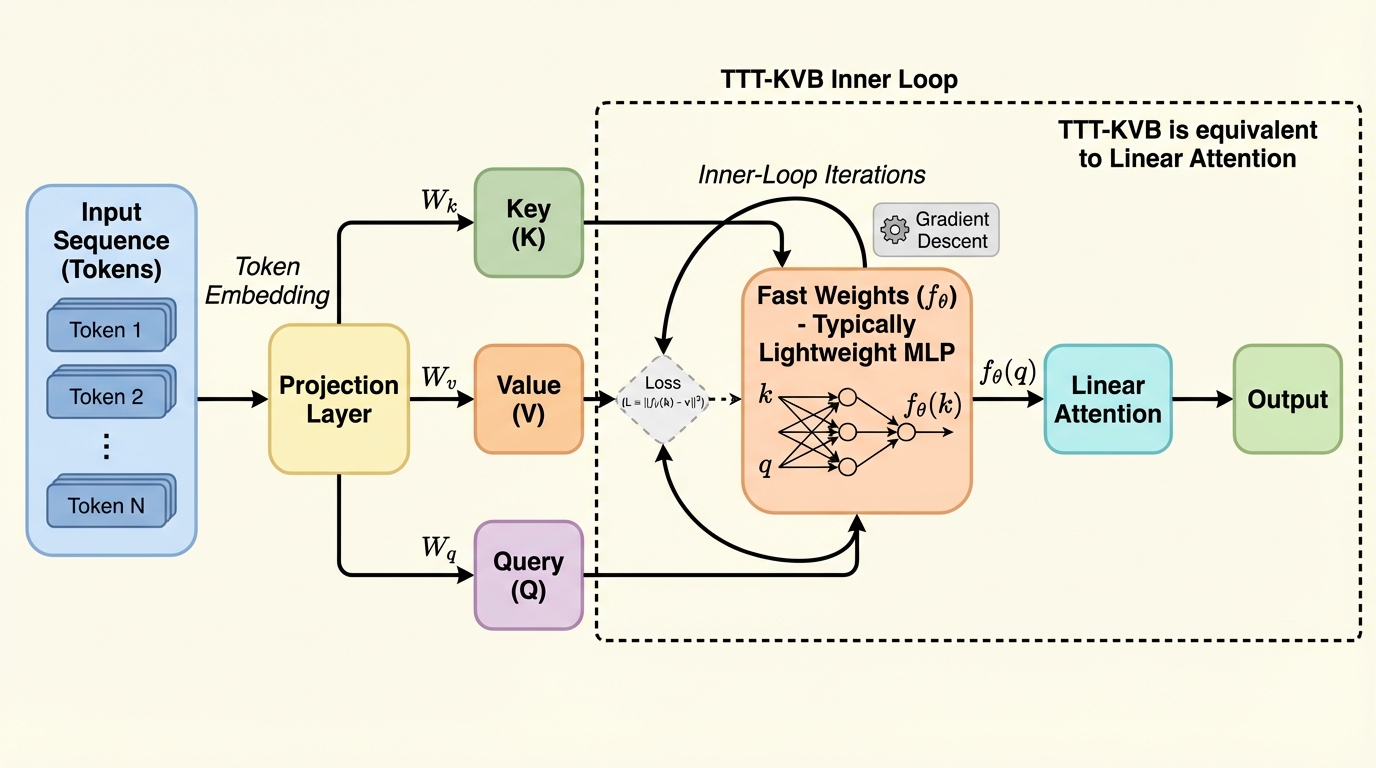

- 内側ループの更新を数式として展開すると、単純な設定に限らず、多層のMLPやモメンタム付き更新を含む幅広いTTTが、学習された線形注意演算子の形に書き換えられることが示されます。

- この見方により、内側ループ損失の改善が下流性能の改善につながらないことや、勾配降下を勾配上昇に替えても性能が保たれることなどが同じ機構で説明でき、構成の簡略化や完全並列化(注意計算で推論スループット最大4.0×)といった実用的な含意も得られます。

なぜこの問題か

Test-Time Training(TTT)は、推論時にもパラメータ更新を続けることで、学習時とテスト時の分布ずれに適応する考え方として導入されてきました。近年はこの枠組みが、Transformerのsoftmax注意の代替として「系列モデリング層そのもの」を構成する部品としても扱われ、線形時間の計算量や、自己回帰推論におけるメモリ使用量が系列長に対して一定である点が利点として語られています。とくに本稿が扱うKV binding型は、内側ループでキーを入力、値を回帰ターゲットとする自己教師ありの対応づけ目的を最適化し、その後にクエリを同じ関数へ通して出力を得る方式です。 この方式は直観的に「その場でキー→値の写像を作って一時保存し、後から検索する」オンラインのメタ学習、あるいは記憶・検索機構として理解されやすいです。その理解が前提になると、より忠実に記憶させるために、内側ループの最適化手法や正規化、ネットワークの深さなどを複雑化させる動機が生まれます。ところが論文は、そうした記憶仮説なら当然成立しそうな関係が、実験的に崩れる現象を複数提示します。…

核心:何を提案したのか

本論文の提案は、KV binding型TTTを「テスト時の記憶」ではなく「学習された線形注意(linear attention)演算子」として捉え直す再定式化です。著者らはまず、記憶・検索としての説明と矛盾する現象が体系的に観測されることを整理し、その矛盾が偶発的ではない点を強調します。そのうえで、TTTの内側ループ更新を明示的に展開し、さまざまなTTTアーキテクチャが線形注意の標準的な形へ還元できることを解析的に示します。対象は、最終タスク損失から内側ループまでエンドツーエンドに逆伝播する方式ではなく、内側ループが自己教師ありのキー・値対応づけ目的を最適化する方式(先行研究でTTT-KVBと呼ばれる系統)です。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related