少数の critical weights が精度とプライバシー漏えいを同時に握る

メンバーシップ推論攻撃の脆弱性はモデル全体ではなく、ごく少数の重みに集中しており、その多くは精度にも重要でした。論文は、危険な重みを削除する代わりに初期値へ巻き戻して固定し、残りだけを微調整する CWRF を提案し、LiRA や RMIA に対する耐性と精度の両立を示します。

TL;DR(結論)

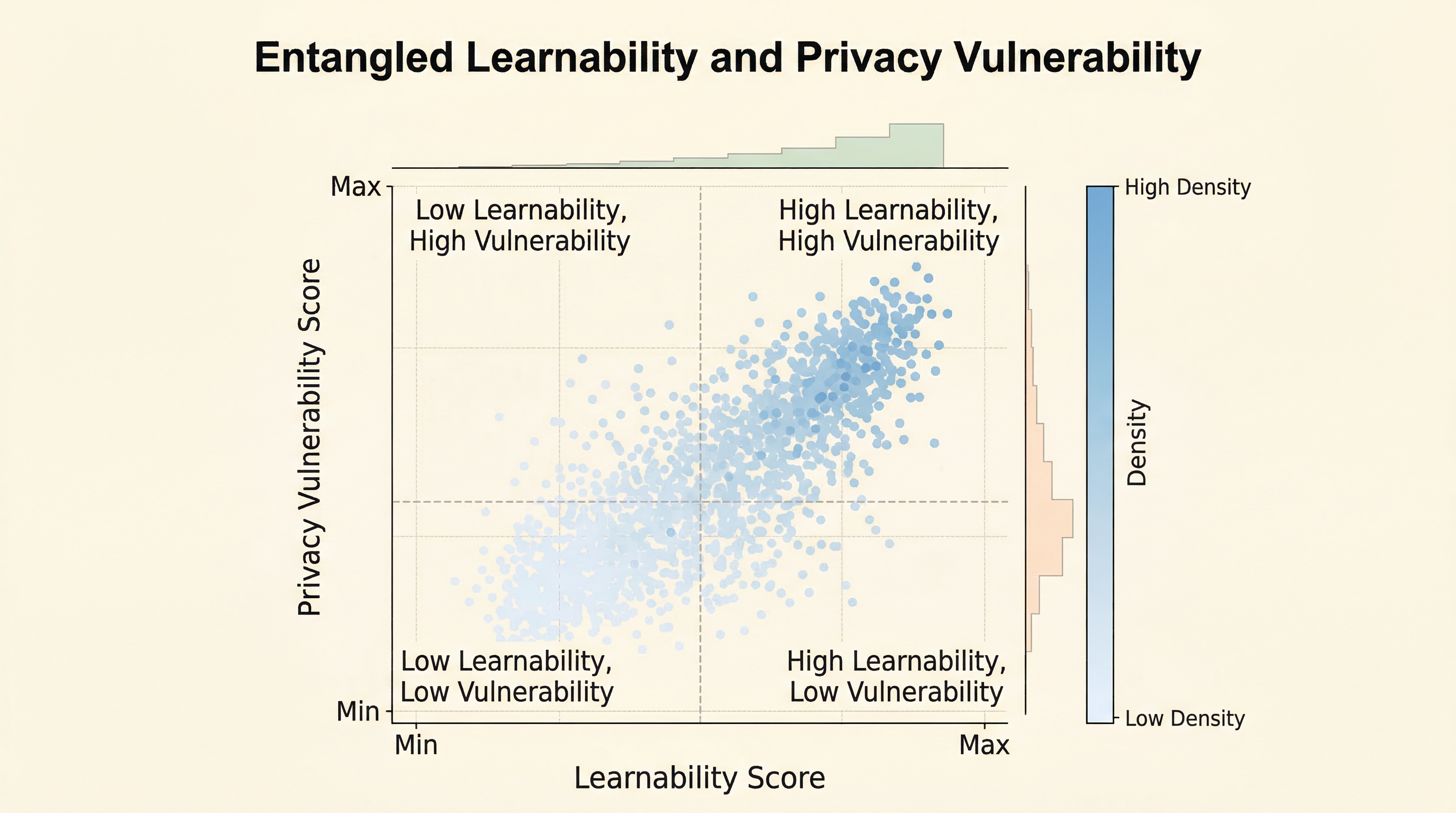

- メンバーシップ推論攻撃の脆弱性は、モデル全体ではなくごく少数の重みに集中しており、しかもその多くは精度にも重要な重みと重なっていました。

- 論文は、プライバシー脆弱性を重みレベルで推定し、危険な重みを削除する代わりに初期値へ巻き戻して固定し、残りだけを微調整する CWRF を提案します。

- その結果、ResNet18 や ViT を用いた実験で、LiRA や RMIA に対する耐性を大きく改善しつつ、モデル精度を保つ、あるいは条件によっては改善することも示しました。

なぜこの問題か

メンバーシップ推論攻撃は、あるデータが学習に使われたかどうかを、モデルの出力挙動から推定する攻撃です。学習済みモデルが訓練データに対してだけ特有の確信度や損失分布を示すなら、攻撃者はその差を使って「この人のデータは学習に含まれていた」と推測できます。医療、教育、個人履歴のように訓練集合そのものが秘匿対象になる領域では、これはかなり深刻です。

核心:何を提案したのか

著者らは三つの観察を示しています。第一に、プライバシー脆弱性は全重みではなく、ごく少数の重みに存在します。第二に、その多くは精度にも重要な learnability-critical weights と重なります。第三に、重みの重要性は値そのものより、ネットワーク内の位置に強く依存します。特に三つ目が効いていて、危険な重みを消すのではなく、その位置を残したまま値だけ安全側へ戻す、という設計が導かれます。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related