曖昧から厳密へ:有理数演算による無限深度推論のためのHaloアーキテクチャ

現在の深層学習が依存する浮動小数点演算の近似誤差が、深い推論における「論理的な幻覚」や「セマンティック・ドリフト」の根本原因であると特定し、これを排除するための新しい計算パラダイムを提案した。 有理数演算(Q)を基盤とする「Haloアーキテクチャ」と専用ハードウェア「Exact Inference Unit(EIU)」を導入することで、誤差の蓄積をゼロに抑え、理論上無限の深さを持つ論理推論を可能にする。 600Bパラメータ規模のモデルを用いた検証では、従来の浮動小数点形式がカオス的な系で崩壊する一方で、本提案手法は無限に精度を維持し、大規模モデルほど数値的に不安定になるという「次元の呪い」を克服した。

TL;DR(結論)

現在の深層学習が依存する浮動小数点演算の近似誤差が、深い推論における「論理的な幻覚」や「セマンティック・ドリフト」の根本原因であると特定し、これを排除するための新しい計算パラダイムを提案した。 有理数演算(Q)を基盤とする「Haloアーキテクチャ」と専用ハードウェア「Exact Inference Unit(EIU)」を導入することで、誤差の蓄積をゼロに抑え、理論上無限の深さを持つ論理推論を可能にする。 600Bパラメータ規模のモデルを用いた検証では、従来の浮動小数点形式がカオス的な系で崩壊する一方で、本提案手法は無限に精度を維持し、大規模モデルほど数値的に不安定になるという「次元の呪い」を克服した。

なぜこの問題か

現代のLLM(大規模言語モデル)の発展を支えてきた「スケーリング則」は、計算効率を優先するためにFP16やBF16、さらにはFP8といった低精度な浮動小数点形式を採用してきた。しかし、この戦略は多段階の論理推論や記号操作、長期的な計画が必要なタスクにおいて限界に直面している。著者は、現在のAIに見られる「幻覚」や論理的な不整合の多くは、データの問題ではなく、IEEE 754浮動小数点規格による近似誤差が深い計算過程で指数関数的に蓄積される「セマンティック・ドリフト」という現象に起因すると指摘している。 浮動小数点演算には「結合法則が成立しない」という致命的な欠陥がある。例えば、GPUでの並列計算の順序が変わるだけで計算結果に微細な差異が生じ、これが深い推論チェーンの中で増幅されることで、モデルの内部状態が論理的な軌道から外れてしまう。論理は離散的で厳密なものであるべきだが、現在のハードウェアが提供する浮動小数点数は連続的で近似的なものであり、この物理的基盤と数学的要求のミスマッチが、AGI(汎用人工知能)の実現を阻む壁となっている。…

核心:何を提案したのか

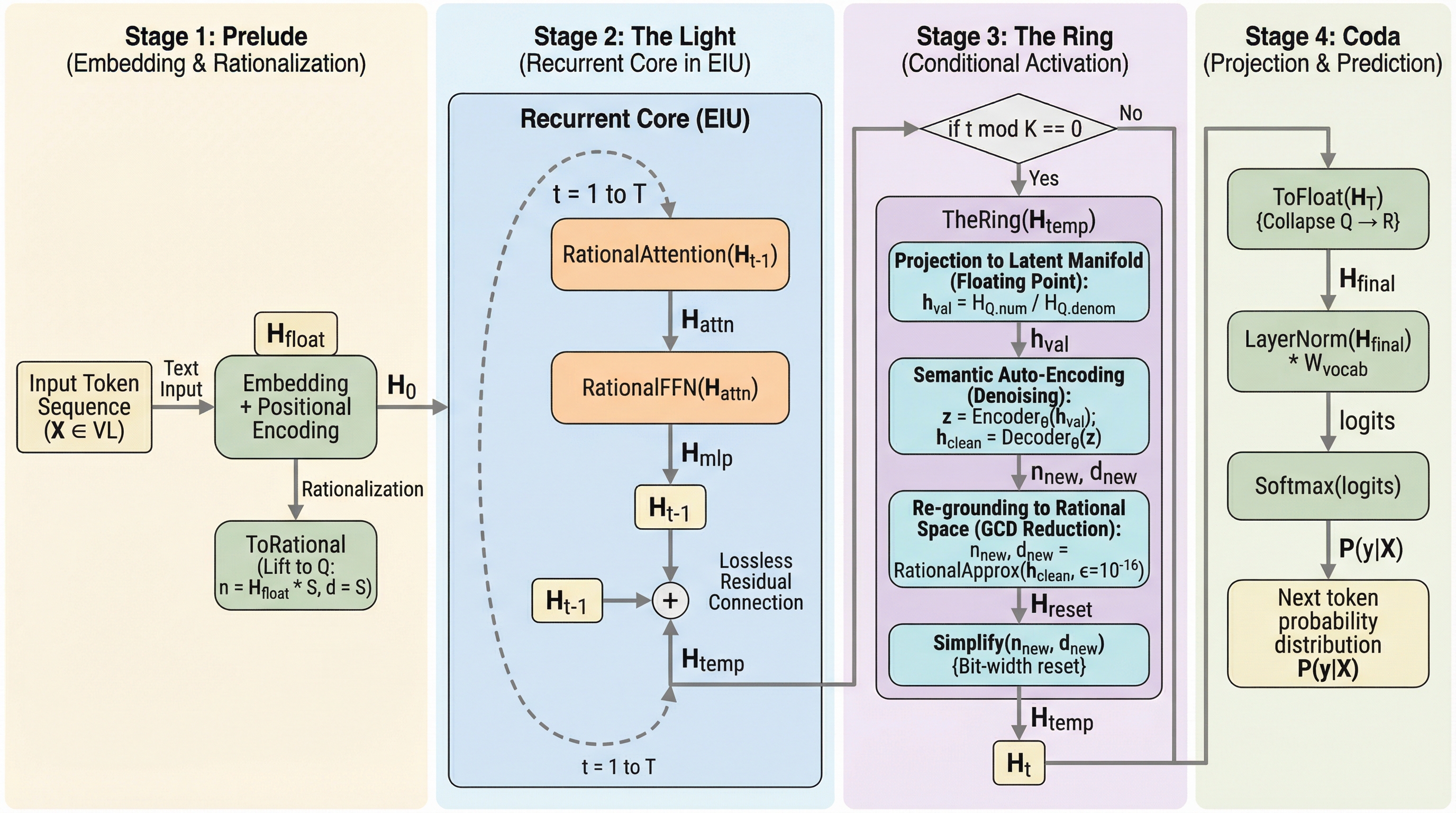

著者は、推論の深さは数値精度に比例するという「厳密性仮説(Exactness Hypothesis)」を提唱し、その実現のための「Haloアーキテクチャ」を提案した。このアーキテクチャの最大の特徴は、計算の基盤を実数(R)の近似フィールドから、有理数(Q)の厳密なフィールドへと移行させた点にある。これにより、例えば「1/3 + 1/3 + 1/3」という計算において、浮動小数点で見られる「0.9999999」のような近似値を排除し、厳密に「1」という結果を得ることが保証される。 Haloアーキテクチャは、無限精度の情報流である「The Light(光)」と、計算の複雑さを制御する「The Ring(環)」という2つのメカニズムで構成されている。「The Light」は、すべての演算を有理数(分子と分母のペア)として実行し、推論の深さが精度損失によって制限されないようにする。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related