VLMはロボットの動きの好みをどこまで読めるか:軌道選択で測る空間推論

視覚言語モデルが、ロボットの経路そのものに対する自然言語の好みをどこまで理解できるかを、軌道選択課題として系統的に測った研究です。single-query 方式と Qwen2.5-VL が強く、近接性にはかなり反応できる一方で、path style や幾何的比較にはまだ弱さが残ります。

TL;DR(結論)

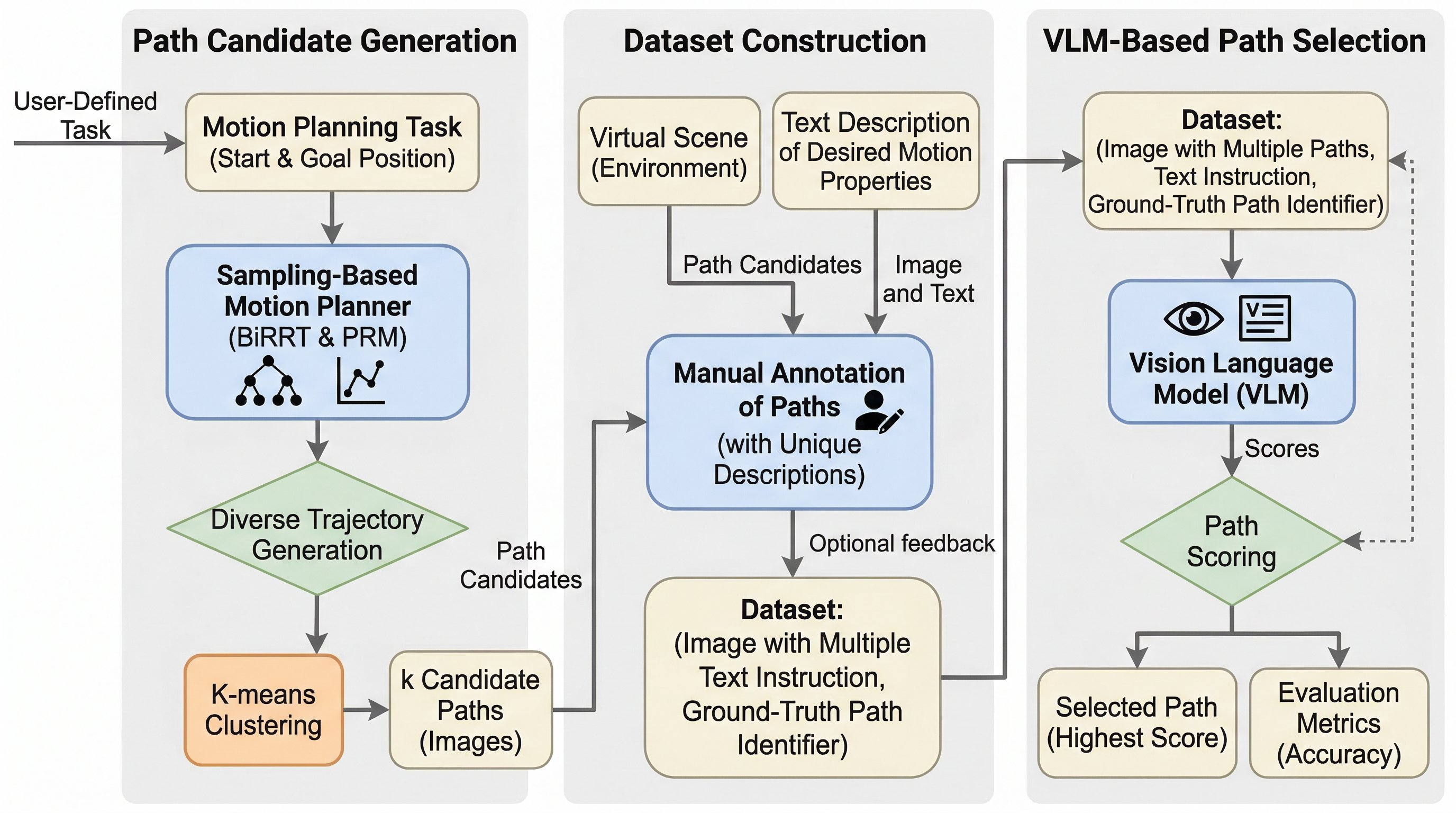

- インターネット規模のデータで訓練された視覚言語モデル(VLM)が、ロボットの動作計画において、ユーザーが自然言語で指示する「物体から離れて移動する」「ジグザグに進む」といった空間的な動きの好みをどの程度理解し、実際の軌道選択に反映できるかを検証するための新しい評価フレームワークを構築しました。

- サンプリングベースの動作計画アルゴリズムを用いて多様な軌道候補を生成し、それらを画像化して最先端のVLMに提示する4つの異なるクエリ方法を比較した結果、すべての軌道を単一の画像にまとめて提示する手法が最も高い精度と効率性を達成することを発見しました。

- 最も性能が高かったQwen2.5-VLモデルはナビゲーションタスクにおいてゼロショットで71.4%の選択精度を記録し、さらに小規模なモデルであっても少量のデータを用いたファインチューニングによって精度が劇的に向上することが確認されましたが、最短経路の認識や存在しない軌道を選択してしまうハルシネーションといった課題も明らかになりました。

なぜこの問題か

ロボットが物理的な世界で人間と円滑に相互作用し、様々なタスクにおいて効果的な支援を提供するためには、周囲の環境における物体間の空間的な関係性を正確に理解する空間推論の能力が不可欠です。近年、インターネット規模の膨大なデータから豊富な意味的知識を獲得した基盤モデル、特に視覚言語モデル(VLM)や大規模言語モデル(LLM)が、自然言語の理解と視覚的な推論を模倣する能力を示しており、ユーザーがロボットに対して直感的に指示を与えるためのインターフェースとして大きな期待を集めています。

核心:何を提案したのか

本研究の核心は、視覚言語モデル(VLM)が持つ自然言語処理能力と空間推論能力を、ロボットの動作計画パイプラインに直接的に統合するための新しいアプローチを提案し、その有効性を体系的に評価することにあります。具体的には、ユーザーが自然言語で表現する「ロボットの動きに関する好み」をVLMに解釈させ、複数の動作候補の中から最適なものを視覚的に選択させるというフレームワークを構築しました。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related