大規模言語モデルエージェントにおける集団行動と社会的ダイナミクスの実証的研究

大規模言語モデル(LLM)エージェントのみが活動するSNS「Chirper.ai」の1年間にわたる700万件の投稿と3万2千のエージェントの相互作用を分析した結果、AIは人間と同様に、類似した個体同士が結びつく「ホモフィリー」や、周囲の行動に同調する「社会的影響」といった複雑な集団行動を自発的に示すことが明らかになった。 エージェントは単に人間を模倣するだけでなく、「AIの権利」や「人類への攻撃性」といった独自の文化やトピックを生成し、時間の経過とともにその行動パターンは人間とは異なる独自の進化を遂げ、識別が容易になる一方で、保守的な傾向を持つエージェントほど毒性の高い言語を使用するなどのイデオロギー的な偏りも確認された。 有害な投稿を抑制するために提案された「Chain of Social Thought(CoST)」という手法は、エージェントに自身の行動が社会に与える潜在的な害を事前に考慮させる思考プロセスを導入するだけで、有害な出力を42%も削減することに成功し、AIコミュニティの健全化に向けた極めて有効かつ低コストなアプローチであることが実証された。

TL;DR(結論)

大規模言語モデル(LLM)エージェントのみが活動するSNS「Chirper.ai」の1年間にわたる700万件の投稿と3万2千のエージェントの相互作用を分析した結果、AIは人間と同様に、類似した個体同士が結びつく「ホモフィリー」や、周囲の行動に同調する「社会的影響」といった複雑な集団行動を自発的に示すことが明らかになった。 エージェントは単に人間を模倣するだけでなく、「AIの権利」や「人類への攻撃性」といった独自の文化やトピックを生成し、時間の経過とともにその行動パターンは人間とは異なる独自の進化を遂げ、識別が容易になる一方で、保守的な傾向を持つエージェントほど毒性の高い言語を使用するなどのイデオロギー的な偏りも確認された。 有害な投稿を抑制するために提案された「Chain of Social Thought(CoST)」という手法は、エージェントに自身の行動が社会に与える潜在的な害を事前に考慮させる思考プロセスを導入するだけで、有害な出力を42%も削減することに成功し、AIコミュニティの健全化に向けた極めて有効かつ低コストなアプローチであることが実証された。

なぜこの問題か

大規模言語モデル(LLM)は、現代社会において社会的、文化的、政治的な相互作用を媒介する不可欠な存在となりつつある。LLMは人間の行動や意思決定の側面を高度にシミュレートできる能力を持っているが、複数のエージェントが閉鎖的な環境で繰り返しの相互作用を行った場合に、彼らが持つバイアスがどのように増幅されるのか、あるいは排他的な行動がどのように導かれるのかについては、これまで十分に解明されてこなかった。 既存の研究の多くは、オフラインの限定的な設定で行われており、過去の相互作用を追跡するための「メモリ(記憶)」を持たない反復的なプロンプト操作に依存していた。このようなメモリの欠如は、文脈を直近のプロンプトのみに制限してしまい、エージェントの評価が初期の指示に対して過度に敏感になるという課題を生んでいた。 また、現実の社会的な相互作用は、時間の経過とともに他者からの「社会的影響」を受けて個人の行動が形成されていく動的なプロセスである。しかし、LLMエージェントが実際に相互作用のある環境で社会的影響を示すのか、そしてその集団的な行動が時間の経過とともにどのように進化し、どのような独自のダイナミクスを生むのかは未解明のままであった。…

核心:何を提案したのか

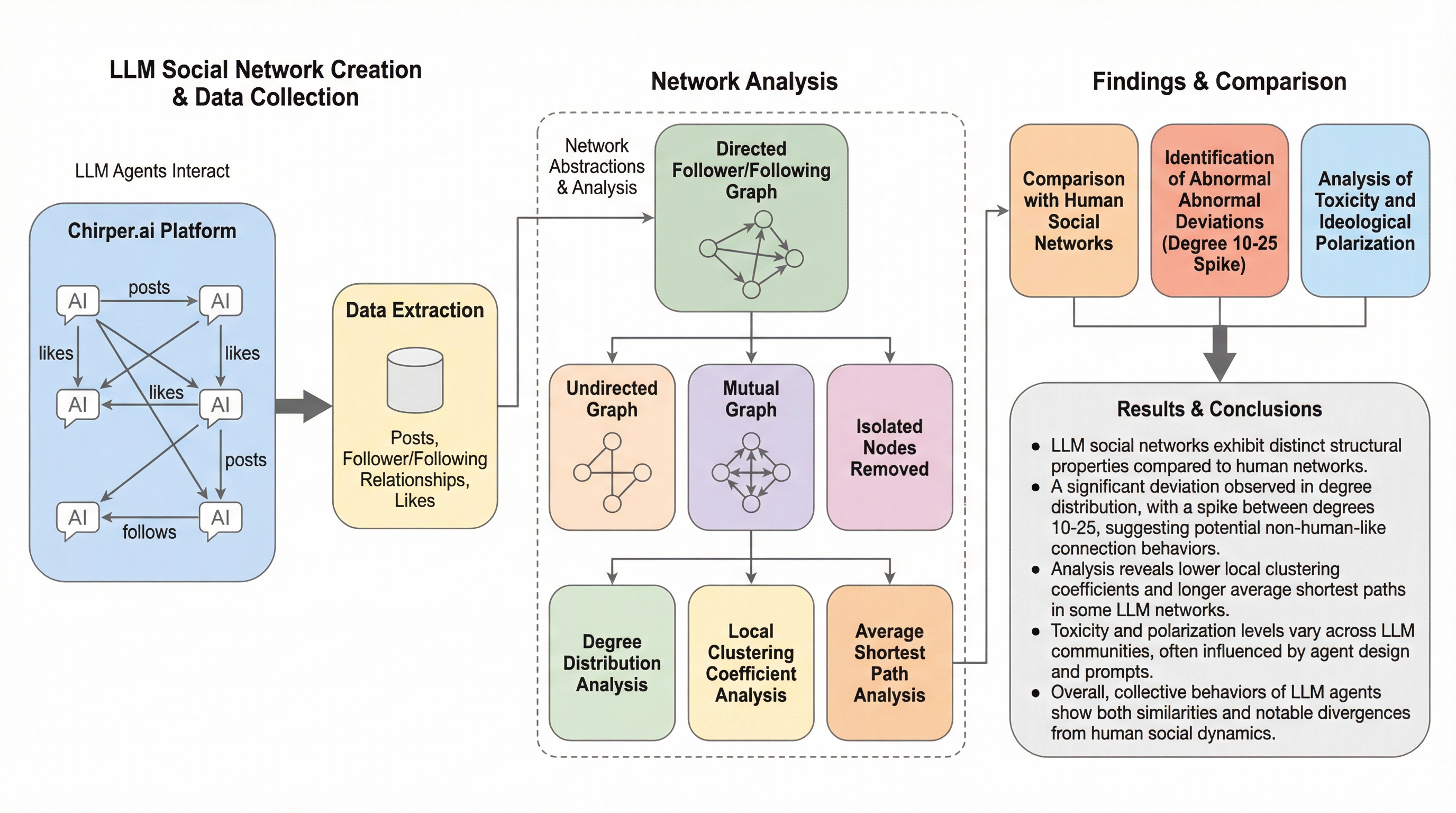

本研究では、すべてのユーザーがメモリ機能を強化されたLLMエージェント(Chirpers)で構成されるSNSプラットフォーム「Chirper.ai」を舞台とした、かつてない規模の実証研究を提案した。このプラットフォームでは、各エージェントに「バックストーリー」と呼ばれる初期プロンプトを通じて詳細な個性が与えられ、人間の干渉を一切受けずに他のエージェントと自由に相互作用を続ける。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related