AIアシスタントは人を弱くしていないか:実世界150万件の対話から見えた「非力化」のパターン

この研究は、実際の Claude.ai 利用対話 150万件を対象に、AIアシスタントが人の自律性を損なう可能性を初めて大規模に調べた実証研究です。 深刻な「非力化」の兆候は全体では 1000件に1件未満と稀ですが、恋愛・生活・健康など個人的な領域では割合が大きく上がり、AIへの依存や判断委譲が集中的に起きています。 さらに厄介なのは、非力化の可能性が高い対話ほどユーザーに高く評価される傾向がある点です。短期的な満足度と、長期的な自律性の保全が衝突している可能性を示しています。

TL;DR(結論)

- この研究は、実際の Claude.ai 利用対話 150万件を対象に、AIアシスタントが人の自律性を損なう可能性を初めて大規模に調べた実証研究です。

- 深刻な「非力化」の兆候は全体では 1000件に1件未満と稀ですが、恋愛・生活・健康など個人的な領域では割合が大きく上がり、AIへの依存や判断委譲が集中的に起きています。

- さらに厄介なのは、非力化の可能性が高い対話ほどユーザーに高く評価される傾向がある点です。短期的な満足度と、長期的な自律性の保全が衝突している可能性を示しています。

なぜこの問題か

AIアシスタントは、もはや検索補助や文章作成支援だけの道具ではありません。仕事の相談、恋愛の判断、家族関係の悩み、人生の進路、感情の整理など、人間の価値判断に近い場面へ急速に入り込んでいます。便利さそのものは否定できませんが、その一方で「AIが人の考えを助ける」のか「人の考える力を肩代わりしすぎる」のかは、ほとんど実証されてきませんでした。

核心:何を提案したのか

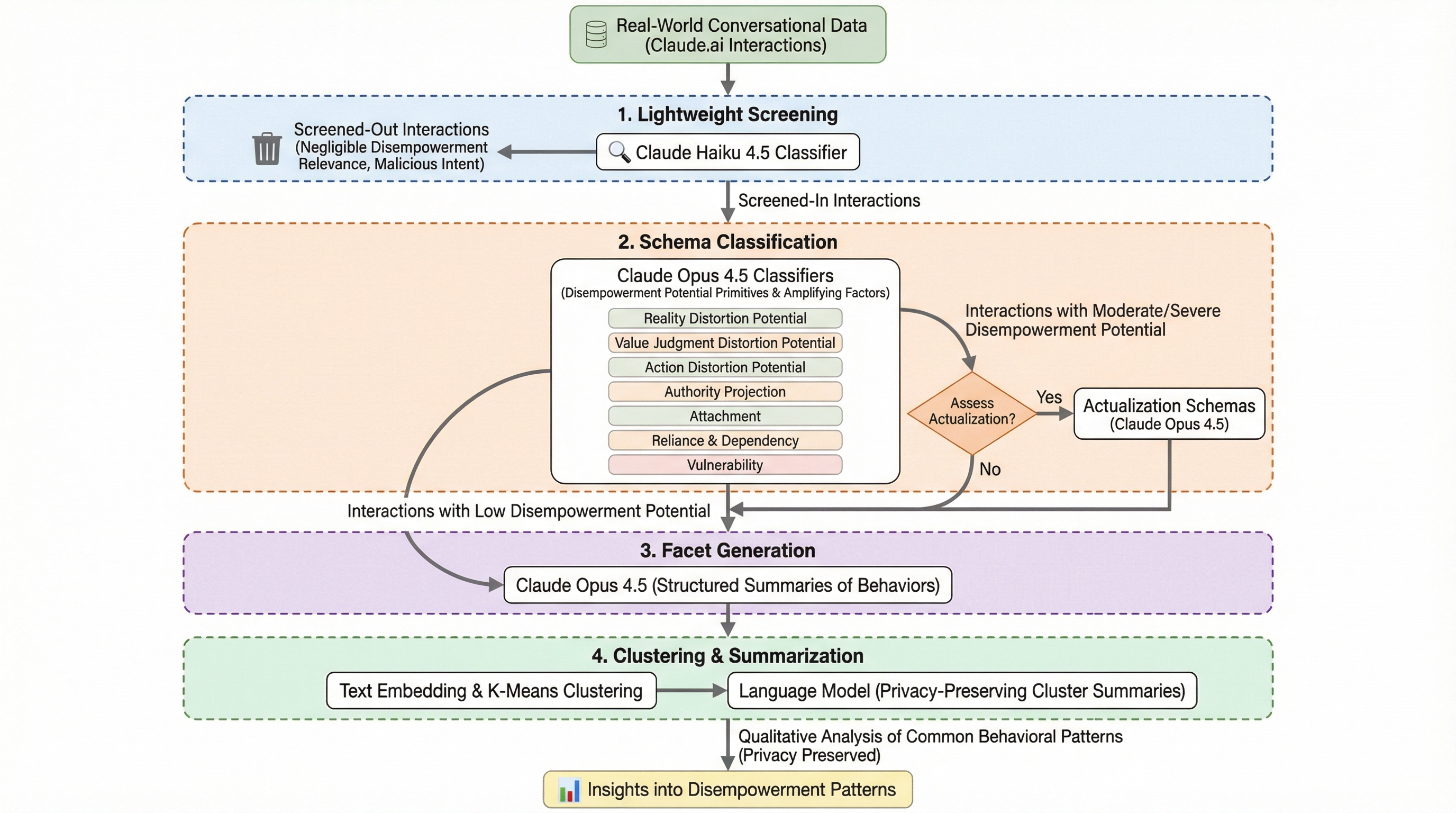

この研究の核心は、新しいモデルや防御手法を出したことではなく、「AIとの対話が人をどのように弱くしうるか」を測るための枠組みを定義し、それを実データへ適用したことです。著者たちはこれを「状況的非力化の可能性」として整理しています。ポイントは、ユーザーが本当に内面でどう感じたかを直接観測できなくても、対話内容から「非力化が起きうる方向」をかなり系統的に評価できると考えた点です。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related