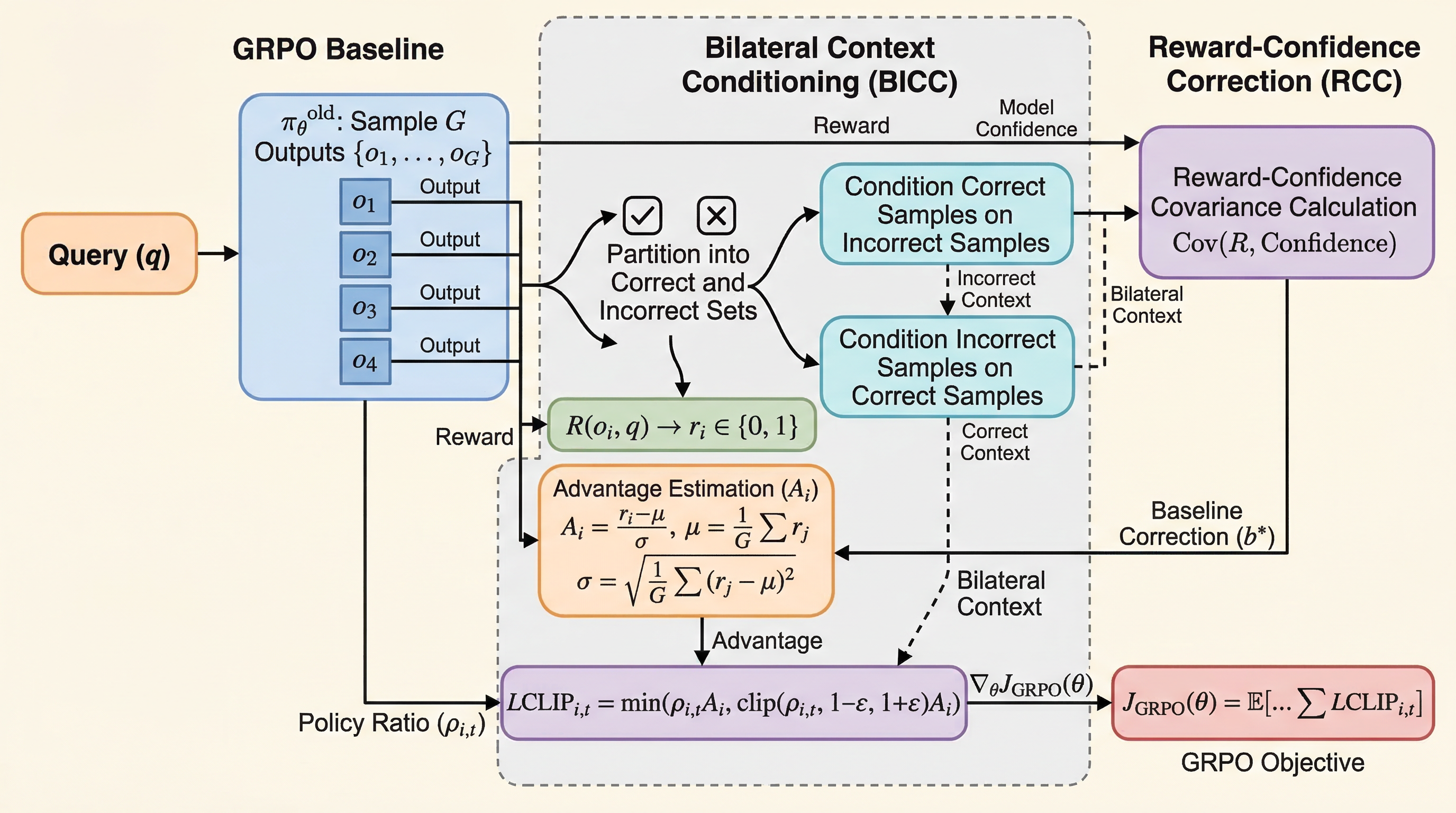

GRPOの見落としを突く:正解と誤答の対比を学習に入れる BICC と RCC

GRPO はグループ平均との差で学習を進めますが、同じグループ内に自然に生まれる正解トレースと誤答トレースの対比を、そのままでは十分に使えていません。BICC と RCC はこの比較情報を直接学習に取り込み、追加サンプリングや補助モデルなしで推論精度と学習安定性を底上げする提案です。

TL;DR(結論)

- GRPO はグループ平均との差を使う強化学習ですが、同じグループ内に自然に混ざる正解トレースと誤答トレースの対比を、最適化の中では十分に活用していません。

- そこで提案されたのが、成功例と失敗例を相互参照させる BICC と、報酬と信頼度の共分散を使って学習信号の揺れを抑える RCC です。

- 追加サンプリングや補助モデルなしで組み込めるのが強みで、数学推論ベンチマークでは精度改善だけでなく学習の安定化も確認され、GRPO 系の伸びしろをかなり素直な形で掘り当てています。

なぜこの問題か

GRPO は、同じ問いに対して複数の応答候補を出し、そのグループ平均との差からアドバンテージを作る手法です。PPO のようなクリティック学習を省きながら、検証可能な報酬を持つタスクで高い性能を出せるため、数学推論やコード生成のような reasoning 領域ではかなり重要な位置を占めています。軽い実装で伸びやすいので、実務でも研究でも採用しやすいのが強みです。

核心:何を提案したのか

提案の核は二段構えです。第一に、標準的な GRPO を対照学習的に読み替え、正解サンプルと誤答サンプルの policy ratio のマージンを広げる目的として再定式化したことです。これにより、GRPO は単なる「平均との差の最適化」ではなく、「成功側と失敗側の境界を押し広げる最適化」として理解できるようになります。この再定式化があるからこそ、後段の改良が場当たりではなく、目的関数の構造に沿ったものになります。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related