UniGeM: 幾何学的探索とマイニングによるデータ混合と選択の統合

大規模言語モデルの学習においてデータの質がボトルネックとなる中、従来のドメイン混合(マクロ)とサンプル選択(ミクロ)を個別に扱う手法では、コードのような厳密な論理構造を持つデータの整合性が損なわれるという課題があった。

TL;DR(結論)

大規模言語モデルの学習においてデータの質がボトルネックとなる中、従来のドメイン混合(マクロ)とサンプル選択(ミクロ)を個別に扱う手法では、コードのような厳密な論理構造を持つデータの整合性が損なわれるという課題があった。 本研究が提案するUniGeMは、データキュレーションを多様体近似問題として捉え、外部データや高コストな代理モデルに頼らず、データの幾何学的構造からマクロな重み付けとミクロな品質選択を階層的に統合し、論理的依存関係を維持した高品質なサブセットを抽出する。 1000億トークンの学習実験において、ランダムサンプリングと比較して2.0倍のデータ効率を達成し、特に推論能力や多言語対応能力において既存の最先端手法を上回る性能を示したことで、構造化データの効率的なキュレーション手法としての有効性が実証された。

なぜこの問題か

大規模言語モデル(LLM)の性能向上は、これまでパラメータ数とデータ量の拡大、いわゆるスケーリング則に依存してきた。しかし、最新の知見によれば、モデルの限界を規定しているのはデータの量ではなく質であるという認識が強まっている。高品質な公開コーパスが枯渇しつつある現状では、ノイズの多いウェブデータを単に集積するだけでは収穫逓減に陥るため、計算資源あたりの利得を最大化する「データ効率」の向上が極めて重要な焦点となっている。既存のデータ効率化アプローチは、大きく分けてドメイン間の混合比率を調整するマクロな手法と、個別のサンプルを選択するミクロな手法の二つに分かれている。しかし、これらを個別に処理することには大きな弊害がある。 特にコードコーパスのように、厳密な構文や階層的な依存関係を持つデータの場合、個別のサンプルを独立して評価する選択手法では、データの背後にある多様体構造や論理的な一貫性が破壊される恐れがある。また、ドメインを平坦な分布として扱うマクロな調整では、ドメイン内部の微細な構造が見落とされてしまう。このようなマクロとミクロのデカップリング(分離)は、構造化されたデータセットにおいて「構造的な死角」を生む原因となる。…

核心:何を提案したのか

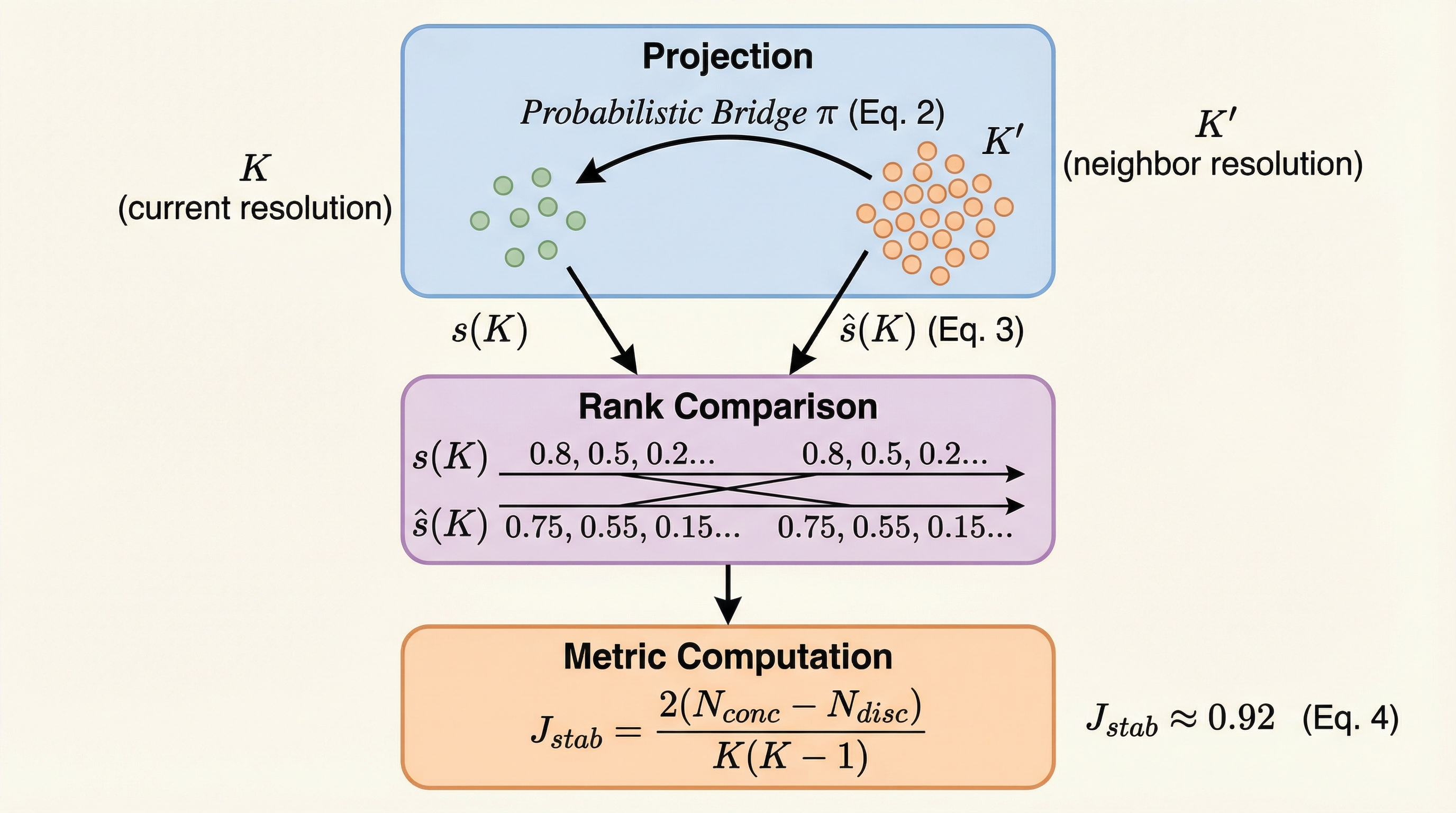

本研究は、マクロな分布調整とミクロな品質選択を一つの統一されたプロセスとして統合するフレームワーク「UniGeM(Geometric Exploration and Mining)」を提案した。UniGeMの革新性は、データキュレーションを「多様体近似問題」として再定義した点にある。これは、元の大規模なデータ集合が持つ潜在的な構造(多様体)を、より小さなサブセットでいかに正確に模倣するかという数学的な視点に基づいている。このアプローチの大きな利点は、外部の参照データセットや、高コストな代理モデルの訓練を一切必要としない自己完結型であることだ。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related