設計から信頼へ:スキルで見える、予算にやさしいLLM選択(BELLA)

「このタスク、どのLLMを使うのが正解?」 高いモデルほど良さそう──でも“何が得意か”が見えないまま、お金だけが溶ける。 この記事では、スキルの粒度でモデルを選び、しかも理由を言葉で説明する枠組み「BELLA」を読み解く。選択の精度だけでなく、選択そのものを信じられる形に整える、という発想に焦点を当てる。

TL;DR(結論)

- BELLAは、タスクに必要な能力を“スキル”として分解し、予算制約の中で最適なLLM選択を勧める枠組み。単に「高性能モデルを当てる」のではなく、「そのタスクに必要な要素が何か」を先にほどいてから、コストと性能の折り合いを付けにいく。

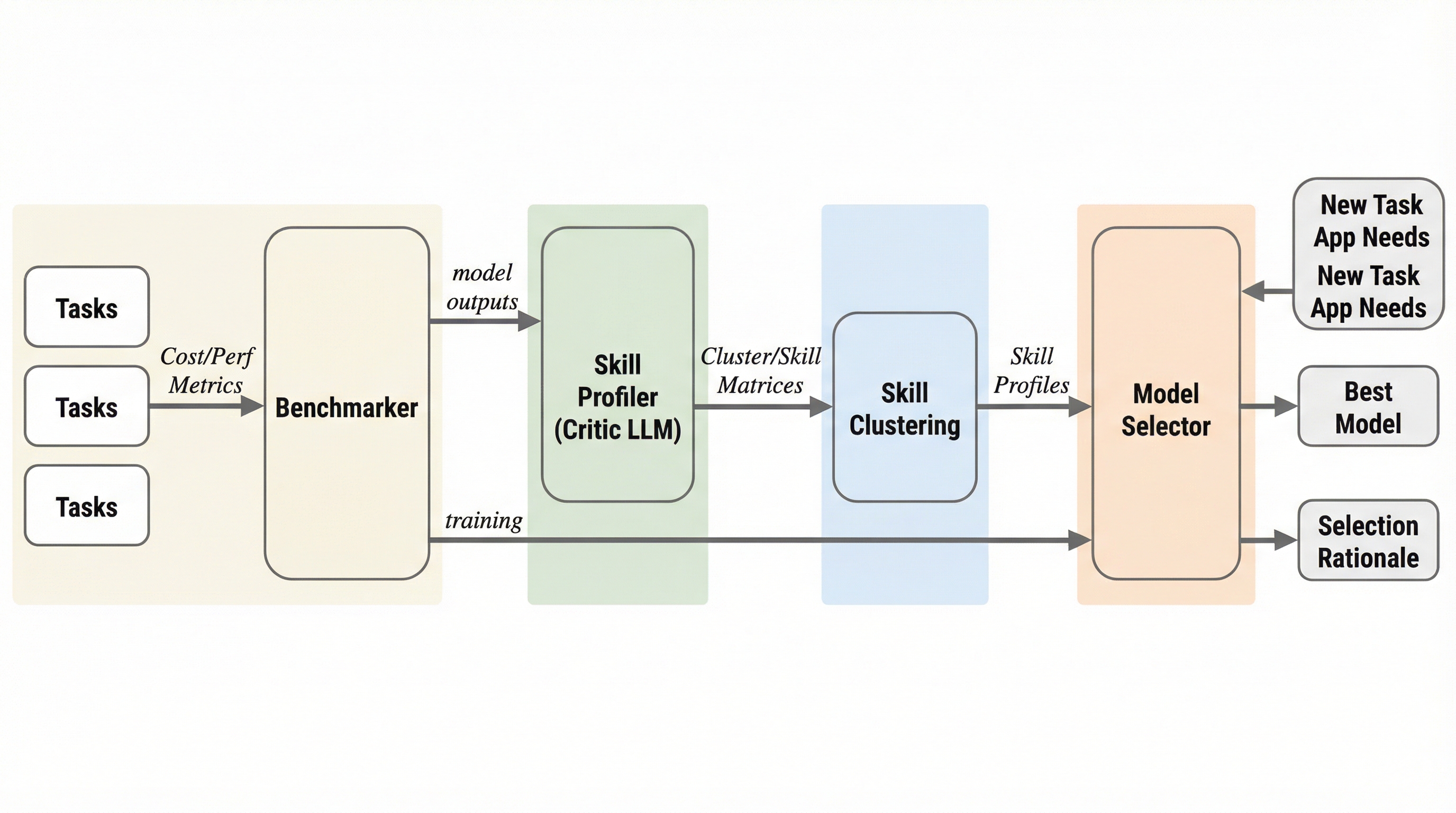

- 批評役(critic)LLMで出力を解析し、スキルを束ねた行列に落としてから、多目的最適化で選ぶ。評価スコアの丸め方を変えるのではなく、出力の中身を材料にして“能力の地図”を作り、その上で選択を最適化する流れになっている。

なぜこの問題か

LLMの選択は、いまや「性能が高いものを買う」だけでは済まない話になりました。実運用では、コストやレイテンシといった制約が必ず入り込み、理想論の“ベストモデル”がそのまま採用できるとは限りません。だからこそ現実の意思決定は、「どれが一番賢いか」ではなく「この条件でどれが一番筋がいいか」へと寄っていきます。

核心:何を提案したのか

提案はBELLA(Budget-Efficient LLM Selection via Automated skill-profiling)という枠組みです。狙いはシンプルで、「タスクに対して最適なLLMを、スキルに基づいて選ぶ」。しかも「予算制約を明示的に」扱う。ここでの“最適”は、単発のスコア勝負ではなく、制約込みでの選択として定義されているのが重要です。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related