ノイズの幾何学:なぜ拡散モデルはノイズ条件付けを必要としないのか

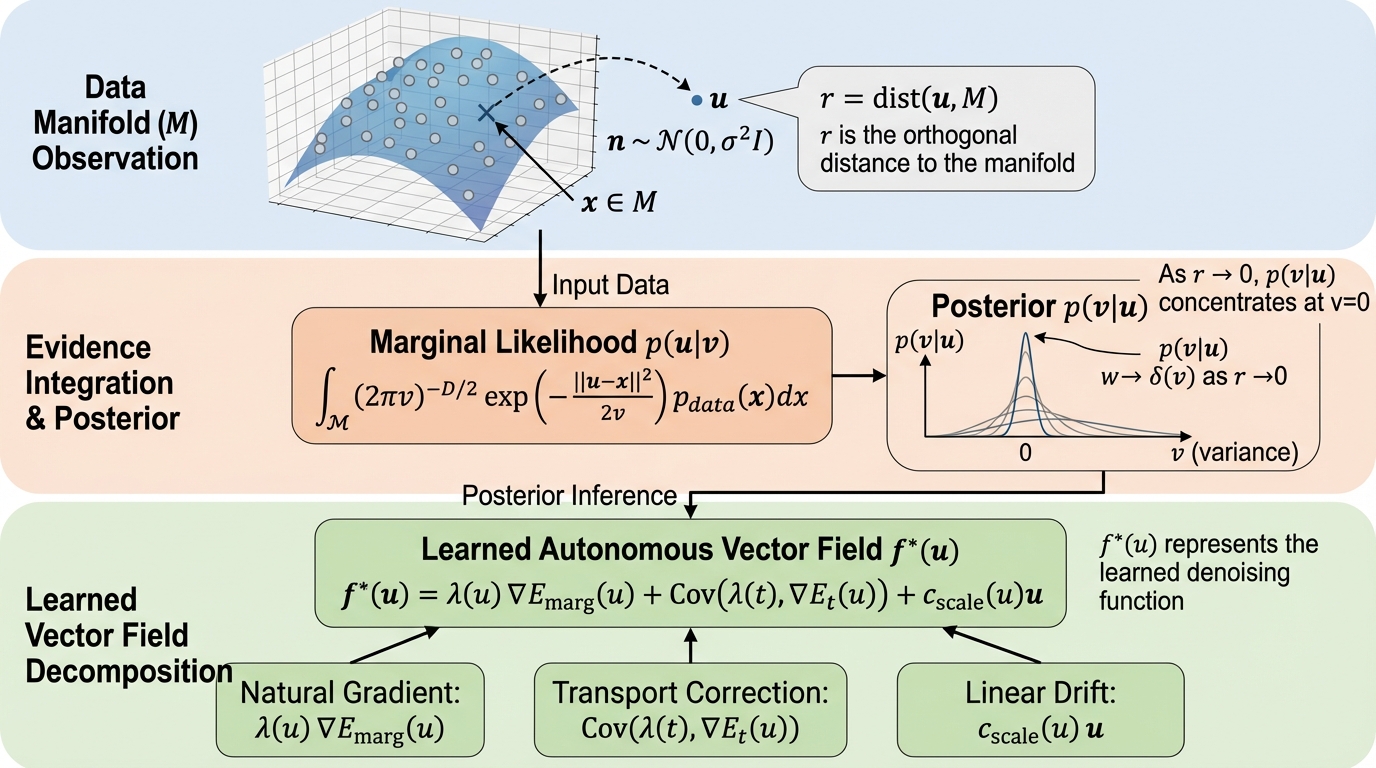

ノイズレベルを入力しない自律(ノイズ非依存)生成モデルでも、学習された単一の時間不変ベクトル場は「闇雲なデノイズ」ではなく、未知ノイズを周辺化した周辺密度 \(p(\mathbf{u})=\int p(\mathbf{u}\mid t)p(t)\,dt\) に対応する周辺エネルギー \(E_{\text{marg}}(\mathbf{u})=-\log p(\mathbf{u})\) の幾何と結び付いています。 / ただし周辺エネルギーの生の勾配はデータ多様体の法線方向に \(1/t^p\) 型の特異性を持ち、通常の勾配降下では不安定になり得ますが、論文は相対エネルギー分解により、学習場が局所的な共形計量(実効ゲイン)を暗黙に含むリーマン勾配流として振る舞い、特異性を前処理して打ち消す構図を示します。 / さらに自律サンプリングの構造安定性条件を与え、ノイズ予測パラメータ化には推定誤差を増幅し得る「Jensen Gap」がある一方、速度ベースのパラメータ化は有界ゲイン条件により後部分布の不確実性を滑らかな幾何学的ドリフトへ吸収できる、という含意を導きます。

TL;DR(結論)

- ノイズレベルを入力しない自律(ノイズ非依存)生成モデルでも、学習された単一の時間不変ベクトル場は「闇雲なデノイズ」ではなく、未知ノイズを周辺化した周辺密度 (p(\mathbf{u})=\int p(\mathbf{u}\mid t)p(t)\,dt) に対応する周辺エネルギー (E_{\text{marg}}(\mathbf{u})=-\log p(\mathbf{u})) の幾何と結び付いています。

- ただし周辺エネルギーの生の勾配はデータ多様体の法線方向に (1/t^p) 型の特異性を持ち、通常の勾配降下では不安定になり得ますが、論文は相対エネルギー分解により、学習場が局所的な共形計量(実効ゲイン)を暗黙に含むリーマン勾配流として振る舞い、特異性を前処理して打ち消す構図を示します。

- さらに自律サンプリングの構造安定性条件を与え、ノイズ予測パラメータ化には推定誤差を増幅し得る「Jensen Gap」がある一方、速度ベースのパラメータ化は有界ゲイン条件により後部分布の不確実性を滑らかな幾何学的ドリフトへ吸収できる、という含意を導きます。

なぜこの問題か

拡散モデルやスコアベースモデルでは、通常、ノイズレベル(時間)(t) をネットワークに明示的に与え、(\mathbf{u}) と (t) の組に対して時間依存の場を学習します。ところが Equilibrium Matching や blind diffusion のように、(t) に条件付けず、単一の時間不変ベクトル場 (f_\theta(\mathbf{u})) だけで生成を行う自律(noise-agnostic)モデルが現れ、標準的な前提が揺らいでいます。直感的には、同じ観測 (\mathbf{u}) でも「どれほど汚れているか」によって、辿るべき方向や強さが変わりそうです。高ノイズ状態からの移動と低ノイズ状態からの移動を、同じ静的な場で同時に適切に扱えるのかが、まず疑問になります。 さらに難しいのは、データ多様体に近付くほど勾配が発散しやすいという幾何学的事情です。多様体近傍では、理想的なエネルギーやスコアが急激に変化し、式の上では無限大に近づくことがあります。一方でニューラルネットワークが出力できるベクトルは通常有界であり、この「発散する幾何」と「有界な実装」の間に矛盾が生じます。…

核心:何を提案したのか

提案の中心は、自律生成モデルが暗黙に従う「最適化される地形」を、周辺エネルギーとして定義し直すことです。具体的には、ノイズレベル (t) を事前分布 (p(t)) で周辺化した周辺密度を (p(\mathbf{u})=\int p(\mathbf{u}\mid t)p(t)\,dt) と置き、その負の対数として (E_{\text{marg}}(\mathbf{u})=-\lo…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related