深層複合AIシステムのためのテキスト平衡伝搬

大規模言語モデル(LLM)やツールを組み合わせた複合AIシステムが深層化するにつれ、従来のグローバルなテキストフィードバック手法では、情報の爆発によるコンテキスト超過や、情報の消失による具体性の欠如という深刻な課題に直面しています。

TL;DR(結論)

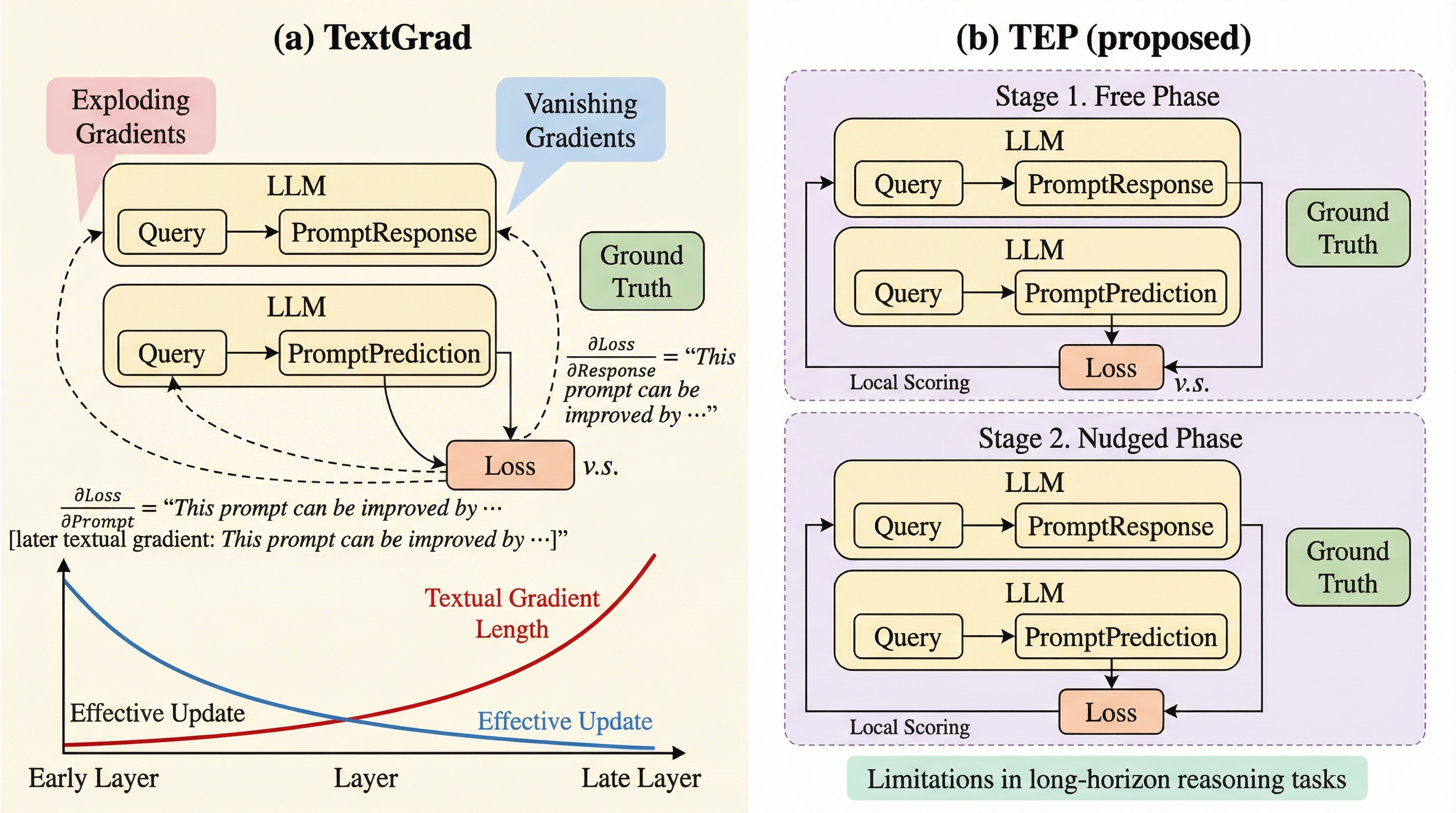

大規模言語モデル(LLM)やツールを組み合わせた複合AIシステムが深層化するにつれ、従来のグローバルなテキストフィードバック手法では、情報の爆発によるコンテキスト超過や、情報の消失による具体性の欠如という深刻な課題に直面しています。本論文が提案する「テキスト平衡伝搬(TEP)」は、エネルギーベースモデルの学習原理を応用し、各ノードで局所的な最適化を行う「自由フェーズ」と、タスク目標に沿った微調整を行う「ナッジフェーズ」の2段階構成によって、深層システムでも信号の質を維持します。検証の結果、TEPは長期間の推論を必要とするQAやマルチエージェントのツール利用タスクにおいて、既存のTextGrad手法を精度と効率の両面で一貫して上回り、特にシステムの階層が深くなるほどその優位性が顕著になることが示されました。

なぜこの問題か

現代のAIシステムは、単一のモデルではなく、LLM、リトリーバー、ツール、検証器などを組み合わせた「複合AIシステム」として構築されることが一般的になっています。これは、マルチホップ推論や反復的な計画、大規模なツール操作など、複雑で長期的なワークフローを処理するために不可欠なアプローチです。しかし、ワークフローが深く複雑になるにつれて、単一のエージェント構成では多様なサブタスクに対する専門知識が不足し、中間段階でのエラーが蓄積され、実行トレースが長くなることでコンテキスト制限に達するという限界が明らかになってきました。 これに対し、TextGradのような「テキストによる自動微分」の手法が登場し、計算グラフを通じてテキストフィードバックを逆伝搬させることで、プロンプトやツールの設定を最適化することが可能になりました。しかし、このグローバルな逆伝搬手法は、深層学習における勾配消失や勾配爆発と同様の、深さに依存する2つの失敗モードに直面します。 第一の失敗モードは「テキスト勾配の爆発」です。これは、フィードバックが階層を遡るごとに指数関数的に増大し、メッセージが極端に長くなる現象を指します。…

核心:何を提案したのか

本論文は、深層複合AIシステムの最適化における信号劣化を解決するために、エネルギーベースモデルにおける「平衡伝搬(Equilibrium Propagation)」の概念をテキスト領域に適応させた「テキスト平衡伝搬(TEP)」を提案しました。TEPの核心は、システム全体にわたる長いフィードバックの連鎖を避け、局所的な学習原理を導入することにあります。 TEPは、グローバルな逆伝搬に頼るのではなく、各ノードにおいて2つのフェーズを通じて最適化を行います。まず「自由フェーズ(Free Phase)」では、各ノードのLLM批判器が、局所的な基準に基づいてプロンプトを反復的に改善し、これ以上の改善案が出なくなる「平衡状態」に達するまで調整を行います。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related