負債としての安定性:LLMにおける言語構造の体系的崩壊

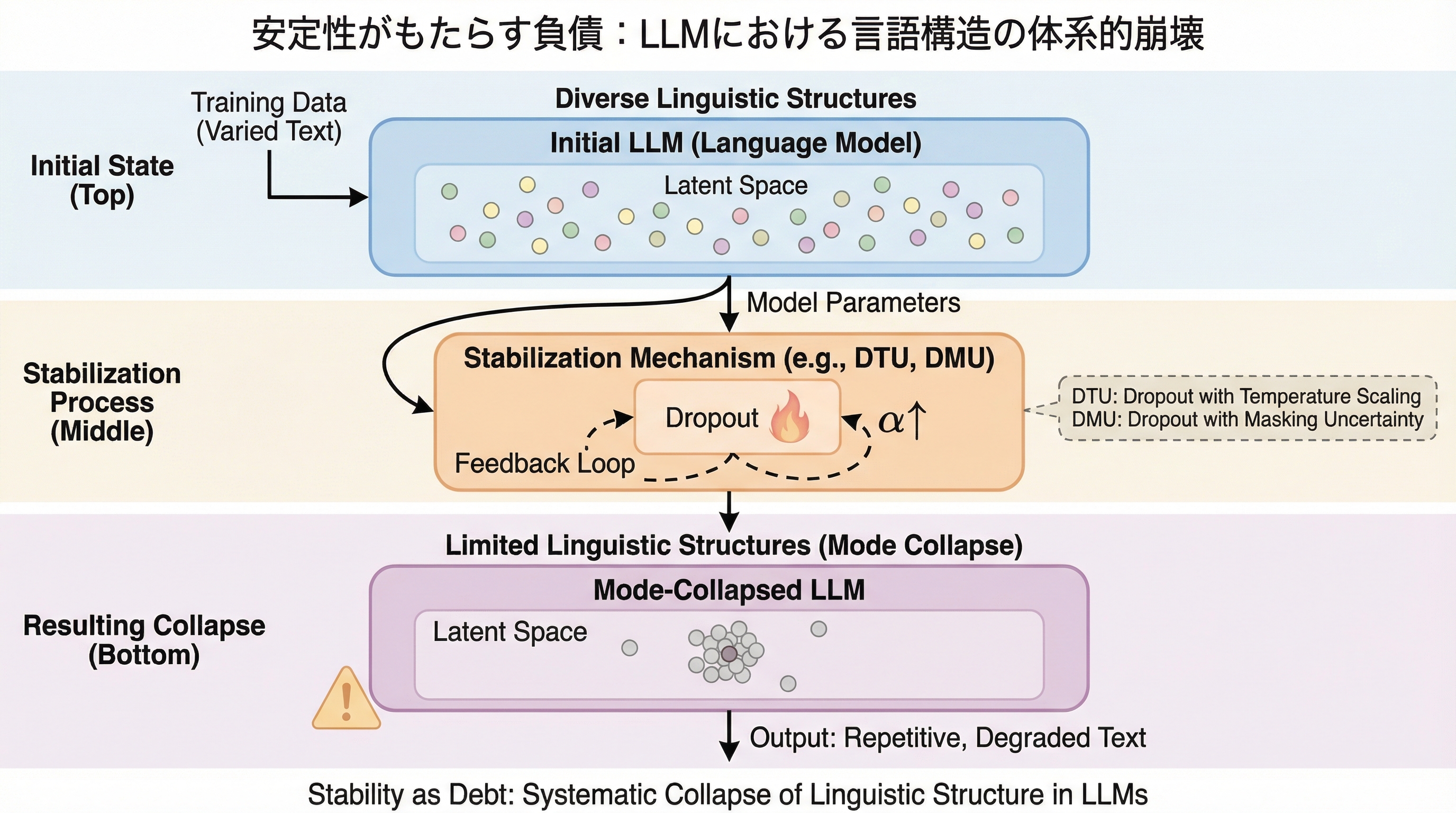

大規模言語モデルの学習において、従来は最適化の必須条件とされていた「学習の安定性」が、実は生成される言語構造の体系的な崩壊を招く「負債」となり得ることを、理論的証明と実験的検証の両面から明らかにしました。

TL;DR(結論)

大規模言語モデルの学習において、従来は最適化の必須条件とされていた「学習の安定性」が、実は生成される言語構造の体系的な崩壊を招く「負債」となり得ることを、理論的証明と実験的検証の両面から明らかにしました。 標準的な最尤推定(MLE)学習の下で安定したパラメータ軌道を追求すると、モデルは前方KLダイバージェンスを最小化する定常解に収束し、生成エントロピーを暗黙的に減少させて特定のパターンに確率を集中させるモード崩壊を引き起こします。 フィードバック制御を用いた検証により、学習損失が円滑に収束している場合でも、内部ダイナミクスの安定性が高まるほど出力が低エントロピー化し、反復的で多様性の欠けた生成挙動に陥るという、最適化の成功と生成品質の乖離を特定しました。

なぜこの問題か

大規模ニューラルネットワークの学習において、勾配クリッピングや正規化、移動平均更新、正則化、そしてフィードバック制御といった安定化技術は、収束を保証し学習の信頼性を高めるために不可欠な要素と見なされてきました。実務上、学習ダイナミクスの安定性は疑いようのない望ましい特性として扱われ、損失関数の円滑な減少がモデルの質の向上を示す主要な指標となってきました。しかし、既存の手法は主に報酬信号や教師あり損失といったタスクに直結する目的の安定化に注力しており、トークンレベルの分布やエントロピーの推移、あるいは生成の終了挙動といった内部的な生成ダイナミクスの安定性がもたらす影響については、これまで十分な注意が払われてきませんでした。 本研究では、内部生成ダイナミクスの過度な安定化が、たとえ学習目的が改善し続けている状況であっても、高度に安定しながらも退化した挙動を誘発する可能性があるという未解明の現象を特定しました。これは、最適化の安定性と生成の表現力が必ずしも一致しないことを示唆しており、安定性のみでは生成品質を評価する指標として不十分であることを提起しています。…

核心:何を提案したのか

本研究は、学習の安定化が生成分布に与える影響を体系的に分析し、安定した学習軌道が言語構造の崩壊を招くメカニズムを提案しました。具体的には、標準的な最尤推定(MLE)学習において、安定したパラメータ軌道が定常解へと導かれる際、それが経験的分布に対する前方KLダイバージェンスを近似的に最小化することを理論的に証明しました。この最小化プロセスは、モデルが生成するエントロピーを暗黙的に減少させ、確率質量を経験的モードの限定的なサブセットに集中させる「安定性誘発型モード崩壊」を引き起こします。 研究チームは、この現象が学習の失敗や不適切な最適化、あるいはハイパーパラメータの選択に起因するものではなく、セマンティックな整合性を伴わない内部ダイナミクスの安定化によって頑健に発生することを明らかにしました。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related