Seg-MoE: 時系列予測のためのセグメント単位の混合専門家モデル

時系列予測におけるTransformerモデルのスケーリングと長期的な動態把握の課題に対し、従来のトークン単位ではなく、連続するタイムステップを一つのセグメントとしてルーティングする新しい疎な混合専門家(MoE)アーキテクチャ「Seg-MoE」を提案している。

TL;DR(結論)

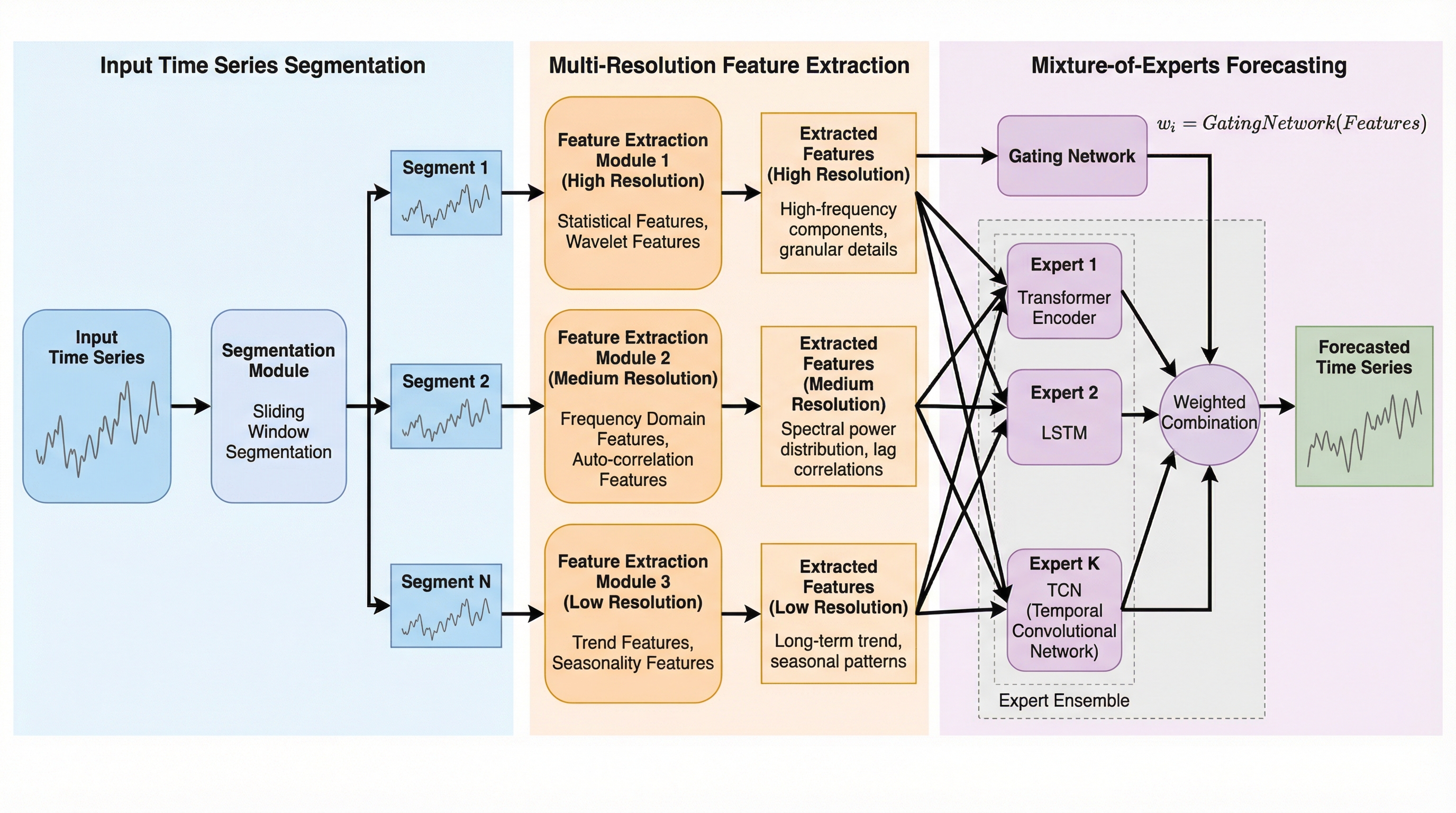

時系列予測におけるTransformerモデルのスケーリングと長期的な動態把握の課題に対し、従来のトークン単位ではなく、連続するタイムステップを一つのセグメントとしてルーティングする新しい疎な混合専門家(MoE)アーキテクチャ「Seg-MoE」を提案している。 この手法は、入力シーケンスを重複のないセグメントに分割して専門家ネットワークに割り当てることで、セグメント内の相互作用を直接モデル化し、時系列データが持つ局所的な構造や連続性を最大限に活用する強力な帰納バイアスを導入している。 多変量の長期予測ベンチマークにおいて、従来の密なTransformerやトークン単位のMoEモデルを一貫して上回る最先端の予測精度を達成しており、層ごとにセグメントの解像度を変える多解像度設計が、複雑な時間的階層を捉える上で極めて有効であることを実証した。

なぜこの問題か

時系列予測は、金融、エネルギー管理、ヘルスケア、気候モデリングなど、現代社会の多岐にわたる分野において、データに基づいた意思決定を支える極めて重要なタスクである。近年、Transformerベースのモデルが長期予測において大きな進歩を遂げているが、これらのアーキテクチャは、長期的な時間ダイナミクスを捉えようとすると、スケーリングの効率性に深刻な課題が生じる。標準的なTransformerは、すべてのパラメータをすべてのタイムステップで活性化させる密な構造を持っており、注意機構の計算コストが系列長に対して二次関数的に増大するため、実世界の制約下でモデル容量を拡大することが困難であった。 このボトルネックを解消するために、自然言語処理の分野で成功を収めている混合専門家(MoE)レイヤーの導入が検討されている。MoEは、入力ごとにパラメータのサブセットのみを動的に活性化させることで、計算コストを抑えつつモデル容量を大幅に拡大できる手法である。しかし、既存の時系列向けMoEアプローチは、言語モデルから継承したトークン単位のルーティングメカニズムに依存している。…

核心:何を提案したのか

本研究では、時系列データの局所性と時間的文脈を最大限に活用するための新しいMoE設計である「Seg-MoE」を提案している。Seg-MoEの核心的なアイデアは、従来のトークン単位のルーティングから、連続するタイムステップをまとめたセグメント単位のルーティングへと転換した点にある。具体的には、入力シーケンスを重複のない連続したセグメントに再構成し、それらを一つのユニットとして専門家に割り当てる仕組みを導入した。これにより、各専門家はセグメント内の相互作用を直接モデル化できるようになり、時系列データが持つ固有のパターンに自然に適合させることが可能となる。 この設計は、時系列のパターンがしばしば局所的で構成的であるという強力な帰納バイアスに基づいている。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related