リソース制約下におけるロバストな分散学習:(非同期) ADMMによる分散型分位点推定

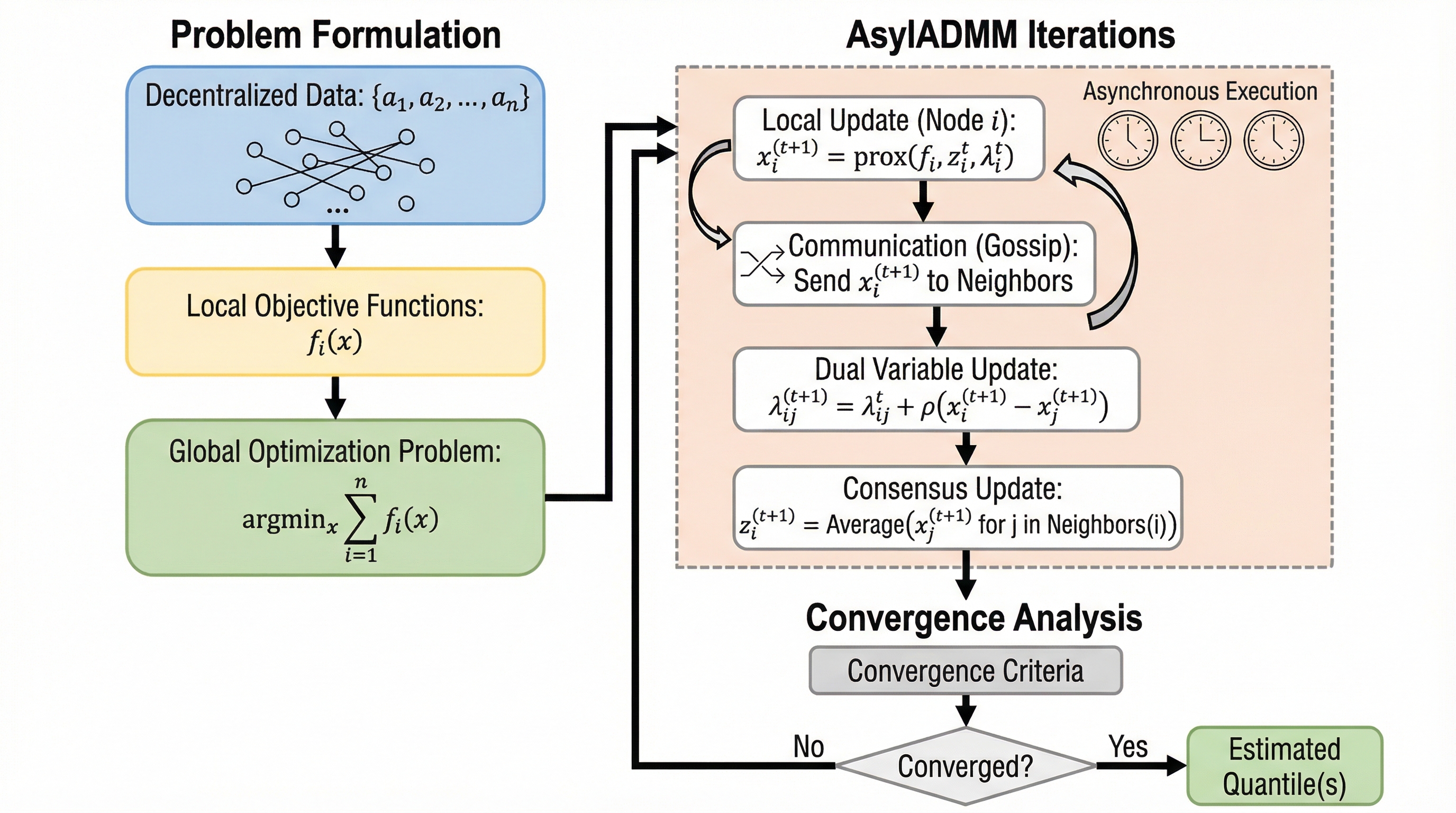

エッジデバイスを用いた分散学習において、通信効率とデータ汚染への堅牢性、そして極めて低いメモリ消費量を同時に実現する新しい非同期アルゴリズム「AsylADMM」を提案しました。 従来の分散ADMM手法がノードの次数に応じてメモリ使用量を増大させていたのに対し、本手法は各ノードが保持する変数をわずか2つに限定することで、リソース制約の厳しい環境でも動作可能です。 実験の結果、データの汚染がある状況下でも既存手法より高速かつ安定して収束し、分位点ベースのトリミングや幾何学的中央値の推定において優れた性能を示すことが確認されました。

TL;DR(結論)

エッジデバイスを用いた分散学習において、通信効率とデータ汚染への堅牢性、そして極めて低いメモリ消費量を同時に実現する新しい非同期アルゴリズム「AsylADMM」を提案しました。 従来の分散ADMM手法がノードの次数に応じてメモリ使用量を増大させていたのに対し、本手法は各ノードが保持する変数をわずか2つに限定することで、リソース制約の厳しい環境でも動作可能です。 実験の結果、データの汚染がある状況下でも既存手法より高速かつ安定して収束し、分位点ベースのトリミングや幾何学的中央値の推定において優れた性能を示すことが確認されました。

なぜこの問題か

現代の大規模な機械学習において、分散学習は不可欠な要素となっており、特にエッジAIシステムの急速な発展に伴い、その重要性は増しています。多くのアプリケーションでは、接続されたセンサーやスマートフォンなどのリソース制約が厳しいデバイス上でデータが直接生成され、処理されます。これらのデバイスは、通信帯域の制限やエネルギー消費、あるいはプライバシー保護の観点から、中央集権的なアーキテクチャに依存することができません。このような背景から、軽量なピア・ツー・ピア通信に依存し、グローバルな調整を必要とせず、ネットワークの規模に応じて自然に拡張できるゴシップ学習手法が注目を集めています。 しかし、既存の多くのゴシップ学習アルゴリズムには、汚染されたデータに対する堅牢性が欠如しているという重大な欠点があります。わずかな割合の不良な測定値が混入するだけで、システム全体のパフォーマンスが著しく低下する可能性があることが指摘されています。中央集権的な設定では外れ値のトリミング手法が標準的ですが、各ノードがローカルな情報しか持たない分散ネットワークにおいて、これらの手法を展開することは非常に困難です。…

核心:何を提案したのか

本論文では、これらの制限を克服するために、非同期かつ軽量なADMMベースのゴシップアルゴリズムである「AsylADMM」を提案しています。このアルゴリズムは、分散環境における中央値および分位点の推定を主目的として設計されており、特にリソース制約の厳しいエッジデバイスでの運用を想定しています。AsylADMMの最大の特徴は、その圧倒的なメモリ効率にあります。既存の非同期ADMM手法がノードの次数 $d$ に対して $2d+1$ 個の変数を必要としたり、エッジの数に依存する変数を保持したりするのに対し、AsylADMMは各ノードでわずか2つの変数(プライマル変数とデュアル変数の集約値)を保存するだけで動作します。 このメモリ節約は、アルゴリズムの更新順序を工夫し、デュアル変数を適切に再パラメータ化することによって実現されました。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related