リファインメントの再考:ノイズ注入を用いない生成バイアスの修正

拡散モデルやフローマッチングにおいて、訓練と推論の乖離から生じる「生成バイアス」を、推論時のノイズ注入なしで修正する新枠組み「Bi-stage Flow Refinement(BFR)」が提案されました。

TL;DR(結論)

拡散モデルやフローマッチングにおいて、訓練と推論の乖離から生じる「生成バイアス」を、推論時のノイズ注入なしで修正する新枠組み「Bi-stage Flow Refinement(BFR)」が提案されました。 この手法は、非可逆モデル向けのデータ空間リファインメント(DFR)と可逆モデル向けの潜在空間リファインメント(LFR)の2段階戦略で構成され、元の決定論的な生成軌道を維持したまま品質を向上させます。 実験では、MNISTにおいてFIDを3.95から1.46へと劇的に改善し、わずか1回の追加計算(1-NFE)で多様性を保ちながら最先端の精度を達成できることが示され、既存モデルの事後的な修正において高い効率性を証明しました。

なぜこの問題か

デノイジング拡散確率モデル(DDPM)やフローマッチング(FM)といった反復的な生成モデルは、画像合成や分子構造生成などの分野で大きな成功を収めていますが、共通の課題として「生成バイアス」が存在します。このバイアスの主な原因は、訓練時と推論時におけるデータの扱いの不一致にあります。訓練段階では、モデルは正解データにノイズを加えた状態から元の状態を復元するように学習しますが、推論段階では、自分自身が直前のステップで生成した不完全な推定値に基づいて次のステップを予測しなければなりません。この不一致により、サンプリングの軌道が本来のデータ分布から徐々に逸脱していく「露出バイアス」に似た現象が発生し、最終的なサンプルの品質を低下させます。 特に高次元のデータや多峰性の分布を扱う場合、フローマッチングモデルは複数の異なる軌道の平均的な速度を予測してしまう傾向があり、これが系統的な誤差の原因となります。また、従来の品質向上手法(リファインメント)の多くは、推論時に再びノイズを注入してサンプリングをやり直す手法を採用していました。しかし、このようなノイズ注入型の戦略は、サンプリングの安定性を損なう可能性があり、計算コストの増大も招きます。…

核心:何を提案したのか

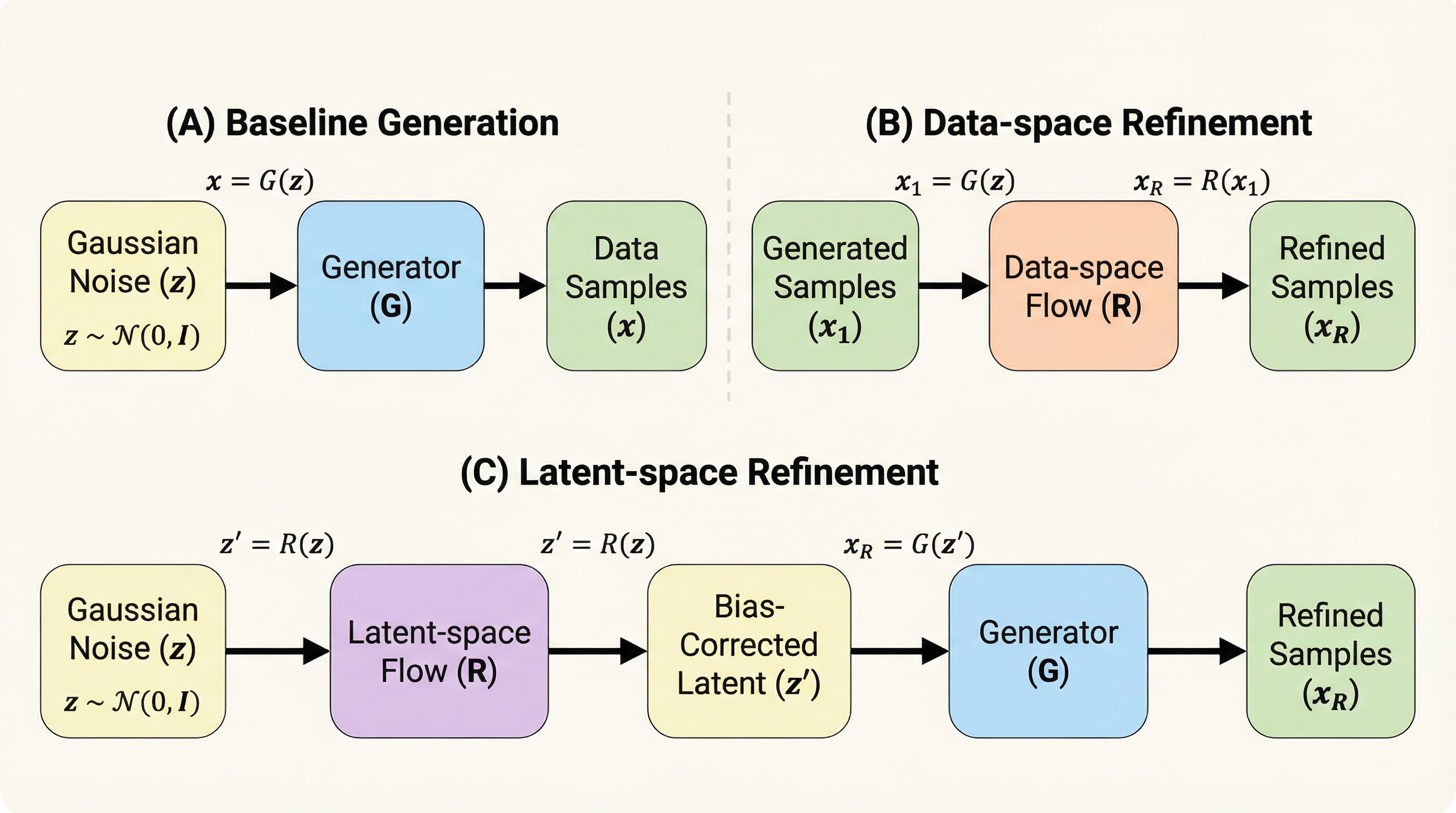

本論文では、既存の学習済み生成モデルを再学習させることなく、事後的な処理としてバイアスを修正する「Bi-stage Flow Refinement(BFR)」というフレームワークを提案しています。BFRの最大の特徴は、推論時にノイズを注入したり、多段階の再サンプリングを行ったりすることなく、決定論的な常微分方程式(ODE)の軌道を保ったまま修正を行う点にあります。このフレームワークは、生成モデルの種類に応じて使い分けられる2つの独立した戦略を提供します。 1つ目は、非可逆なモデルや一般的な生成モデルを対象とした「データ空間フローリファインメント(DFR)」です。これは、生成された予備的なサンプルを、データ空間上で直接修正するフローマッチングモデルを学習する手法です。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related