責任あるAI:善、悪、そしてAI

AI導入による戦略的利益と倫理的・運用的リスクの対立を、単なる二者択一のトレードオフではなく、永続的に共存し相互に依存する「パラドックス」として再定義し、その緊張を動的に管理するための理論的枠組みであるPRAIGを提案している。

TL;DR(結論)

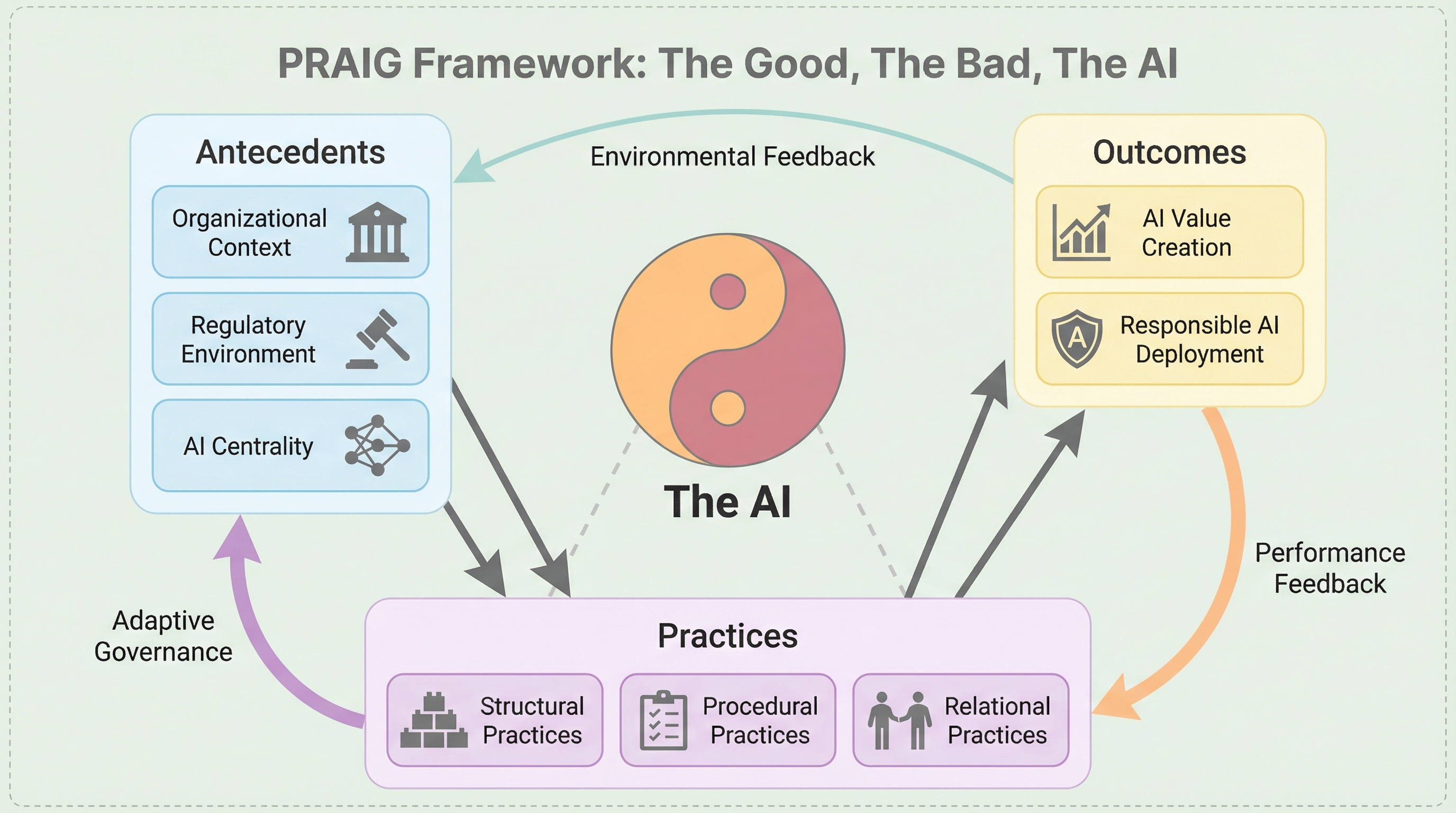

AI導入による戦略的利益と倫理的・運用的リスクの対立を、単なる二者択一のトレードオフではなく、永続的に共存し相互に依存する「パラドックス」として再定義し、その緊張を動的に管理するための理論的枠組みであるPRAIGを提案している。 AIの価値を最大化する「善(利益)」とリスクを最小化する「悪(害)」の要素を体系的に整理し、受容、時間的分離、空間的分離、統合という4つのパラドックス管理戦略を提示することで、組織がイノベーションを阻害せずに責任ある展開を行うための具体的な指針を示した。 欧州連合のAI法などの規制環境の変化に対応しつつ、組織の成熟度や環境の不確実性に応じて最適なガバナンス構造を選択し、構造的・手続き的・関係的な実践を組み合わせることで、長期的な競争優位と社会的信頼を両立させる手法を数理的かつ実証的に体系化している。

なぜこの問題か

人工知能(AI)の急速な普及は、組織に深い戦略的機会をもたらす一方で、重大な倫理的および運用的リスクを導入している。AIは意思決定を改善し、新しい価値を創造する大きな能力を示しており、生成AIは世界経済に毎年数兆ドルを加える可能性があるとされている。組織は、運用の効率化、顧客エンゲージメントの向上、競争上の位置付けの改善を報告している。しかし、これらの利益を可能にする技術的機能は、同時に深刻な懸念を引き起こしている。例えば、AmazonのAI採用システムが女性候補者を体系的に差別した事例や、刑事司法におけるアルゴリズムによる意思決定が人種的バイアスを永続させている現状がある。また、顔認識システムはプライバシーと市民の自由に関する根本的な問いを投げかけている。 これらの事件は孤立した異常事態ではなく、AI導入に固有のシステム的な緊張の現れである。組織が直面している根本的な課題は、AIを採用するかどうかではなく、競争力を維持しながらいかに責任を持って採用するかである。AIの利益とリスクは深く絡み合っている。…

核心:何を提案したのか

本論文は、責任あるAIガバナンスを「トレードオフの最適化問題」としてではなく、「パラドックス管理の課題」として再概念化することを提案している。従来のトレードオフのアプローチは、価値と責任のどちらか一方を優先しようとするが、これはむしろ緊張を増幅させ、根本的な解決には至らない。これに対し、パラドックス理論をレンズとして用いることで、矛盾する要素が同時に存在し、時間の経過とともに持続することを前提とした管理を目指す。この視点に基づき、著者らは「パラドックスに基づく責任あるAIガバナンス(PRAIG)」フレームワークを開発した。 このフレームワークは、AI導入の戦略的利益、固有のリスクと予期せぬ結果、そしてこれらの緊張をナビゲートすることを可能にするガバナンスメカニズムの3つを明確に結びつけている。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related