Transformer推論のためのレート歪み最適化

トランスフォーマーモデルは優れた性能を持つ一方で、推論時に膨大な計算資源とメモリを要求するため、複数のデバイスに処理を分割して実行する手法が注目されていますが、その際に生じる中間表現の転送コストを抑えるための損失あり圧縮フレームワークが新たに提案されました。

TL;DR(結論)

トランスフォーマーモデルは優れた性能を持つ一方で、推論時に膨大な計算資源とメモリを要求するため、複数のデバイスに処理を分割して実行する手法が注目されていますが、その際に生じる中間表現の転送コストを抑えるための損失あり圧縮フレームワークが新たに提案されました。 このフレームワークは情報理論的なレート歪み理論に基づいており、ビットレートとタスク精度のトレードオフを明示的に最適化することで、従来の複雑な手法を凌駕する圧縮効率と精度を両立させています。 さらに、レートとエントロピーのギャップを定義し、確率的にほぼ正しい(PAC)スタイルの境界を導出することで、異なるアーキテクチャやタスクにおける圧縮性能の理論的な裏付けと説明可能性を提示しました。

なぜこの問題か

現代の自然言語処理やコンピュータビジョンにおいて、トランスフォーマー(Transformer)アーキテクチャは事実上の標準となっており、多くのタスクで驚異的な成果を収めていますが、その一方でモデルの巨大化に伴う推論コストの増大が深刻な課題となっています。トランスフォーマーモデルは数億から数千億のパラメータを持ち、推論時には膨大な計算量とビデオメモリ(VRAM)を消費するため、単一のモバイルデバイスやエッジデバイスで実行することは極めて困難です。この問題を解決するために、モデルの計算を複数のデバイスに分割して実行する「分割推論(Split Inference)」という手法が提案されています。これは、例えば計算の初期段階をエッジデバイスで行い、中間データ(中間表現)をクラウドサーバーに送信して残りの計算を行うといった協調的な処理形態を指します。 しかし、分割推論を実現する上での最大の障壁は、デバイス間で転送される中間表現のデータサイズです。…

核心:何を提案したのか

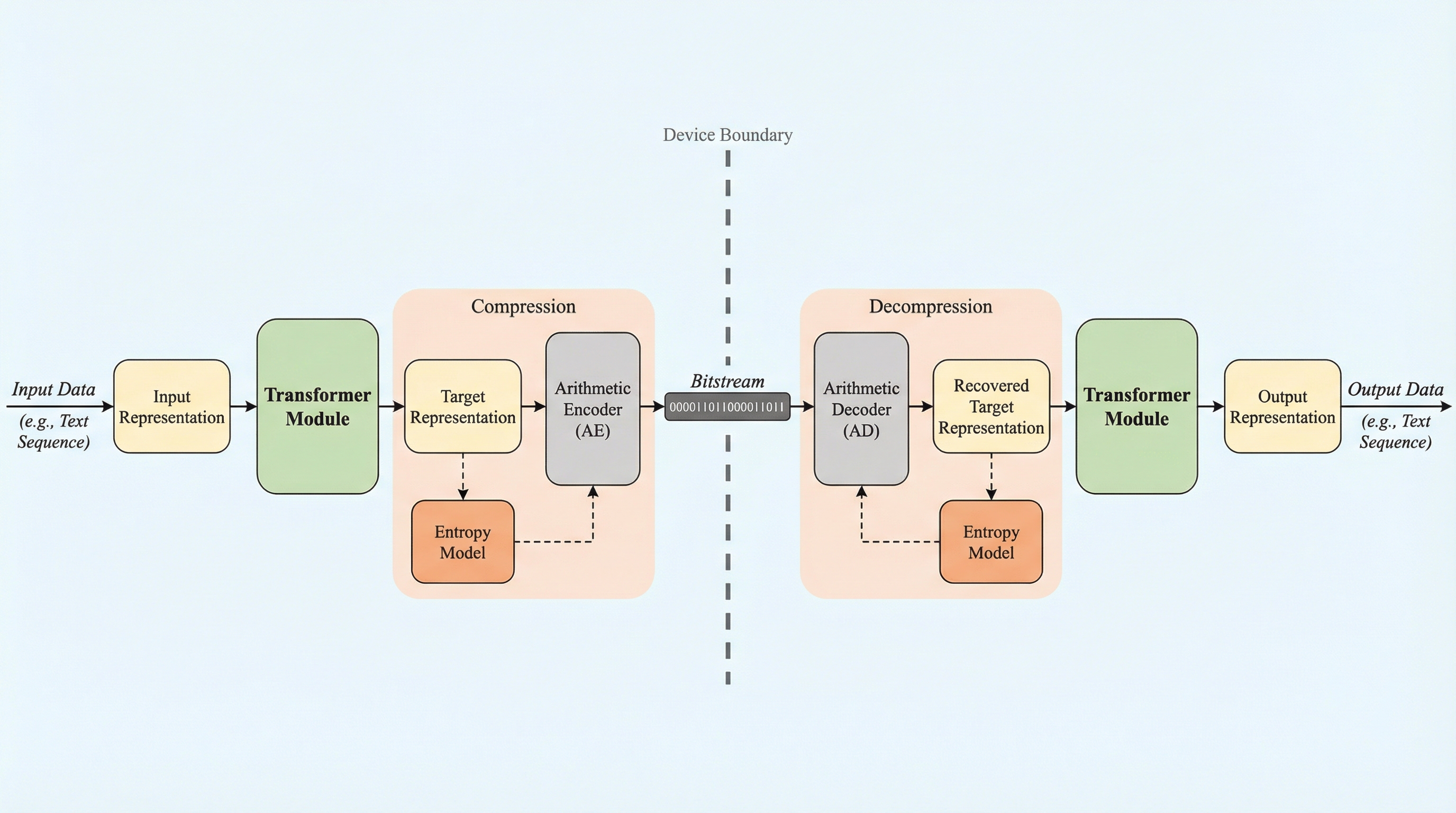

本研究の核心は、トランスフォーマーの中間表現を圧縮するために、レート歪み理論(Rate-Distortion Theory)に基づいた原理的なフレームワークを導入した点にあります。このフレームワークは、中間表現をコンパクトな符号に変換する学習可能なエンコーダと、それを元の空間(あるいはタスクに適した空間)に復元するデコーダから構成される「ニューラルコーデック」として機能します。最大の特徴は、目的関数の中に「ビットレート(情報の長さ)」と「歪み(タスクの損失)」を直接組み込み、ラグランジュ乗数を用いて両者のバランスを明示的に制御できるようにしたことです。これにより、ユーザーは許容できる精度の低下に応じて、最適な通信量を自動的に導き出すことが可能になります。 具体的には、トランスフォーマーの特定の層の後に圧縮モジュールを挿入し、エンドツーエンドで学習を行います。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related