深層強化学習における自然方策勾配のためのフィッシャー逆行列のランク1近似

深層強化学習における自然方策勾配法(NPG)は、学習の収束が早く幾何学的に適切な更新が可能である一方、フィッシャー情報行列(FIM)の逆行列計算にパラメータ数の3乗という膨大な計算コストがかかる点が実用上の大きな障壁となっていました。

TL;DR(結論)

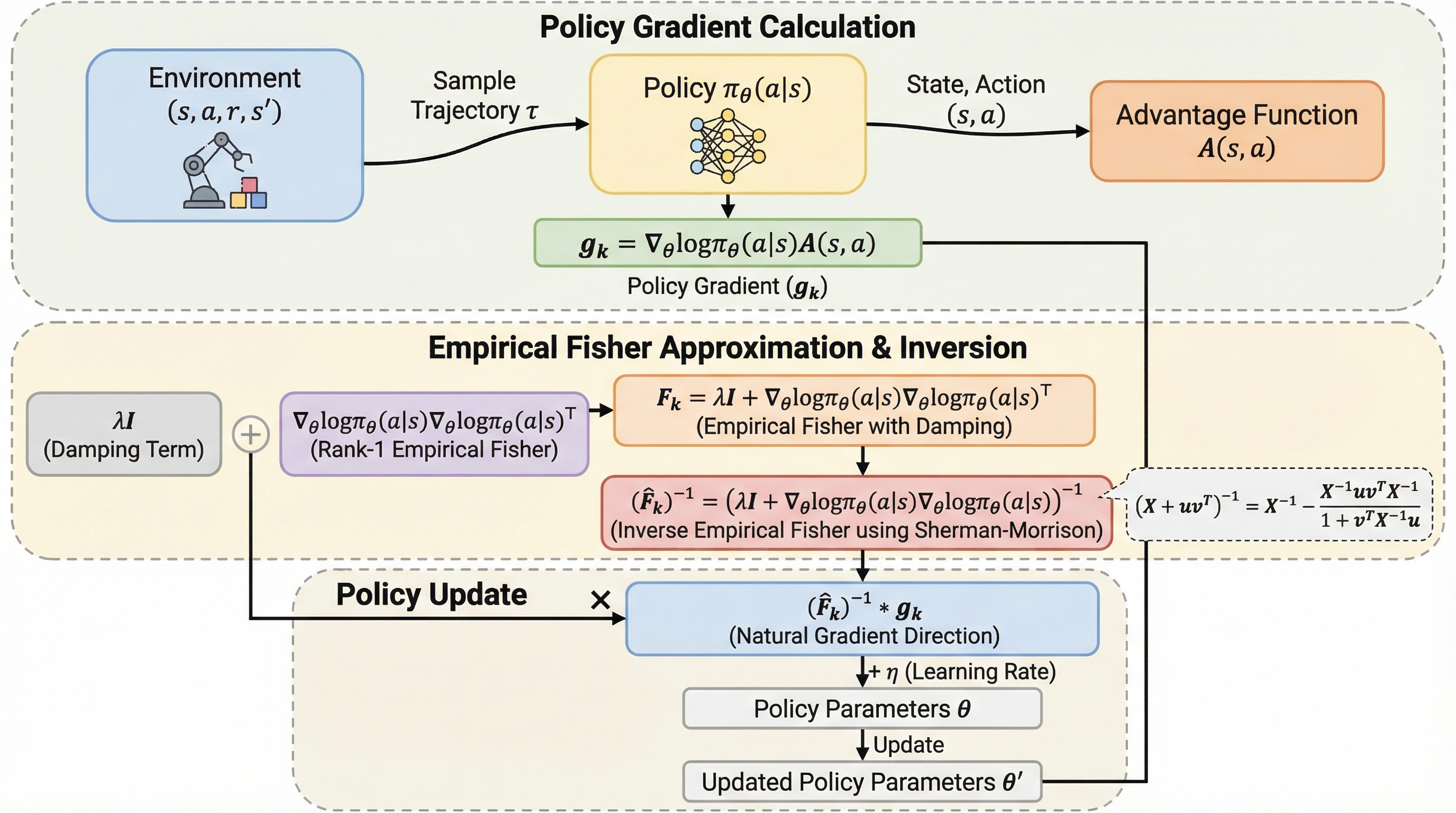

深層強化学習における自然方策勾配法(NPG)は、学習の収束が早く幾何学的に適切な更新が可能である一方、フィッシャー情報行列(FIM)の逆行列計算にパラメータ数の3乗という膨大な計算コストがかかる点が実用上の大きな障壁となっていました。 本研究では、経験的フィッシャー情報行列に対して数学的なシャーマン・モリソンの公式を適用することで、行列の反転を単純なベクトル演算に置き換える「ランク1近似手法」を提案し、計算複雑度をパラメータ数に対して線形オーダーへと劇的に削減することに成功しました。 提案アルゴリズム「SM-ActorCritic(SMAC)」は、OpenAI GymやMuJoCo環境を用いた実験において、標準的なAdamや共役勾配法を用いる手法を上回る収束速度と高い報酬獲得性能を達成し、大規模なニューラルネットワークに対してもスケーラブルに自然勾配を適用できることを実証しました。

なぜこの問題か

方策勾配法は、現代の強化学習において高次元の状態空間を扱うための強力な手法ですが、いくつかの根本的な最適化上の困難を抱えています。強化学習の目的関数は本質的に非凹な性質を持つことが多く、標準的な勾配降下法ではパラメータの更新方向は分かっても適切なステップサイズを決定することが難しいため、不適切な更新によって学習が停滞したり、不安定な挙動に陥ったりすることが頻繁に起こります。特に強化学習では、一度不安定な方策が生成されると質の低いデータしか収集できなくなり、エージェントが局所解から抜け出せなくなるという悪循環が生じます。この問題を解決するために、損失関数の多様体が持つ幾何学的構造を考慮し、フィッシャー情報行列を用いて勾配を補正する自然方策勾配法(NPG)が長年研究されてきました。 NPGは理論的に優れた収束特性を持ち、重みの更新が共変的であるという利点がありますが、実用上の最大の障壁は、パラメータ数に対して2乗のメモリと3乗の計算時間を要するフィッシャー情報行列の逆行列計算にあります。深層学習のようにパラメータ数が数万から数百万に及ぶモデルでは、この計算を各ステップで行うことは事実上不可能です。…

核心:何を提案したのか

本研究の核心は、完全なフィッシャー情報行列の逆行列を、ランク1更新の積み重ねとして近似する、極めて効率的かつスケーラブルな自然方策最適化技術を開発した点にあります。具体的には、期待値としてのフィッシャー情報行列の代わりに、個別のサンプルから得られる勾配の外積を用いる「経験的フィッシャー情報行列」を採用しました。ここに数学的な「シャーマン・モリソンの公式」を組み合わせることで、行列を明示的に反転させることなく、逆行列と勾配ベクトルの積を直接、かつ高速に計算する手法を導出しました。このアプローチの最大の特徴は、計算複雑度をパラメータ次元数に対して線形オーダーに抑えたことです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related