OffSeeker:ディープリサーチエージェントに必要なのはオンライン強化学習だけではない

現在の最先端なディープリサーチエージェントの開発において主流となっている、高額なAPI費用と学習の不安定さを伴うオンライン強化学習に依存せず、高品質なオフライン学習のみで高性能なモデルを構築できることを実証しました。

TL;DR(結論)

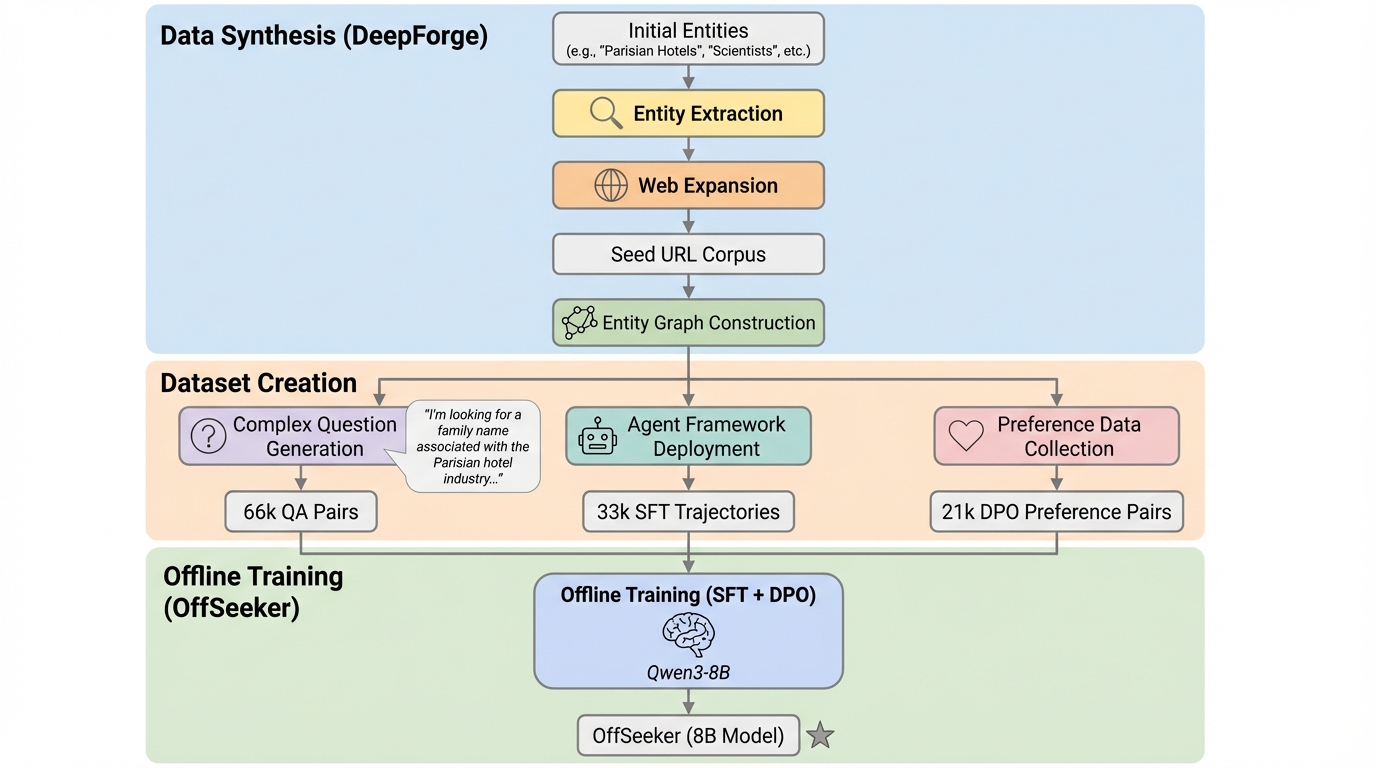

現在の最先端なディープリサーチエージェントの開発において主流となっている、高額なAPI費用と学習の不安定さを伴うオンライン強化学習に依存せず、高品質なオフライン学習のみで高性能なモデルを構築できることを実証しました。 大規模なタスク合成フレームワーク「DeepForge」を導入し、66k件のQA、33k件のSFT軌跡、21k件のDPOペアからなる高品質なオープンソースデータセットを公開することで、計算資源の限られた学術界や個人研究者による研究の民主化を強力に推進しています。 開発された8Bパラメータのモデル「OffSeeker」は、教師あり微調整と直接選好最適化のみで訓練されたにもかかわらず、オンライン強化学習を用いた30B規模の既存システムに匹敵、あるいは凌駕する性能を達成し、コスト効率と再現性を大幅に向上させました。

なぜこの問題か

ディープリサーチエージェントは、長期間にわたる複雑な情報の探索や統合において大きな可能性を秘めていますが、その開発には経済的および技術的な高い障壁が存在しています。現在の最先端モデルの多くはオンライン強化学習(Online RL)に依存しており、学習プロセスの中で外部環境と対話するために検索APIを膨大に呼び出す必要があります。このAPI費用は極めて高額であり、例えば50ステップのGRPOトレーニングを行うだけで約350ドルの費用が発生すると見積もられています。このようなコスト構造は、豊富な資金を持つ一部の産業界の研究所を除いて、学術界や個人の研究者が大規模な実験を行ったり、結果を正確に再現したりすることを著しく困難にしています。また、オンライン学習はウェブのような非定常な環境において学習が不安定になりやすく、検索結果の変動やAPIのレート制限がモデルの収束に悪影響を与えるという技術的な課題もあります。 一方で、オフライン学習はコスト効率の高い代替案となり得ますが、高品質なリサーチ軌跡データの不足がその進展を妨げてきました。…

核心:何を提案したのか

本論文では、高額なオンライン強化学習を必要とせずに強力なリサーチエージェントを構築できることを実証し、そのための完全なオープンソーススイートを提案しました。具体的には、大規模なリサーチクエリを生成するためのタスク合成フレームワーク「DeepForge」と、それを用いて構築された大規模データセット、そしてオフライン学習のみで開発された8Bパラメータのモデル「OffSeeker」を導入しました。DeepForgeは、重い前処理を必要とせずに、ウェブ上の実世界の相互作用を通じて多様なディープリサーチタスクを生成するエンドツーエンドのパイプラインです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related