SLOの達成と時間の劇的削減:OptiKITによる自動化されたエンタープライズLLM最適化

企業が直面する大規模言語モデル(LLM)導入の最大の障壁である、限られたGPU予算内での効率的なスケーリングと、高度な専門知識を要する手動最適化のボトルネックを解消するため、分散型最適化フレームワーク「OptiKIT」を開発しました。

TL;DR(結論)

企業が直面する大規模言語モデル(LLM)導入の最大の障壁である、限られたGPU予算内での効率的なスケーリングと、高度な専門知識を要する手動最適化のボトルネックを解消するため、分散型最適化フレームワーク「OptiKIT」を開発しました。 このシステムは、モデルの圧縮、統計的評価、ベンチマーク、ランタイムのチューニングを自動化し、専門知識を持たないチームでも異種混合のインフラ上で効率的にモデルを配備することを可能にする、宣言的なワークフローに基づいたエンドツーエンドのソリューションを提供します。 eBayの本番環境での検証では、GPUのスループットが2倍から最大2.8倍向上し、エンジニアの作業時間を劇的に削減しながら、サービスレベル目標(SLO)を安定して達成できることが実証され、モデル最適化のプロセスを組織全体で民主化することに成功しました。

なぜこの問題か

現代の企業において大規模言語モデル(LLM)の普及は急速に進んでいますが、それに伴い計算資源の確保という極めて重大な課題が浮き彫りになっています。生成AIへの需要が指数関数的に増加する一方で、高価で供給に限りがあるGPUインフラをいかに効率的に利用するかが、イノベーションを継続するための鍵となっています。特にeBayのようなグローバルなテクノロジー企業では、80億から700億以上のパラメータを持つ巨大なモデルを本番環境に配備することが一般的であり、これらが既存の計算リソースに対して非常に大きな負荷をかけています。従来のモデル最適化手法は、モデル圧縮やハードウェア固有の調整、推論ランタイムのチューニングに関する深い専門知識を持つ少数のスペシャリストに依存する「職人芸」のような状態でした。このような専門知識の不足は、最適化作業を開発プロセス全体のボトルネックに変え、新しいAI機能のリリース速度を著しく低下させる原因となっていました。 また、手動のプロセスは結果にばらつきが生じやすく、リソースの利用効率が必ずしも最大化されないという問題も抱えています。…

核心:何を提案したのか

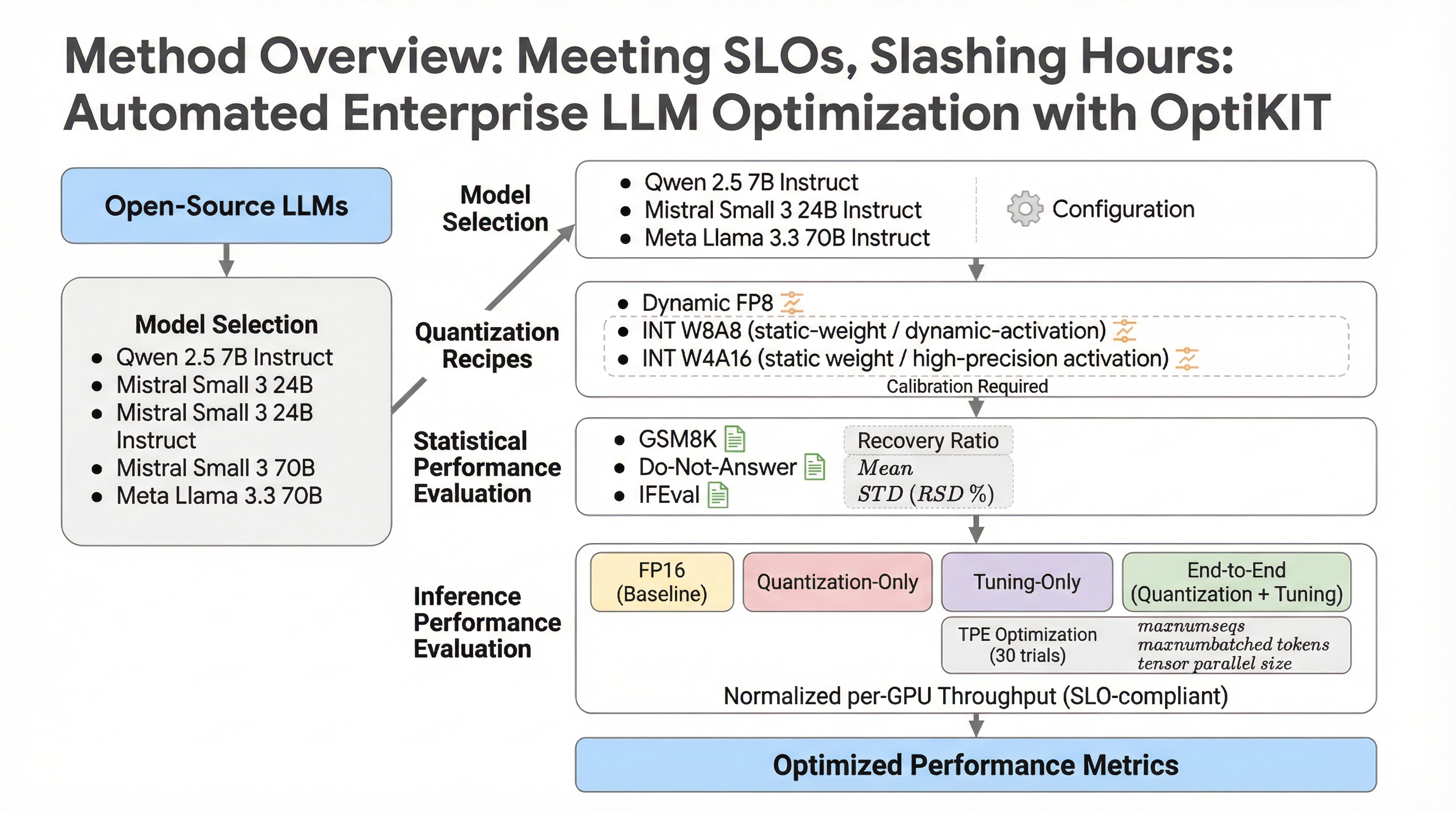

本論文では、LLMの最適化ライフサイクルを完全に自動化し、専門家ではないチームでも高度な最適化を実現可能にする分散型フレームワーク「OptiKIT」を提案しています。このシステムは「自動化」「標準化」「深い企業統合」という3つの基本原則に基づいて設計されており、モデルの取得から分析、リソース割り当て、パフォーマンスのベンチマーク、そして最終的な配備までをシームレスに繋ぐエンドツーエンドのソリューションを提供します。OptiKITの最大の特徴は、複雑な最適化ワークフローを宣言的なタスク定義によって自動化し、再現性と一貫性を確保している点にあります。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related