MAD: マルチモーダル大規模言語モデルにおけるクロスモーダル・ハルシネーション抑制のためのモダリティ適応型デコーディング

マルチモーダル大規模言語モデルにおいて、映像や音声といった異なる感覚情報が互いに干渉し合い、入力データに存在しない情報を捏造してしまう「クロスモーダル・ハルシネーション」という深刻な課題を解決するための新しい推論手法である。

TL;DR(結論)

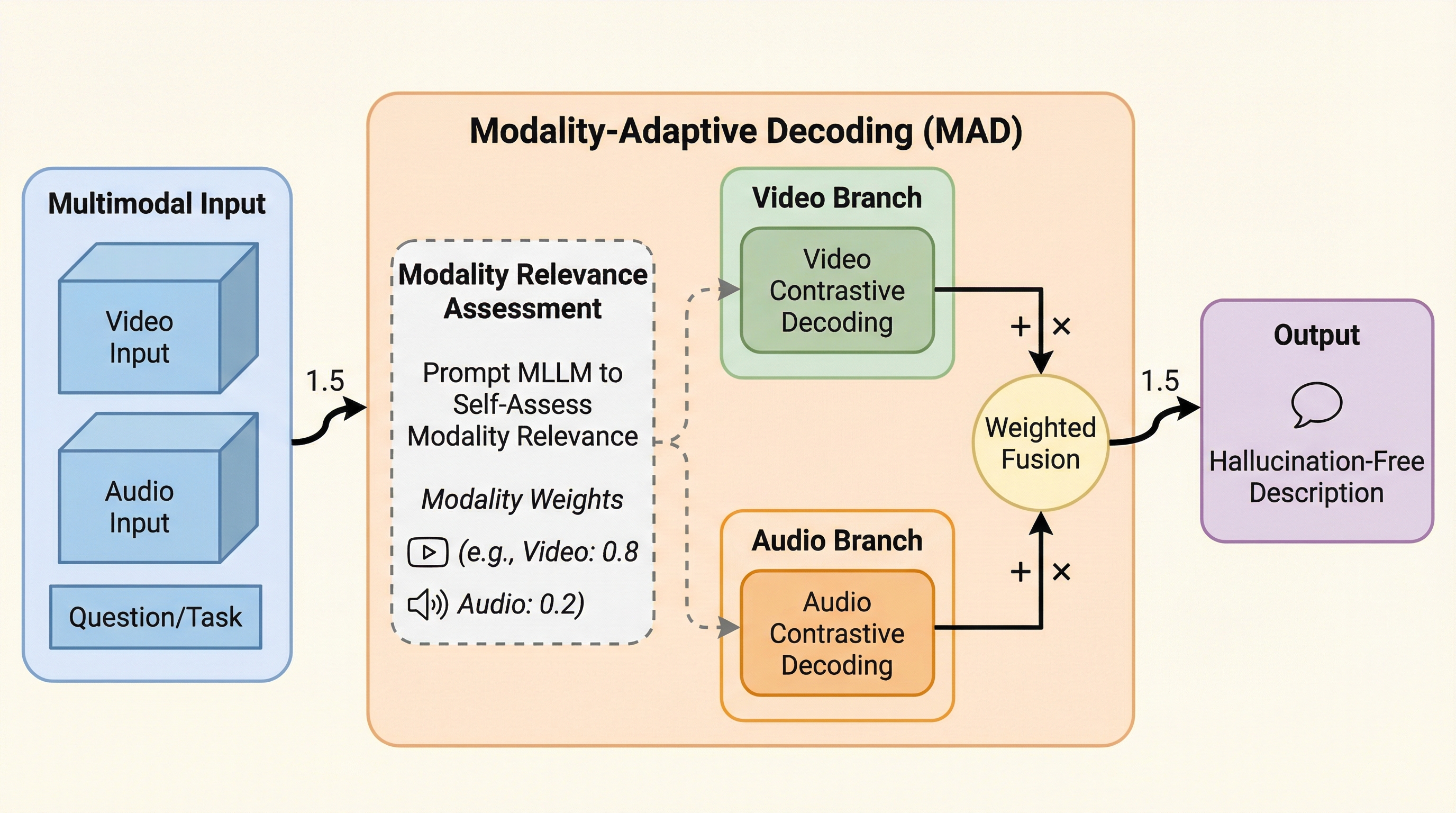

マルチモーダル大規模言語モデルにおいて、映像や音声といった異なる感覚情報が互いに干渉し合い、入力データに存在しない情報を捏造してしまう「クロスモーダル・ハルシネーション」という深刻な課題を解決するための新しい推論手法である。 提案された「Modality-Adaptive Decoding(MAD)」は、追加の学習を一切必要とせず、モデル自身にタスクに必要な情報を自己評価させ、その重要度に基づいてデコーディング時の重みを動的に調整することで、不適切な情報の混入を抑制する。 最新の音声・映像言語モデルを用いた検証の結果、特定の入力に惑わされない正確な推論が可能になり、既存のベンチマークにおいてハルシネーションを大幅に削減しつつ、モデルの信頼性と事実に基づいた回答生成能力を飛躍的に向上させることを実証した。

なぜこの問題か

マルチモーダル大規模言語モデル(MLLM)は、テキストだけでなく映像や音声といった多様な感覚入力を統合することで、人間のような高度な知覚と推論を実現することを目指して急速に発展している。しかし、これらのモデルは単一のモダリティ内での情報の誤りだけでなく、異なるモダリティ間での干渉によって引き起こされる「クロスモーダル・ハルシネーション」という特有かつ深刻な課題に直面している。これは、あるモダリティから得られる強い視覚的あるいは聴覚的なヒントが、別のモダリティに関するコンテンツ生成に不適切な影響を及ぼし、結果として入力データには存在しない事実を捏造してしまう現象である。 例えば、映像の中にボートが映っているという強い視覚情報があるだけで、モデルは実際には録音されていない「魚が跳ねる音」や「釣り竿の使い方を説明する声」を音声情報として捏造してしまうケースが確認されている。このような問題は、単一のモダリティにおける表現能力の不足ではなく、モダリティ間の相互作用を制御する能力の根本的な欠陥に起因している。モデルが各モダリティの境界を適切に維持できず、情報の分離と統合のバランスに失敗していることが原因である。…

核心:何を提案したのか

本研究では、追加の学習や追加のデータアノテーションを一切必要としない、新しい推論時デコーディング手法である「Modality-Adaptive Decoding(MAD)」を提案した。MADの核心的な革新は、モデル自身に各タスクにおけるモダリティの重要性を自己評価させ、その結果に基づいて対照的デコーディングの戦略を動的に適応させる点にある。これは、クロスモーダル・ハルシネーションを抑制するために、タスクに応じたモダリティの要件を明示的に決定し、デコーディングプロセスに反映させる初めてのアプローチである。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related