LOCUS:効率的なモデル探索、比較、および選択のための低次元モデル埋め込み

LOCUSは、大規模言語モデル(LLM)の多様な能力をアテンション機構によって低次元のベクトル(モデル埋め込み)として表現する新しい手法であり、モデルの比較や選択、クエリルーティングを大幅に効率化する。

TL;DR(結論)

LOCUSは、大規模言語モデル(LLM)の多様な能力をアテンション機構によって低次元のベクトル(モデル埋め込み)として表現する新しい手法であり、モデルの比較や選択、クエリルーティングを大幅に効率化する。 決定論的なフォワードパスにより、新規モデルの追加や既存モデルの更新を再学習なしで即座に行える柔軟性を持ち、従来手法と比較して最大4.8倍少ない評価サンプルで高精度な能力予測と最適なモデルへのルーティングを可能にする。 学習された埋め込み空間は幾何学的に意味を持ち、ベクトル間の近接性がモデルの挙動の類似性を反映するため、類似モデルの検索やクラスタリング、代替モデルの特定、効率的なモデルポートフォリオの構築といった実用的なタスクにおいて高い性能を発揮する。

なぜこの問題か

現在、大規模言語モデル(LLM)のエコシステムは爆発的な拡大を遂げており、Hugging Faceなどのプラットフォームには数十万ものモデルが公開されている。これらのモデルは、パラメータサイズ、アーキテクチャ、学習データ、専門とするドメインが多岐にわたっており、特定のクエリに対してどのモデルが最適であるかを判断することは極めて困難な課題となっている。モデルを効果的に管理し活用するためには、各モデルの能力をスケール可能な形で要約し、比較するための統一的な表現手法が必要不可欠である。しかし、既存のアプローチにはいくつかの重大な制約が存在する。まず、モデルのパラメータを直接利用して埋め込みを生成する手法は、モデルのサイズや構造が不均一であることや、多くの高性能モデルがAPI経由でしかアクセスできないクローズドなものであることから、現実的ではない。また、モデルの出力分布(ロジット)を利用する蒸留的な手法も、モデルごとにトークナイザーが異なる場合に整合性を保つことが難しいという問題がある。…

核心:何を提案したのか

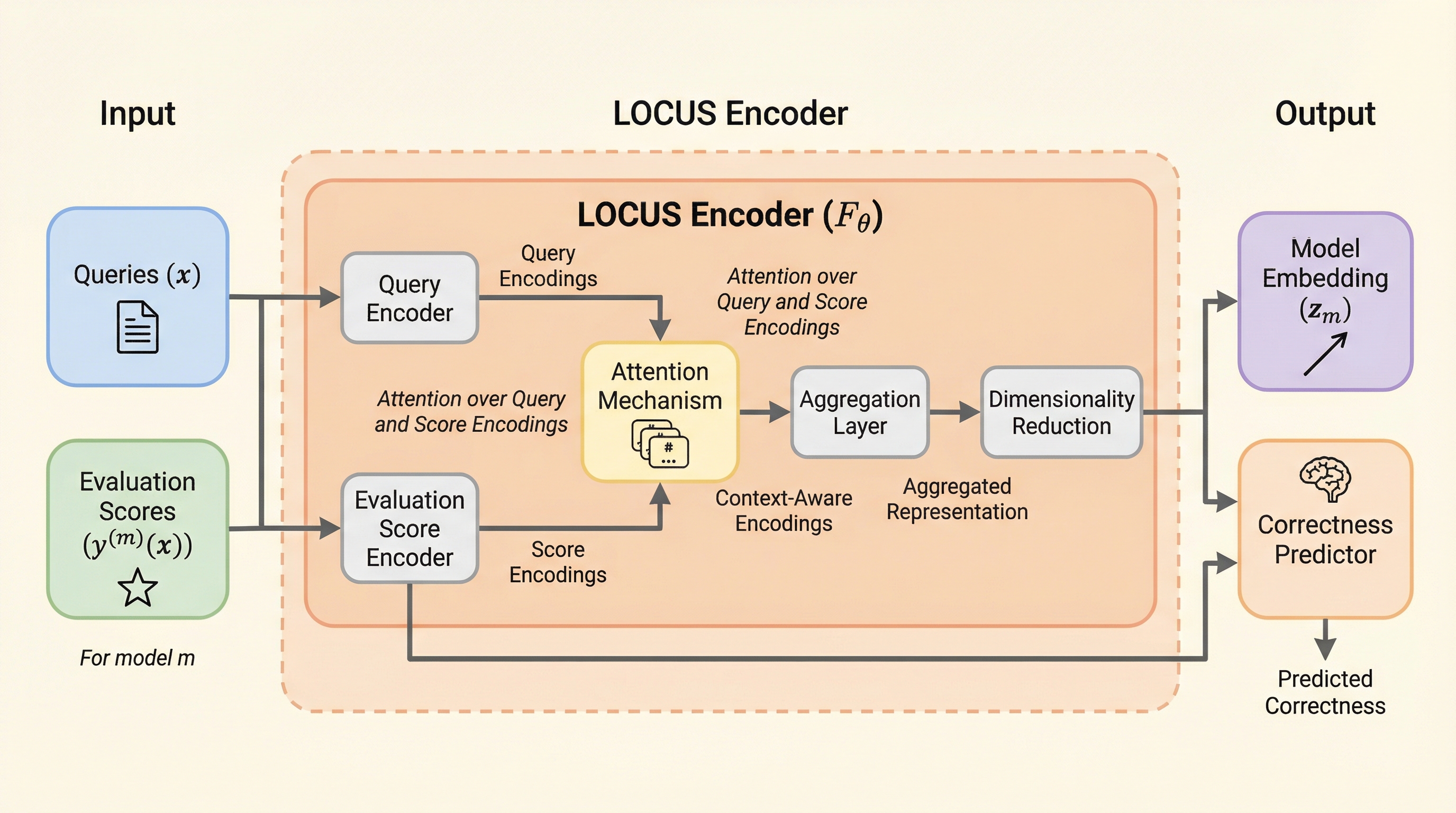

本論文では、モデルの能力を理解するための低次元埋め込み手法である「LOCUS(LOw-dimensional embeddings for Model Capability UnderStanding)」を提案している。LOCUSの核心は、モデルが特定のクエリに対して示したパフォーマンス(正解・不正解などのスコア)の集合を、アテンション機構を用いたエンコーダによって固定次元のベクトルに変換する点にある。このベクトルは「モデル埋め込み」と呼ばれ、そのモデルの広範な能力プロファイルをコンパクトに要約したものとして機能する。LOCUSは、主に2つのコンポーネントで構成されている。1つ目は、クエリのエンコーディングと評価スコアを入力として受け取り、モデル埋め込みを生成するアテンションベースのエンコーダである。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related