異種コンピューティング:AIエージェント推論の未来を支える鍵

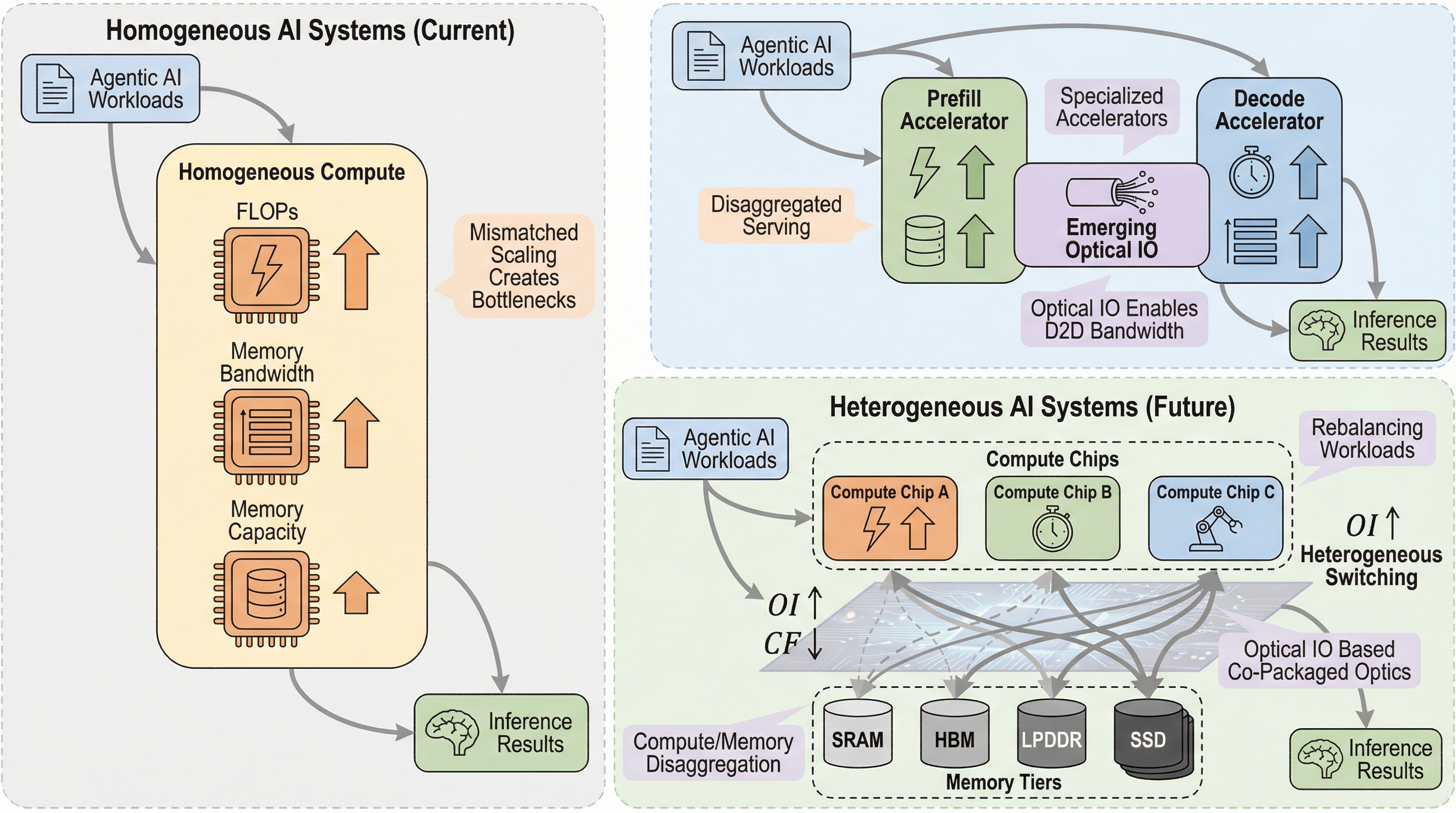

AIエージェントの普及により推論負荷が急増しており、従来のGPU中心の均一なインフラではメモリ帯域幅と容量の限界(メモリの壁)に直面するため、計算・ネットワーク・メモリの全域にわたるシステムレベルの異種(ヘテロジニアス)構成への移行が不可欠である。

TL;DR(結論)

AIエージェントの普及により推論負荷が急増しており、従来のGPU中心の均一なインフラではメモリ帯域幅と容量の限界(メモリの壁)に直面するため、計算・ネットワーク・メモリの全域にわたるシステムレベルの異種(ヘテロジニアス)構成への移行が不可欠である。 本論文は、演算強度(OI)と容量フットプリント(CF)という2つの指標を定義し、チャットボットやコーディング、コンピュータ操作といった異なるエージェントの特性を分析することで、既存のルーフラインモデルでは捉えきれなかったメモリ容量の制約が推論効率を著しく低下させている実態を明らかにした。 解決策として、プリフィル(入力処理)とデコード(生成)の分離、光インターコネクトによる計算とメモリの分散配置、およびハードウェアとモデルの共同設計を提案しており、これにより多様なエージェントのワークロードに対して柔軟かつ高効率なスケーリングを可能にする次世代のAIデータセンター像を提示している。

なぜこの問題か

AIエージェントの台頭は、コンピュータシステムの設計思想を根本から変えつつある。今後数年で建設が予定されているギガワット規模のデータセンターの主な目的は、AIワークロードのサポートである。私たちは、推論が支配的となる未来へと向かっており、AIエージェントが既存および将来の多くのアプリケーションを動かすようになると予想されている。これらのエージェントの推論(順伝播)を実行することは、将来のAIデータセンターにおける主要なワークロードになるだろう。 現在のクラウドコンピューティングでは、CPU指向のワークロードの最適化から始まり、SmartNICのようなネットワークアクセラレータや、GPUのような並列計算ユニットの採用が進んできた。これらのアクセラレータは、入出力(IO)や計算集約的なタスクをオフロードすることで、システムの性能と効率を大幅に向上させてきた。しかし、ChatGPTのリリース以降、AIワークロードは主にGPU中心のインフラに最適化されてきた。 今日、AIエージェントの推論にはさらなる計算の専門化が必要であるという考えが広まっており、NVIDIAのRubin CPXのような推論チップにその傾向が現れ始めている。…

核心:何を提案したのか

本論文の核心的な提案は、AIエージェントの推論プロセスをより詳細に特徴付けるために、演算強度(Operational Intensity: OI)と容量フットプリント(Capacity Footprint: CF)という2つの主要な指標を導入したことである。 演算強度(OI)は、DRAMから移動されるデータ1バイトあたりに実行される演算数として定義される。これはルーフラインモデルで広く使用されている古典的な指標である。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related