分散型LLMコラボレーションを学習するマルチエージェントActor-Critic手法

分散型の大規模言語モデル(LLM)エージェント間の協調を最適化するため、マルチエージェントActor-Critic(MAAC)手法であるCoLLM-CCとCoLLM-DCが提案されました。 従来のモンテカルロ法は、長期的なタスクや報酬が疎な設定において勾配の分散が極めて大きく、学習効率が著しく低下するという課題がありましたが、本手法は批判者(Critic)を導入することでこの問題を解決します。 執筆、コーディング、Minecraftでの建築という多様なドメインでの検証の結果、集中型批判者を用いるCoLLM-CCは、特に複雑で長期的な対話が必要なタスクにおいて、既存手法を大幅に上回る性能と収束の安定性を示しました。

TL;DR(結論)

分散型の大規模言語モデル(LLM)エージェント間の協調を最適化するため、マルチエージェントActor-Critic(MAAC)手法であるCoLLM-CCとCoLLM-DCが提案されました。 従来のモンテカルロ法は、長期的なタスクや報酬が疎な設定において勾配の分散が極めて大きく、学習効率が著しく低下するという課題がありましたが、本手法は批判者(Critic)を導入することでこの問題を解決します。 執筆、コーディング、Minecraftでの建築という多様なドメインでの検証の結果、集中型批判者を用いるCoLLM-CCは、特に複雑で長期的な対話が必要なタスクにおいて、既存手法を大幅に上回る性能と収束の安定性を示しました。

なぜこの問題か

近年、LLMを自律的なエージェントとして活用し、複数のエージェントに役割を割り当てて協力させる試みが活発になっています。しかし、既存の多くの手法は、あらかじめ定義された固定的な実行プロトコルや、すべてのエージェントを統合して管理する集中型の実行環境に依存しています。このような集中型システムは、エージェント間の通信負荷が高く、システムの拡張性に限界があるほか、プライバシー保護の観点からも課題があります。一方で、各エージェントが自身の観察に基づいて独立して推論を行う「分散型LLMコラボレーション」は、並列処理による効率化や柔軟なデプロイが可能であるため、実用面で非常に魅力的です。しかし、分散環境において複数のLLMを効果的に協調させるための最適化手法は十分に確立されていません。 現在、LLMの微調整にはシンプルで効率的なモンテカルロ法が広く採用されています。しかし、これをマルチエージェント環境に拡張すると、エージェントはエピソードの終了時まで報酬信号を待つ必要があり、勾配推定の分散が非常に高くなるという問題が生じます。…

核心:何を提案したのか

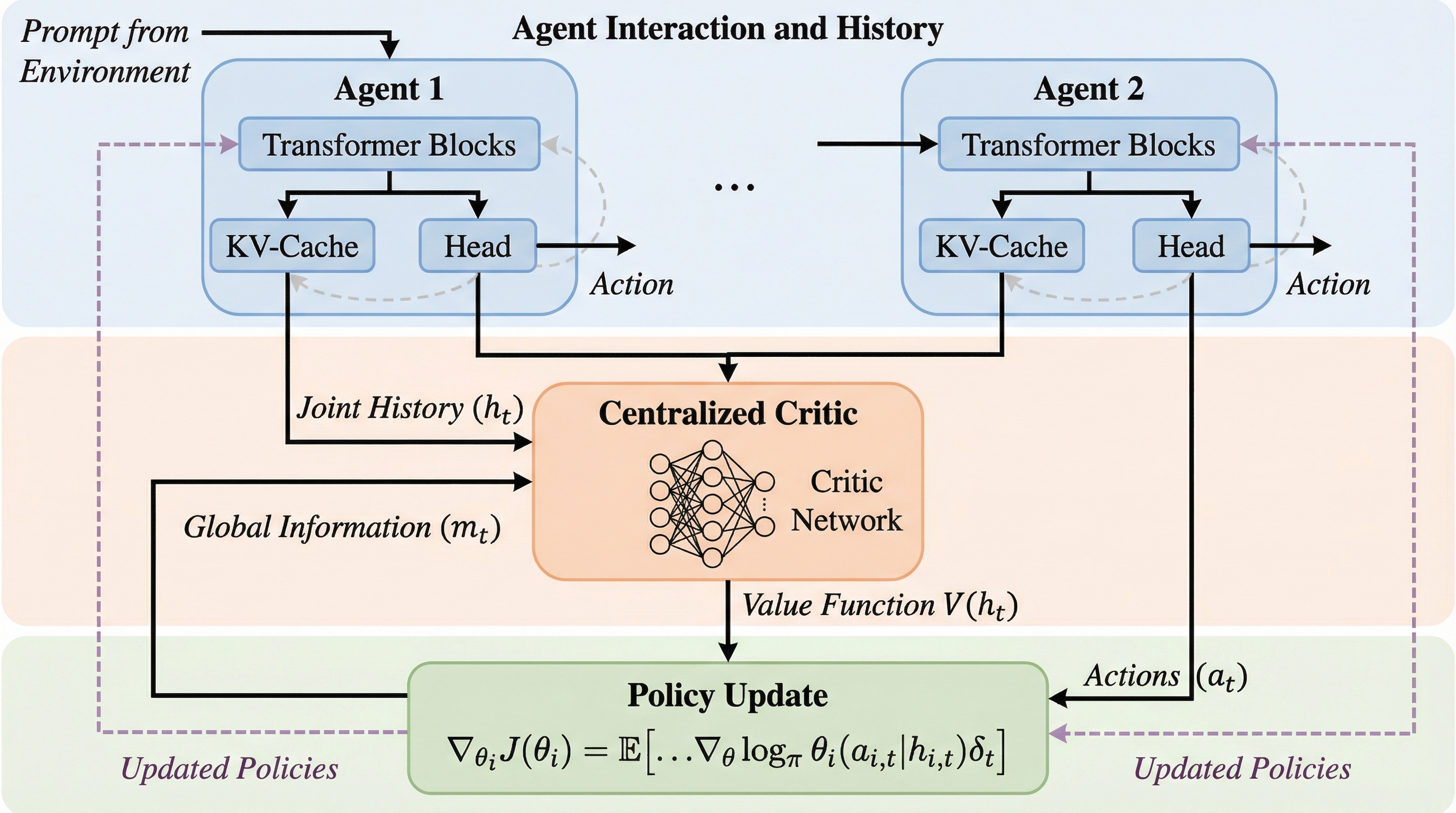

本論文では、分散型LLMコラボレーションを最適化するためのマルチエージェントActor-Critic(MAAC)手法を提案しています。具体的には、学習の安定性と効率を高めるために、以下の2つのアプローチを導入しました。第一のアプローチは「CoLLM-CC(Centralized Critic)」です。これは、学習フェーズにおいて全エージェントの履歴を統合して評価する「集中型批判者」を使用します。実行時には各エージェントが独立して動作する「集中学習・分散実行(CTDE)」のパラダイムを採用しており、学習中のみ追加の情報を利用して正確な勾配推定を行います。第二のアプローチは「CoLLM-DC(Decentralized Critics)」です。これは、各エージェントが個別の批判者を持ち、自身のローカルな履歴に基づいて価値を推定します。これにより、より完全な分散学習が可能になります。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related