HeRo-Q: ヘッセ行列の条件付けによる安定した低ビット量子化のための汎用フレームワーク

大規模言語モデル(LLM)の量子化において、重みの誤差が小さいにもかかわらず性能が急落する「低誤差・高損失」の矛盾を解決するため、損失曲面の幾何学的構造を改善する新フレームワーク「HeRo-Q」が提案されました。

TL;DR(結論)

大規模言語モデル(LLM)の量子化において、重みの誤差が小さいにもかかわらず性能が急落する「低誤差・高損失」の矛盾を解決するため、損失曲面の幾何学的構造を改善する新フレームワーク「HeRo-Q」が提案されました。 この手法は、ヘッセ行列の最大固有値を抑制する「対角平滑化」と、量子化ノイズを全次元に均一化する「学習可能な直交回転」を組み合わせることで、モデルの摂動に対する堅牢性を理論的かつ実践的に向上させています。 LlamaやQwenを用いた検証では、既存のGPTQやSpinQuantを凌駕する精度を達成し、特に極めて困難な3ビット設定(W3A16)においても論理的崩壊を回避しながら高い推論性能を維持することに成功しました。

なぜこの問題か

大規模言語モデル(LLM)を実際のアプリケーションにデプロイする際、ポストトレーニング量子化(PTQ)は計算リソースとメモリ使用量を削減するための極めて重要な技術となっています。しかし、最新の高度なモデルにおいては、従来の量子化手法では説明がつかない「低誤差・高損失」という不可解な現象が頻繁に観察されています。これは、統計的な指標で重みの量子化誤差を最小化したとしても、実際の言語生成や複雑な推論タスクにおける性能が劇的に低下してしまうという深刻な問題です。この現象の根本的な原因を深く探ると、LLMの損失曲面におけるヘッセ行列の幾何学的構造に辿り着きます。具体的には、LLMのヘッセ行列のスペクトルは極めて不均一であり、少数の方向が非常に大きな固有値、すなわち高い曲率を持っている一方で、大部分の方向は固有値がゼロに近い平坦な領域となっています。 このような強い異方性を持つモデルでは、高曲率の方向に沿った微小な摂動が損失を劇的に増大させます。…

核心:何を提案したのか

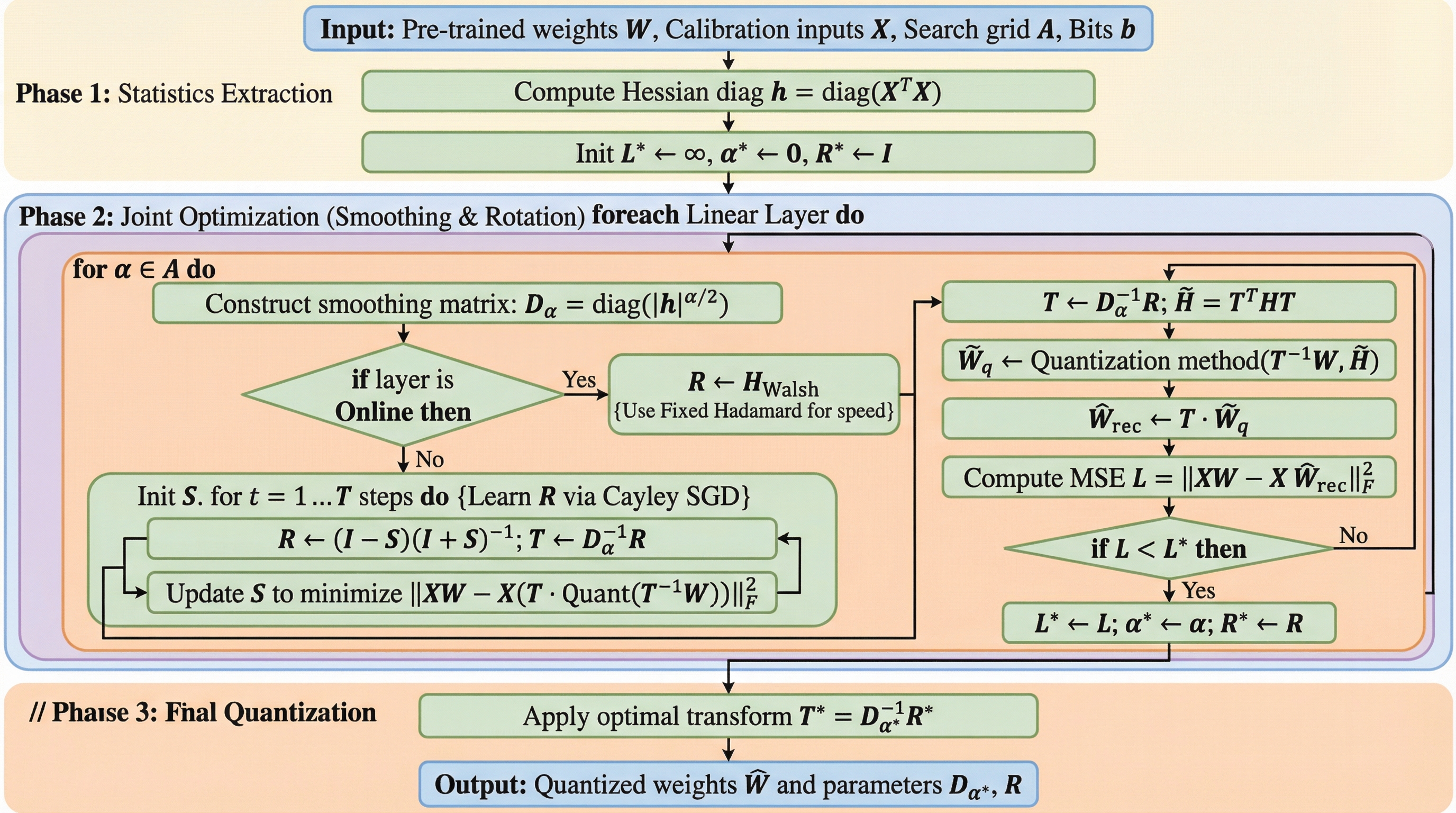

本論文では、量子化の前に損失曲面を能動的に再構成する「Hessian Robust Quantization(HeRo-Q)」アルゴリズムが提案されました。このフレームワークの核心は、量子化誤差そのものを直接最小化しようとする従来のアプローチから脱却し、重み空間に対して相乗的な結合変換を適用することで、ヘッセ行列の条件付けを根本から改善する点にあります。具体的には、スペクトル半径を圧縮して外れ値の曲率を抑える「対角平滑化」と、量子化ノイズを各次元に再分配して敏感な方向との整合を最小限にする「学習可能な直交回転」という2つの幾何学的な操作を組み合わせています。HeRo-Qは、これら2つの役割を分離して最適化することで、モデルの最悪ケースにおける摂動への感度を効果的に低下させます。 このアプローチの大きな利点は、モデルのアーキテクチャや活性化関数を一切変更する必要がないことです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related