HeRo-Q: ヘッセ行列の調整による安定した低ビット量子化のための汎用フレームワーク

大規模言語モデルの量子化において、誤差は小さいのに性能が大幅に低下する「低誤差・高損失」の矛盾を解決するため、損失曲面の幾何学的構造であるヘッセ行列の曲率を調整する新しいフレームワーク「HeRo-Q」が提案されました。

TL;DR(結論)

大規模言語モデルの量子化において、誤差は小さいのに性能が大幅に低下する「低誤差・高損失」の矛盾を解決するため、損失曲面の幾何学的構造であるヘッセ行列の曲率を調整する新しいフレームワーク「HeRo-Q」が提案されました。 この手法は、学習可能な直交回転と対角平滑化を組み合わせた軽量な線形変換を重み空間に適用することで、ヘッセ行列の最大固有値を抑制し、量子化ノイズに対するモデルの感度を物理的に低減させる仕組みを持っています。 LlamaやQwenシリーズを用いた実験では、従来のGPTQやSpinQuantを上回る精度を達成し、特に極めて困難なW3A16設定においても論理的な崩壊を防ぎながら、Llama-3-8Bで70.15%の数学推論精度を維持することに成功しました。

なぜこの問題か

現代のモデル圧縮技術において、事後学習量子化(PTQ)は主要な手法ですが、最新の大規模言語モデル(LLM)に適用すると「低誤差・高損失」という奇妙な現象が発生することが課題となっています。 これは、重みや活性化値の統計的な量子化誤差を最小化しているにもかかわらず、実際のタスク性能が劇的に悪化してしまう現象を指しており、従来の量子化手法の限界を示唆しています。 研究チームはこの問題の根本原因が、LLMの損失曲面におけるヘッセ行列の幾何学的構造、特にその極端な異方性にあることを突き止めました。 ヘッセ行列の固有値分布を分析すると、ごく一部の方向に非常に大きな曲率(最大固有値)が存在し、それ以外の大部分の方向は平坦であるという「ロングテール」分布を持っていることが判明しています。 このような幾何学的構造を持つモデルでは、高曲率の方向に沿った微小な摂動が損失の劇的な増加を招くため、量子化によって注入されるノイズがたとえ全体として小さくても、特定の敏感な方向に成分が含まれるだけで性能が崩壊してしまいます。…

核心:何を提案したのか

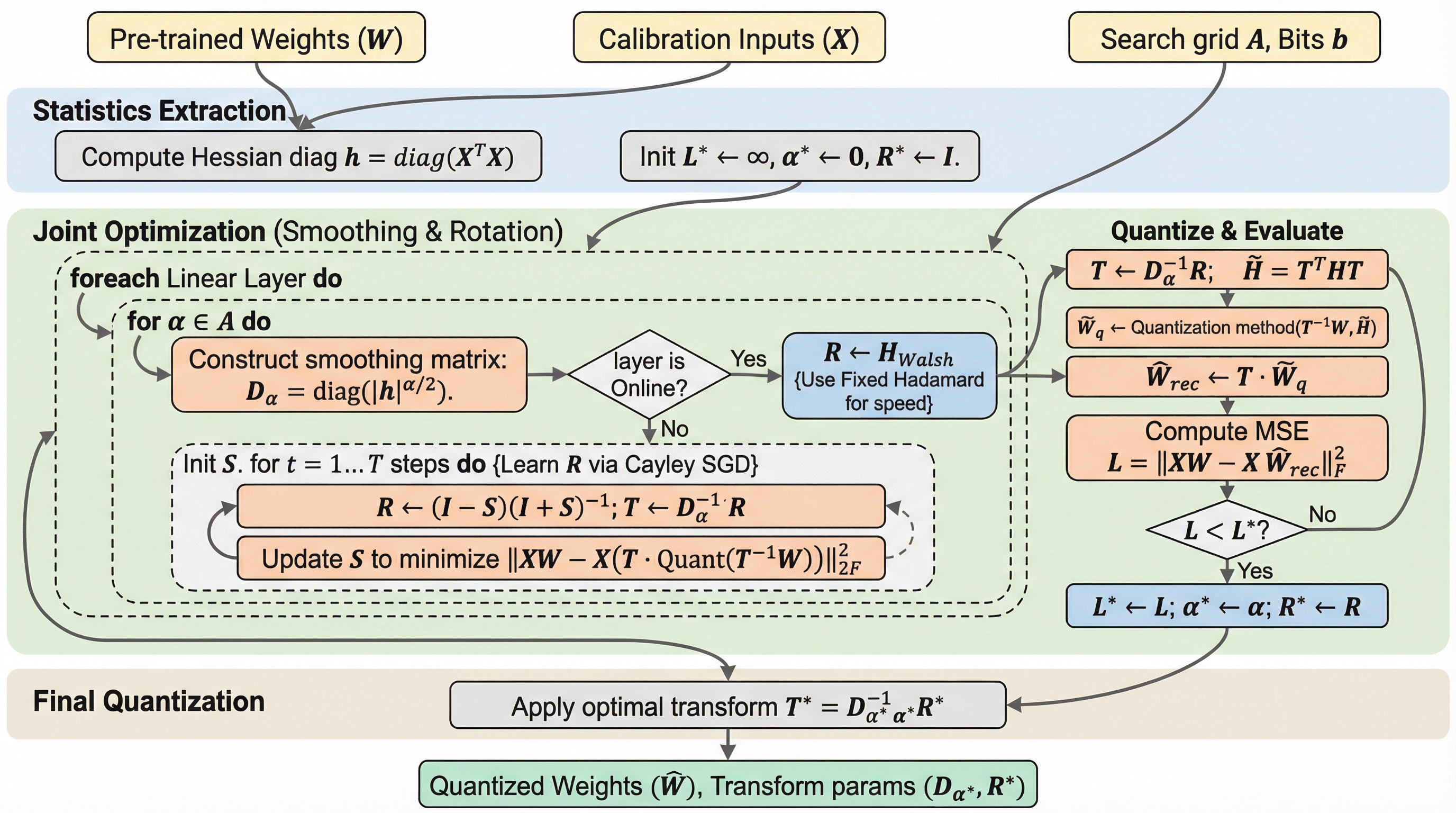

本論文では、量子化の前に損失曲面の幾何学的構造を能動的に再構成する「Hessian Robust Quantization(HeRo-Q)」アルゴリズムが提案されました。 HeRo-Qの核心的なアイデアは、重み空間に対して最適な線形変換を適用することで、ヘッセ行列のスペクトル半径(最大固有値の大きさ)を抑制し、量子化に対するモデルの感度を事前に低減させることにあります。 このフレームワークは、特定のモデルアーキテクチャや活性化関数に依存しない汎用的な設計となっており、既存のPTQパイプラインにシームレスに統合できる点が大きな特徴です。 具体的には、重み行列に対して「対角平滑化(Diagonal Smoothing)」と「学習可能な直交回転(Learnable Orthogonal Rotation)」という2つの相乗的な操作を組み合わせた変換行列を導入しています。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related