GAIA:GUIテスト時スケーリング・クリティックモデルを訓練するためのデータフライホイールシステム

GUIエージェントの操作は一度の誤りが致命的な失敗を招く不可逆性を持つため、実行前にアクションの妥当性を評価する「直感的クリティックモデル(ICM)」と、その精度を継続的に向上させる学習フレームワーク「GAIA」を提案しました。

TL;DR(結論)

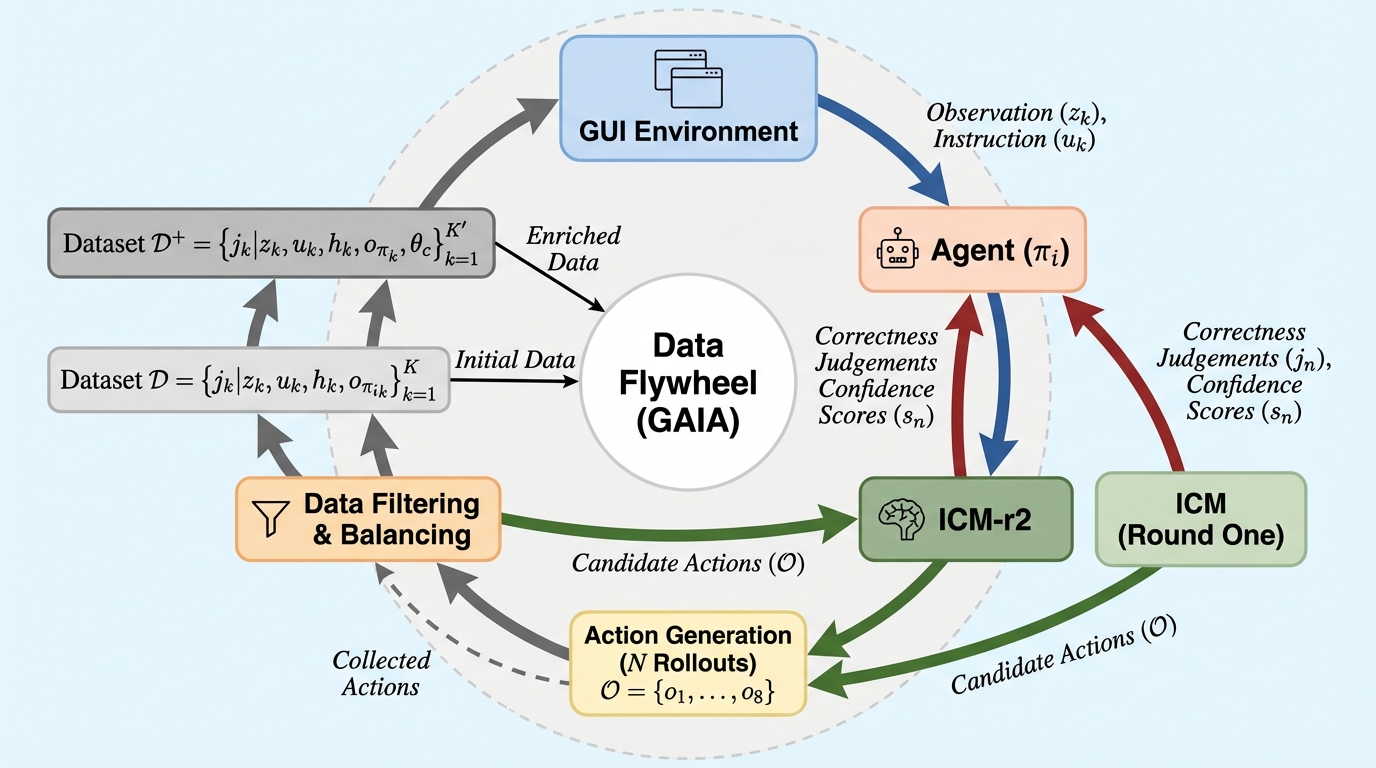

GUIエージェントの操作は一度の誤りが致命的な失敗を招く不可逆性を持つため、実行前にアクションの妥当性を評価する「直感的クリティックモデル(ICM)」と、その精度を継続的に向上させる学習フレームワーク「GAIA」を提案しました。 このシステムは、実際のエージェントの挙動から正解と不正解のデータを収集してモデルを訓練し、さらにそのモデルが選別した困難な事例を再学習に組み込む「データフライホイール」構造によって、推論時の性能を段階的に進化させることが可能です。 検証の結果、GPT-4oやUI-TARSなどの主要なGUIエージェントにおいて、タスクの成功率や操作の正確性が大幅に向上し、特に第2ラウンドの学習を経たモデル(ICM-r2)は、複雑なタスクにおいても極めて高い識別能力を発揮することが確認されました。

なぜこの問題か

現代のデジタルアシスタント開発において、グラフィカル・ユーザ・インターフェース(GUI)の操作自動化は非常に重要な境界線となっています。近年の大規模視覚言語モデル(LVLM)の進歩により、自然言語の指示を解釈し、画面上の視覚要素を認識して多段階のタスクを実行する能力は飛躍的に向上しました。しかし、現実世界のGUIタスクは動的かつ連続的であり、エージェントはいかなるステップにおいても曖昧な、あるいは誤ったアクションを生成するリスクを抱えています。ここで最大の問題となるのが、エージェントによる操作の「不可逆性」です。例えば、一度誤ったボタンをクリックしたり、不適切なテキストを入力して送信したりすると、ワークフロー全体が脱線し、システムが回復不能な状態に陥ることがあります。このような高リスクな環境では、アクションを実行する前にその妥当性を検証するメカニズムが不可欠です。 これまでの研究でも、GUIエージェントのためのアクション検証器が設計されてきましたが、主に2つの限界がありました。第一に、検証器の訓練に必要な「負のサンプル(誤った操作)」の定義が、ランダムな位置のクリックなど、ヒューリスティックな手法に依存していた点です。…

核心:何を提案したのか

本研究では、GUIアクション・クリティックのためのデータフライホイールシステム「GAIA」を提案しました。このシステムの中核となるのは、エージェントが提案したアクションの即時的な正誤を評価する「直感的クリティックモデル(ICM)」です。GAIAは、初期段階の訓練(フェーズ1)と、その後の反復的な改善(フェーズ2)という2つの主要なフェーズで構成されています。この二段階のアプローチにより、モデルは単なる静的な知識の習得を超えて、実際のエージェントが直面する困難な状況に適応する能力を獲得します。 フェーズ1では、既存のGUIエージェントを実際のデータセット上で動作させ、その過程で生成された正解アクションと不正解アクションを収集します。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related