FedKRSO:共有ランダム部分空間で通信量とメモリを抑えつつ全パラメータ微調整に迫る連合学習

共有ランダム部分空間で更新を表現し、連合学習でのLLM全パラメータ微調整を通信・メモリの両面から軽くする提案です。PEFTより高性能で、FFTに近い精度を狙える点が核心です。

TL;DR(結論)

- 連合学習で大規模言語モデルを本格的に微調整しようとすると、全パラメータ微調整は重すぎ、LoRA系は軽い代わりに性能を落としやすいという板挟みがありました。

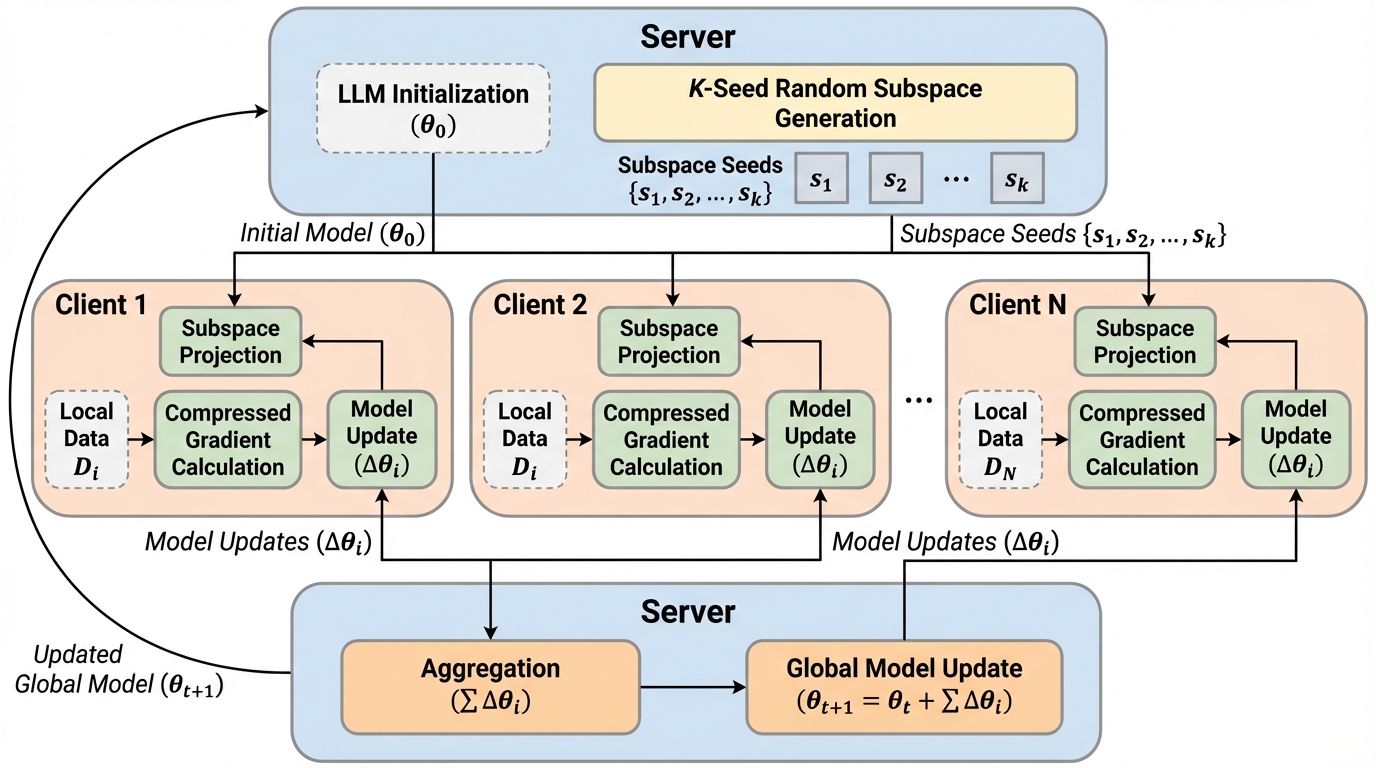

- FedKRSOは、サーバーが配る共有ランダム部分空間の中だけで各クライアントが更新し、その部分空間上の更新量だけを送ることで、通信量とメモリ消費を大きく削りながら全パラメータ微調整にかなり近い性能を狙います。

- 実験ではGLUE系タスクを含む複数の連合学習条件で、PEFTより強く、全パラメータ微調整に近い精度を示しており、エッジ側での実用的な連合LLM微調整に一歩踏み込んだ提案になっています。

なぜこの問題か

大規模言語モデルを実運用に合わせて調整するには、最終的にはそれなりに強いファインチューニングが必要になります。ところが、実データは単一の安全な場所に集められるとは限りません。医療、企業内文書、個人端末、IoT機器のように、データをローカルに保持したまま学習したい場面では、連合学習が現実的な選択肢になります。

核心:何を提案したのか

FedKRSOの中心は、モデル更新をフルのパラメータ空間で自由に動かすのではなく、サーバーが生成した複数のランダム低次元部分空間の中に制限して行う点にあります。各クライアントは、その共有部分空間の上で更新を進めます。つまり、見かけ上は全パラメータ微調整を目指しつつ、実際の最適化はずっと小さい表現の中で回す、という構造です。

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related