Fair Recourse for All: 反実仮想説明における個人および集団の公平性の確保

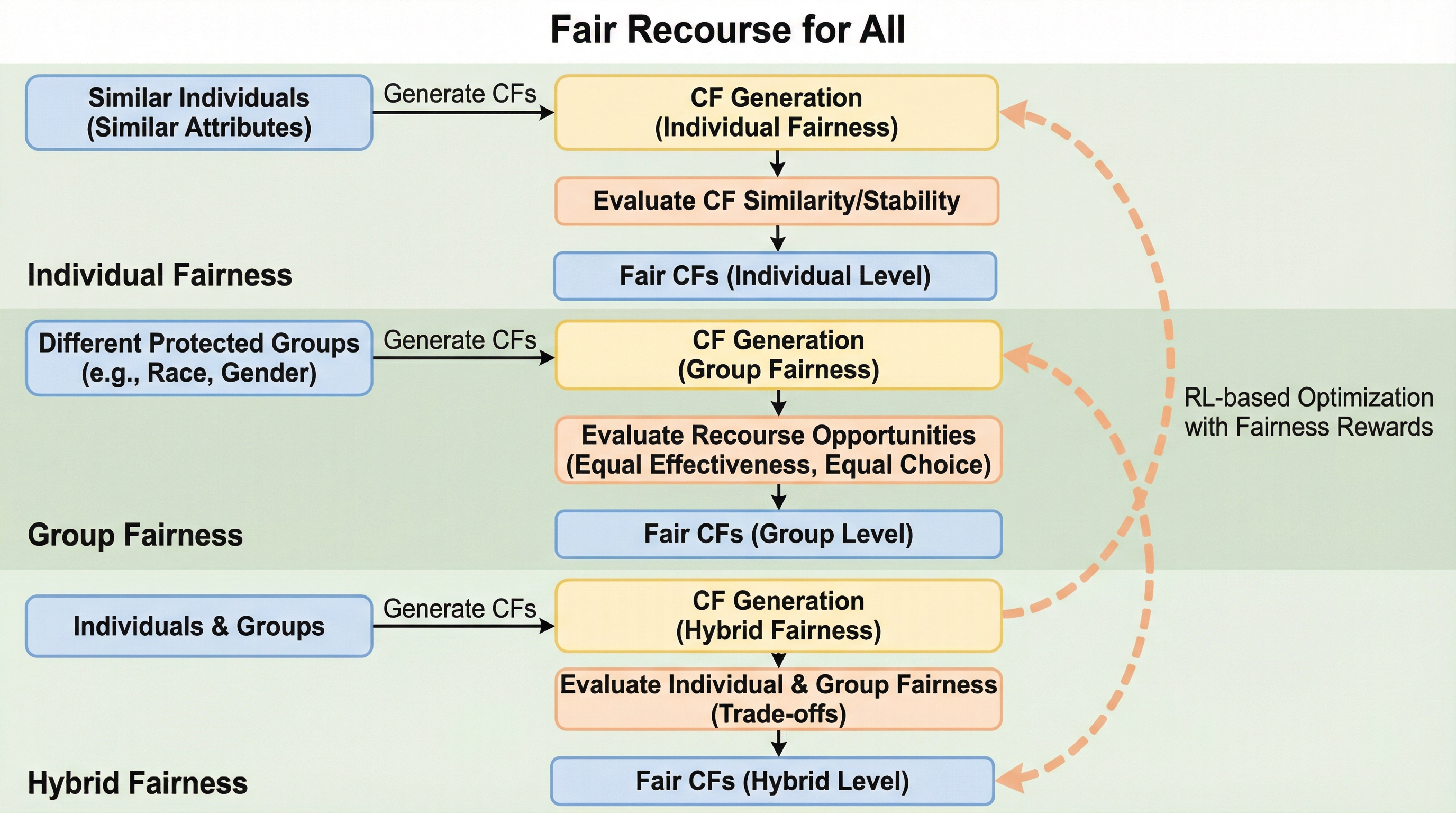

機械学習の意思決定を説明する反実仮想説明(CF)において、似た属性の個人に同様の改善策を出す「個人の公平性」と、保護属性グループ間で機会を均等にする「集団の公平性」を両立する「ハイブリッド公平性」を定義した。

TL;DR(結論)

機械学習の意思決定を説明する反実仮想説明(CF)において、似た属性の個人に同様の改善策を出す「個人の公平性」と、保護属性グループ間で機会を均等にする「集団の公平性」を両立する「ハイブリッド公平性」を定義した。 この課題を解決するため、強化学習を用いたモデルに依存しないフレームワークを提案し、報酬関数に「機会の平等な有効性(EE)」や「改善策の平等な選択肢(ECR)」といった指標を組み込むことで、公平性と説明の質の双方を最適化した。 3つのベンチマークデータセットを用いた検証により、提案手法は個人・集団・ハイブリッドの全レベルで公平性を効果的に確保しつつ、実用的な改善策を提示できることを示し、公平性を追求する際に生じる説明の質の低下を定量的に明らかにした。

なぜこの問題か

機械学習(ML)は、ヘルスケア、金融、輸送、刑事司法といった、人々の人生に大きな影響を与える高リスクな意思決定分野で広く採用されている。しかし、これらのモデルは内部の仕組みが不透明な「ブラックボックス」として認識されることが多く、なぜ特定の結論に至ったのかを人間が理解することは極めて困難である。この不透明性は、システムに対する信頼を損なうだけでなく、モデルの推論プロセスを検証したり、潜在的なバイアスを特定したりすることを妨げる大きな要因となっている。透明性を高めるための手法として、説明可能なAI(XAI)技術が注目されており、その中でも「反実仮想説明(CF)」は、ユーザーに対して具体的な行動指針(リコース)を示すことができるため、非常に重要な役割を担っている。 しかし、CFの生成プロセスそのものが不公平を助長する可能性があるという深刻な問題が指摘されている。例えば、金融プロファイルが似ている2人の個人がともにローンを拒否された際、一方には「給与を増やすこと」を提案し、もう一方には「連帯保証人を立てること」を提案するといった不一致が生じることがある。…

核心:何を提案したのか

本研究の核心は、反実仮想説明における「ハイブリッド公平性」という新しい概念を定義し、それを実現するための強化学習(RL)ベースのモデルに依存しない最適化フレームワークを提案したことにある。ハイブリッド公平性とは、個人のニーズに応じた適切な改善策を提示しつつ、グループ間の格差も同時に解消することを目指す概念である。本研究では、公平性を「個人の公平性」、「集団の公平性」、「ハイブリッド公平性」の3つのレベルで定式化し、これらを統一的に扱う枠組みを構築した。個人の公平性は「類似した個人には類似した説明を」という原則に基づき、集団の公平性は「保護属性に関わらず平等な機会を」という原則に基づいている。 次に、これらの公平性制約を最適化問題として定式化した。具体的には、強化学習のエージェントが、公平性の指標を報酬として受け取りながら、最適なCFを探索する仕組みを構築した。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related