表形式データ生成のための変分オートエンコーダにおけるTransformerの配置に関する探究

本研究では、表形式データの生成において変分オートエンコーダ(VAE)のどの構成要素にTransformerを配置すべきかを、57種類の多様なデータセットを用いて網羅的に調査しました。実験の結果、Transformerを潜在空間やデコーダに配置することで生成データの多様性は向上するものの、元のデータに対する忠実度が低下するという明確なトレードオフの関係が存在することが判明しました。また、デコーダに配置されたTransformerは層正規化の影響により実質的に線形な挙動を示しており、複雑な特徴間相互作用の学習には限定的な寄与しかしていない可能性が示唆されています。

TL;DR(結論)

本研究では、表形式データの生成において変分オートエンコーダ(VAE)のどの構成要素にTransformerを配置すべきかを、57種類の多様なデータセットを用いて網羅的に調査しました。実験の結果、Transformerを潜在空間やデコーダに配置することで生成データの多様性は向上するものの、元のデータに対する忠実度が低下するという明確なトレードオフの関係が存在することが判明しました。また、デコーダに配置されたTransformerは層正規化の影響により実質的に線形な挙動を示しており、複雑な特徴間相互作用の学習には限定的な寄与しかしていない可能性が示唆されています。

なぜこの問題か

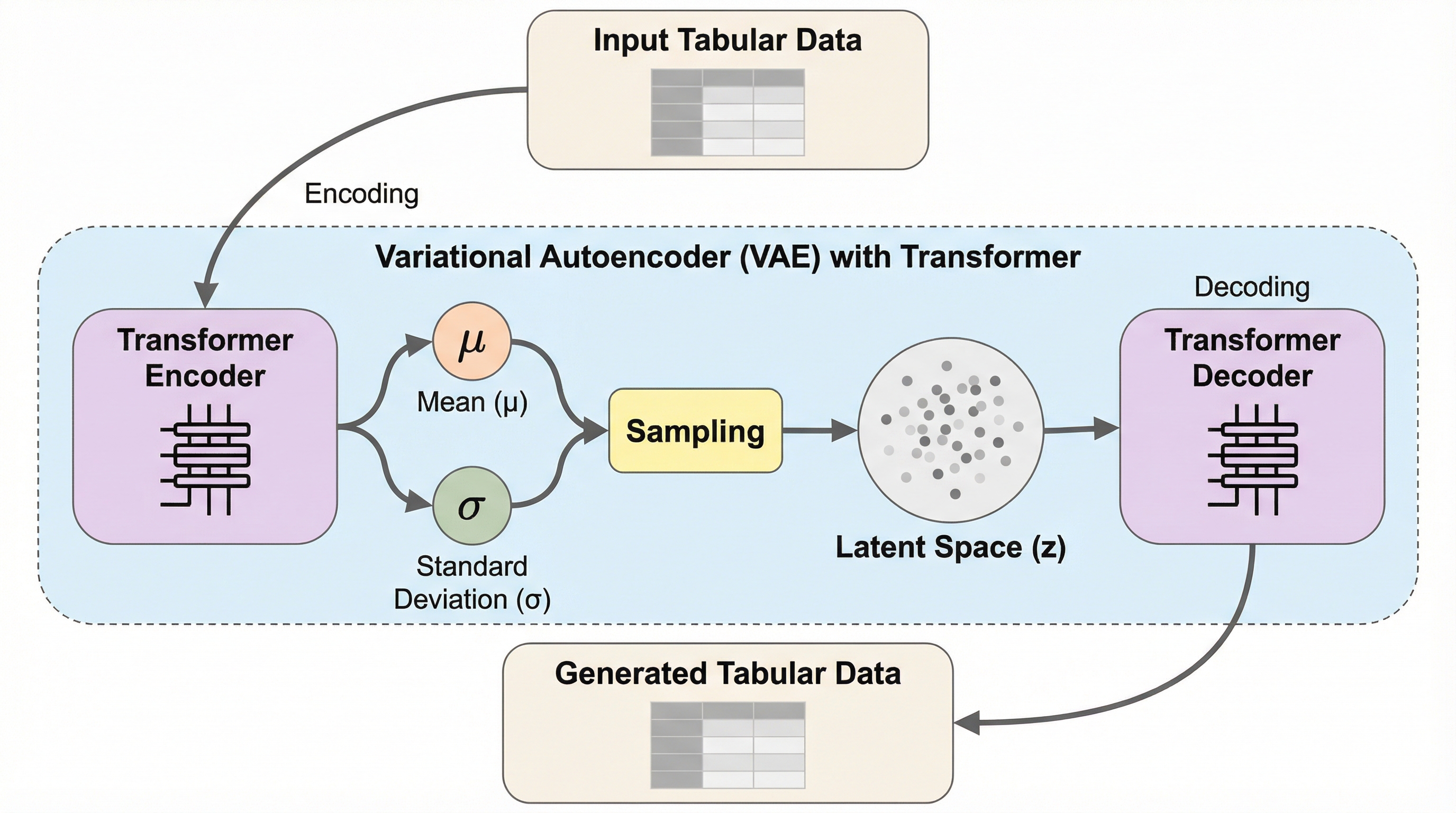

表形式データの生成は、画像やテキストといった他のデータ形式と比較して、依然として機械学習における大きな課題となっています。表形式データは数値型とカテゴリ型が混在するヘテロジニアスな構造を持っており、それぞれの変数が独自の分布や相関関係を持っているためです。従来の変分オートエンコーダ(VAE)では、多層パーセプトロン(MLP)を用いたアーキテクチャが一般的ですが、これでは特徴量間の高次な依存関係を十分に捉えることが難しいという問題がありました。特に、連続変数が複数のモードを持っていたり、カテゴリ変数が膨大な種類を持っていたりする場合、ニューラルネットワークがそれらの関係性を適切に学習することは困難です。 一方で、アテンション機構を備えたTransformerは、特徴量間の複雑な相互作用を捉える能力に長けており、画像や自然言語処理の分野で目覚ましい成果を上げてきました。近年では表形式データの領域でもTransformerの導入が進んでいますが、VAEのどの部分にTransformerを組み込むのが最も効果的なのかについては、これまで詳細な検証が行われてきませんでした。…

核心:何を提案したのか

本研究の核心は、VAEの主要な構成要素であるエンコーダ、潜在空間、デコーダのそれぞれにTransformerを配置した際の挙動を系統的に比較・評価した点にあります。具体的には、Transformerを全く使用しない標準的なVAEをベースラインとし、エンコーダのみに配置したモデル(E-VAE)、エンコーダと潜在空間に配置したモデル(EL-VAE)、全ての箇所に配置したモデル(ELD-VAE)、潜在空間とデコーダに配置したモデル(LD-VAE)、そしてデコーダのみに配置したモデル(D-VAE)の計6種類のバリエーションを提案し、その性能を検証しました。 これらのモデルでは、混合型のデータを扱うために「トークナイザ」と呼ばれる仕組みを導入しています。これは、各特徴量を連続的なベクトル空間に投影することで、数値データとカテゴリデータを統一的な形式でTransformerが処理できるようにするものです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related