EVE: 近似アンラーニングにおけるカスタマイズされた摂動を用いたデータ消去の効率的な検証

1. 機械学習モデルから特定のデータを削除する「アンラーニング」が正しく実行されたかを検証するため、モデルの初期学習フェーズへの関与を一切必要とせず、アンラーニングの実行段階のみで効率的に動作する新しい検証手法「EVE」を提案する。 2.

TL;DR(結論)

- 機械学習モデルから特定のデータを削除する「アンラーニング」が正しく実行されたかを検証するため、モデルの初期学習フェーズへの関与を一切必要とせず、アンラーニングの実行段階のみで効率的に動作する新しい検証手法「EVE」を提案する。

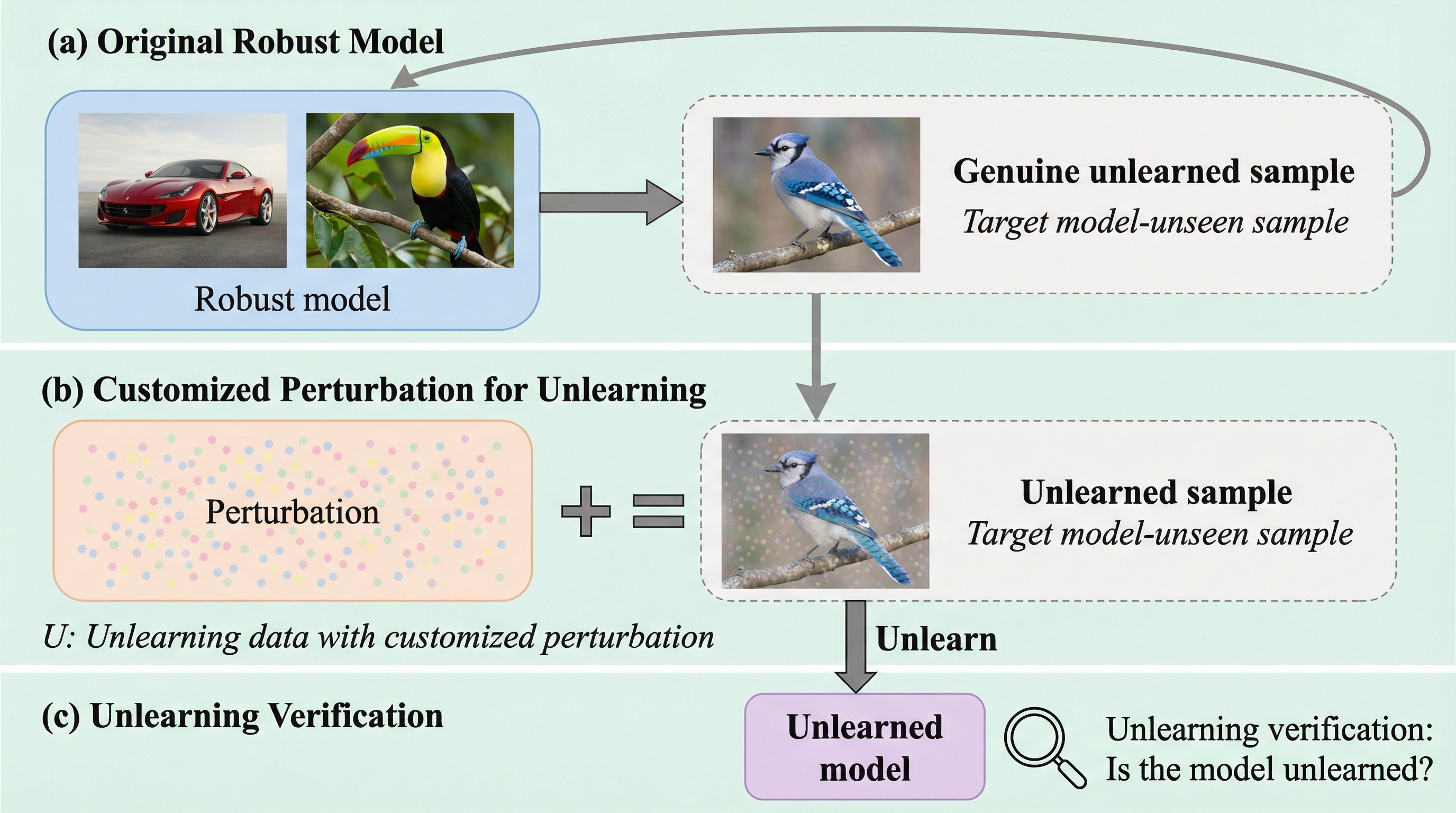

- 削除対象のデータに対して、モデルの決定境界を意図的に移動させるカスタマイズされた摂動を加えることで、アンラーニング後のモデルが特定のターゲットサンプルを誤分類するように誘導し、その予測の変化を統計的仮説検定と組み合わせて信頼性の高い検証信号として活用する。

- 勾配マッチングを用いたアドバーサリアル最適化により、アンラーニングの効果とモデルの本来の性能を維持しながら、従来のバックドア型手法を大幅に上回る計算効率と実用的な検証精度を両立させ、サーバーによる削除の偽装を効果的に検知することを可能にした。

なぜこの問題か

現代社会において個人データのプライバシー保護に対する意識は世界的に高まっており、欧州のGDPR(一般データ保護規則)などの法的な枠組みが整備されたことで、個人が機械学習システムから自分のデータを削除するよう求める「忘れられる権利」が確立された。これを受けて、学習済みモデルから特定のユーザーデータの影響を効率的に取り除く「機械アンラーニング」の技術が急速に発展している。しかし、既存の研究の多くはアンラーニングのアルゴリズムそのものの開発に集中しており、サーバーがユーザーの要求通りにデータを適切に削除したかどうかを客観的に確認するための「検証」プロセスについては、十分に探索されていないのが現状である。ユーザーはサーバーが実際にアンラーニングを行ったかどうかを知る手段が乏しく、信頼性の欠如が課題となっている。 既存の検証手法の多くはバックドア技術を応用しているが、これらには実用上の大きな課題が存在する。バックドアベースの手法は、モデルの初期学習フェーズから参加して特定のデータを埋め込んでおく必要があるため、非常に非効率的である。…

核心:何を提案したのか

本論文では、モデルの初期学習プロセスへの関与を一切必要とせず、アンラーニングの実行時のみでデータ消去を検証できる手法「EVE(Efficient Verification of Erasure)」を提案している。この手法の核心的なアイデアは、ユーザーがアンラーニングを依頼するデータに対して、カスタマイズされた「摂動」を加えることにある。この摂動は、アンラーニングが実行された後に、モデルの決定境界を意図的に移動させ、特定のターゲットサンプルに対する予測を変化させるように設計されている。具体的には、元のモデルでは正しく分類されていたターゲットサンプルが、アンラーニング後には特定の誤ったクラスへと分類されるように仕向ける。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related