内発的リプロンプティング:統合マルチモーダルモデルのための自己進化型認知アライメント

統合マルチモーダルモデル(UMM)において、高度な理解能力が生成能力に反映されない「認知の溝」を解消するため、モデル内部で自己完結的にプロンプトを再構成する「内発的リプロンプティング」が提案されました。

TL;DR(結論)

統合マルチモーダルモデル(UMM)において、高度な理解能力が生成能力に反映されない「認知の溝」を解消するため、モデル内部で自己完結的にプロンプトを再構成する「内発的リプロンプティング」が提案されました。 この手法を実現する学習フレームワーク「SEER」は、わずか300サンプルのデータを用い、検証可能な報酬による強化学習(RLVR)とモデル報酬型思考による強化学習(RLMT)の二段階ループを通じて、モデルの潜在的な評価・推論能力を活性化させます。 実験の結果、SEERは既存の外部モデルを用いた手法と比較して、生成の忠実度や指示への準拠性において優れた性能を示し、モデル自身の生成特性に最適化された「モデル固有のアライメント」を実現できることが確認されました。

なぜこの問題か

近年の統合マルチモーダルモデル(UMM)は、単一のネットワーク内で画像理解と画像生成の両方を統合することに成功していますが、そこには深刻な能力の不均衡が存在しています。モデルは入力された視覚的な指示を正確に理解できているにもかかわらず、その理解を自身の生成プロセスを導くための具体的な指示へと変換することができず、結果として生成される画像の品質や指示への準拠性が低下するという問題です。研究チームはこの現象を「認知の溝(Cognitive Gap)」と定義しました。これは、モデルが「自身の生成プロセスをどのように強化すべきか」という具体的な知識を欠いている状態を指します。 従来のアプローチでは、DALL-E 3のように外部の大型言語モデル(LLM)を使用してプロンプトを書き直す手法が一般的でした。しかし、この方法には「表現のミスマッチ」という根本的な課題があります。外部のLLMは生成モデルがどのような内部表現や優先順位(生成バイアス)を持っているかを知りません。そのため、外部モデルが生成した詳細な記述が、必ずしも生成モデルにとって最適な入力になるとは限らないのです。…

核心:何を提案したのか

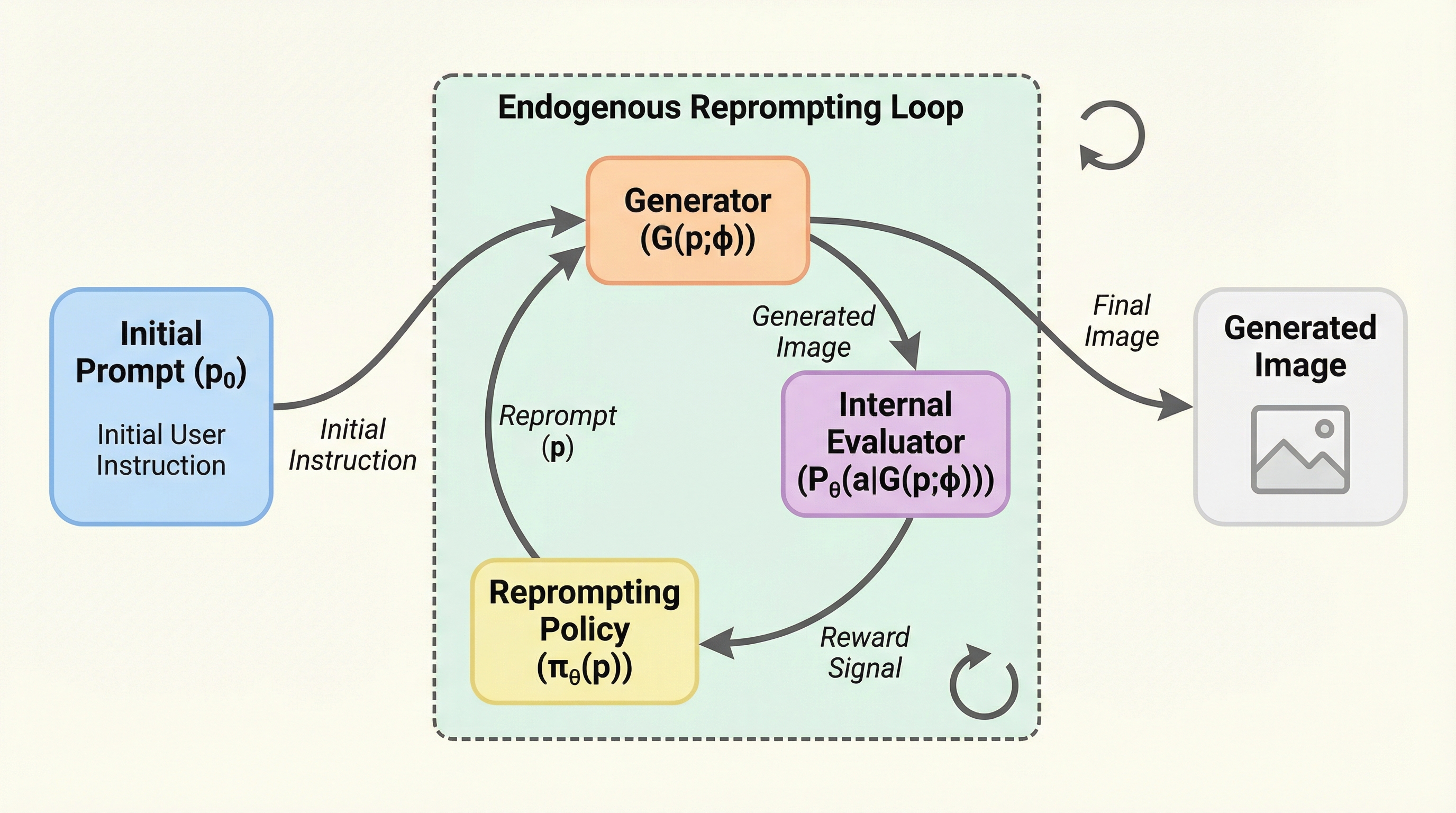

本研究では、モデルの理解能力をパッシブな符号化プロセスから、明示的な生成推論ステップへと変換する「内発的リプロンプティング(Endogenous Reprompting)」を提案しました。これは、モデルがユーザーの意図を自身の生成特性(生成プライア)に合致した具体的な記述子へと翻訳する仕組みです。このプロセスはモデルの共有表現空間内で行われるため、理解と生成の間で知識をシームレスに転送することが可能となり、外部モデルに依存しない「モデル固有のアライメント」を実現します。 この内発的リプロンプティングを実現するために開発されたのが、自己進化型のエバリュエーター兼リプロンプターである「SEER(Self-Evolving Evaluator and Reprompter)」という学習フレームワークです。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related