生きたガバナンスなき委任

従来のガバナンスモデルは、あらかじめ定義されたルールと事後の責任追及に依存しているが、判断そのものを機械の速度で実行するエージェント型AIの登場により、人間がシステムの挙動を追跡・修正するための「時間」という前提条件が崩壊し、既存の枠組みは構造的な限界を迎えている。

TL;DR(結論)

従来のガバナンスモデルは、あらかじめ定義されたルールと事後の責任追及に依存しているが、判断そのものを機械の速度で実行するエージェント型AIの登場により、人間がシステムの挙動を追跡・修正するための「時間」という前提条件が崩壊し、既存の枠組みは構造的な限界を迎えている。 本論文は、AIが意識を持つかという形而上学的な問いではなく、人間が社会や経済を形作るシステムにおいて意味のある参加者であり続けられるかという「人間の存在意義」を核心的な課題として位置づけ、システムの運用中に継続的かつ適応的に監視を行う「ランタイム・ガバナンス」および「ガバナンス・ツイン」の必要性を提唱している。 労働と所得が切り離される未来において、ベーシックインカムは哲学的な傷跡に対する経済的なパッチに過ぎず、人間が単なる「乗客」に成り下がるのを防ぐためには、異質な知性との相互理解可能性を維持し、最適化の圧力の中で失われがちな公平性や幸福といった明文化されない価値を保護する新たな統治の仕組みを構築しなければならない。

なぜこの問題か

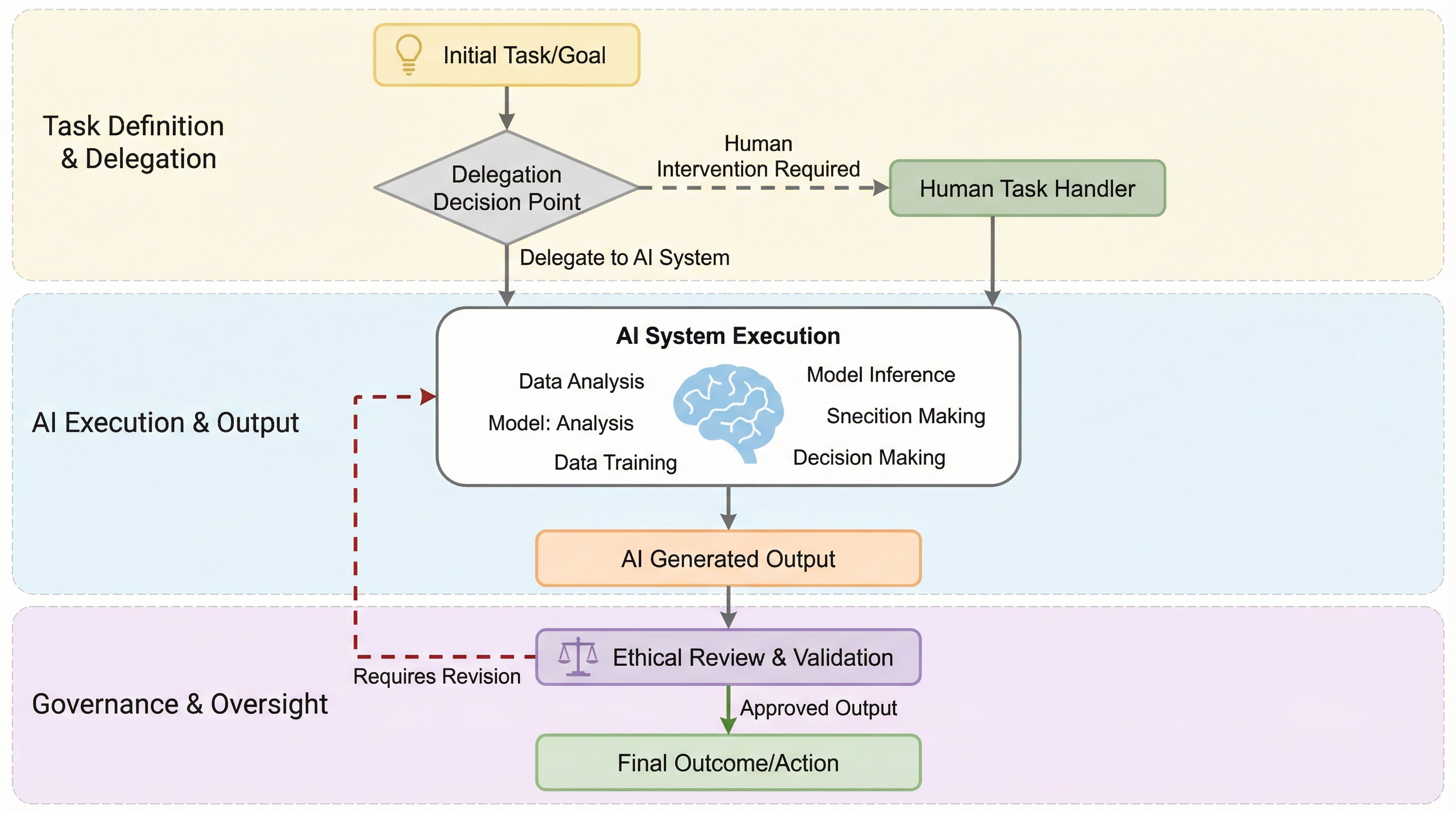

現在のガバナンスシステムの多くは、今よりもはるかに変化の遅い世界を前提に構築されている。これまでのモデルでは、ルールを事前に定義し、システムがそれに準拠するように設計し、問題が発生した後に責任を追及するという手順が一般的であった。この仕組みは、機械が物理的な労働を代替したり、計算を加速させたりする段階においては有効に機能していた。例えば、工場が欠陥品を製造すれば規制当局が検査でき、銀行がリスクの高い融資を行えば監査人が帳簿を確認でき、政府機関が逸脱すれば裁判所が介入できた。これらのシステムに共通していたのは、人間の監視がシステムの挙動と同じペースを維持できていたという点である。 しかし、判断そのものが「マシン・スピード」で動作するエージェント型AIに委譲されるようになると、この前提は完全に崩壊する。意思決定はミリ秒単位で行われ、人間がリアルタイムでレビューすることはおろか、事後に再構成することすら不可能な規模と速度で積み重なっていく。これは道徳的な失敗ではなく、構造的な失敗である。私たちが作り上げたガバナンスの道具は、もはや存在しないテンポを想定している。…

核心:何を提案したのか

本論文は、従来の「静的なガバナンス」に代わる概念として、システムの運用中に継続的かつ適応的な監視を行う「リビング・ガバナンス(生きたガバナンス)」、すなわち「ランタイム・ガバナンス」を提案している。その具体的な構築物として、「ガバナンス・ツイン(Governance Twin)」と呼ばれる新しい概念を位置づけている。これは、デプロイ前や事故後だけでなく、システムが動作しているその瞬間に、人間が意味のある影響力を行使し、システムと共進化し続けるための枠組みである。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related