補助損失による分離型分割学習

従来の分割学習(Split Learning)が抱えていた、サーバーからの勾配返送待ちによる通信遅延と、バックプロパゲーションのための膨大なメモリ消費という二大課題を、分割点に軽量な補助分類器を導入して学習プロセスを「分離」することで根本から解決しました。

TL;DR(結論)

従来の分割学習(Split Learning)が抱えていた、サーバーからの勾配返送待ちによる通信遅延と、バックプロパゲーションのための膨大なメモリ消費という二大課題を、分割点に軽量な補助分類器を導入して学習プロセスを「分離」することで根本から解決しました。 提案手法である「分離型分割学習(DSL)」は、クライアント側で局所的な補助損失を生成して自己完結的に更新を行うため、サーバーからの勾配送信を完全に排除し、通信量を約50%削減するとともに、ピーク時のメモリ使用量を最大58%削減することに成功しました。 CIFAR-10およびCIFAR-100を用いたResNet-110の実験において、従来のバックプロパゲーションを用いる手法と同等のテスト精度を維持できることが確認され、リソースが極めて制限されたエッジデバイスにおける効率的な分散学習の実現可能性を証明しました。

なぜこの問題か

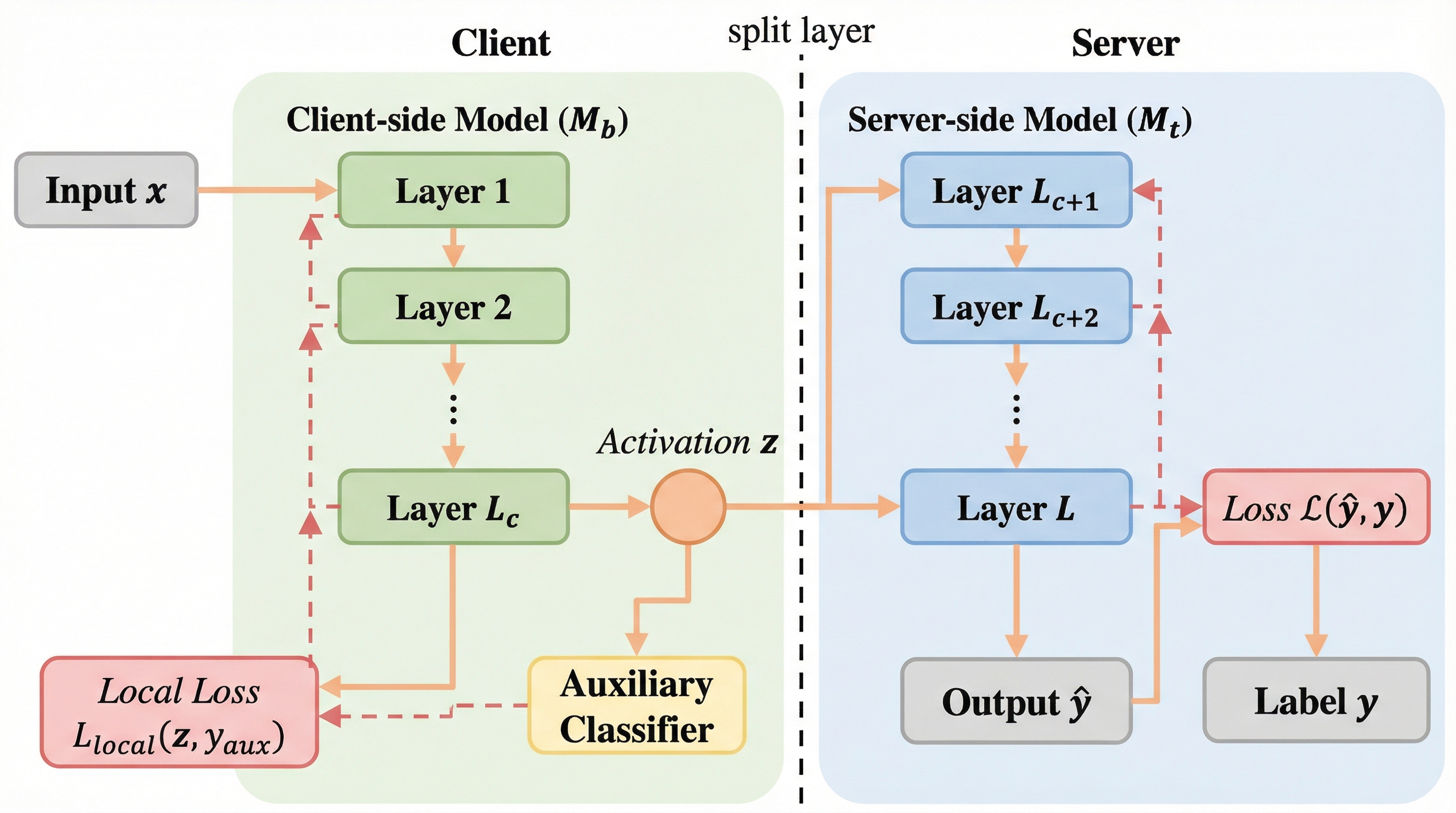

分散機械学習の重要な手法である分割学習(Split Learning)は、ニューラルネットワークをクライアント側とサーバー側の二つに分割し、生のデータを共有せずに中間層の出力(アクティベーション)のみをやり取りすることでプライバシーを保護する仕組みです。しかし、この従来のアプローチには、実用化を阻む深刻なボトルネックが二つ存在していました。第一の課題は、通信オーバーヘッドの大きさです。従来の分割学習は、ネットワーク全体を通じたエンドツーエンドのバックプロパゲーションに依存しているため、毎回の学習ステップにおいて、順伝播でアクティベーションをサーバーへ送り、逆伝播で勾配をクライアントへ送り返すという双方向の通信が不可欠でした。特にモデルが大規模化したり、分割点の次元が高くなったりすると、この勾配の転送コストがネットワーク帯域を激しく圧迫し、学習全体の遅延を招く原因となります。 第二の課題は、クライアントデバイスにおけるメモリ消費の問題です。バックプロパゲーションを実行するためには、逆伝播の計算が完了するまで、順伝播時に計算した中間層のアクティベーションをメモリ上に保持し続けなければなりません。…

核心:何を提案したのか

本論文が提案する核心的な解決策は、クライアントとサーバーの学習プロセスを完全に切り離す「分離型分割学習(Decoupled Split Learning, DSL)」の開発です。この手法の最大の特徴は、ニューラルネットワークの分割点(カットレイヤー)の直後に、非常に軽量な「補助分類器(Auxiliary Classifier)」を導入した点にあります。この補助分類器は、クライアント側で局所的な損失信号(補助損失)を生成する役割を果たします。これにより、クライアントはサーバーからの勾配が届くのを待つ必要がなくなり、自身のモデルパラメータを即座に更新できる「自己完結的な学習」が可能になりました。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related