思考の連鎖(CoT)圧縮の理論的解析:ALiCoTによる効率的な推論の実現

大規模言語モデルの思考の連鎖(CoT)は高度な推論を可能にする一方で、膨大なトークン生成による計算コストと遅延が課題となっており、推論過程を潜在状態に隠蔽する「暗黙的CoT」は複雑な論理タスクで性能が崩壊するという問題を抱えていました。

TL;DR(結論)

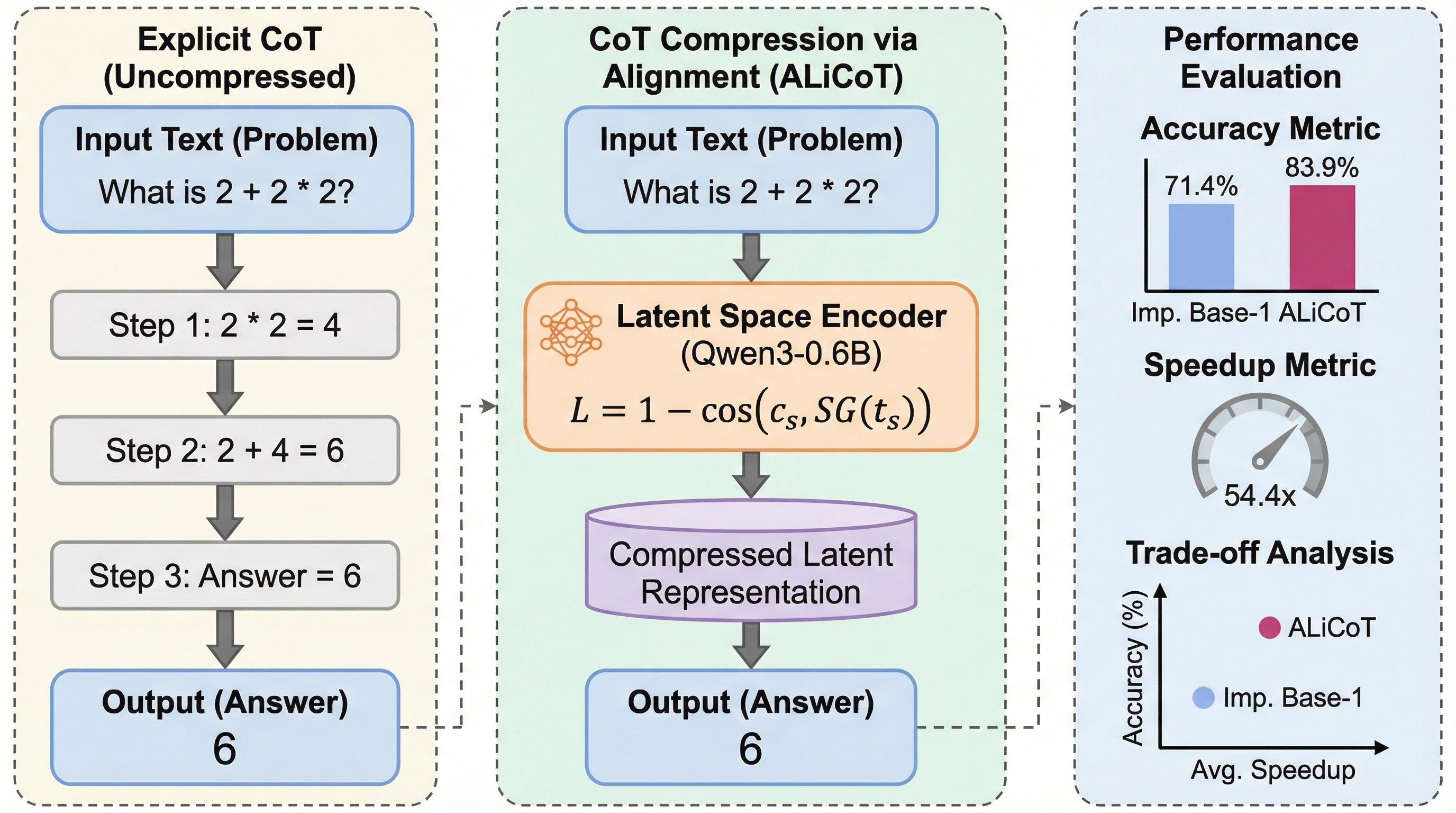

大規模言語モデルの思考の連鎖(CoT)は高度な推論を可能にする一方で、膨大なトークン生成による計算コストと遅延が課題となっており、推論過程を潜在状態に隠蔽する「暗黙的CoT」は複雑な論理タスクで性能が崩壊するという問題を抱えていました。 本研究は、論理的依存関係を「Order-$r$ Interaction」として定式化し、中間ステップの省略が学習信号の指数関数的な減衰とデータ要求量の爆発を招くことを理論的に証明するとともに、意味的な近道を排除して厳密な論理検証を行うための新ベンチマーク「NatBool-DAG」を導入しました。 この理論に基づき、潜在トークンの分布を明示的な推論状態の意味論と整合させる新フレームワーク「ALiCoT」を提案し、従来の明示的CoTと同等の推論精度を維持したまま、トークン消費を大幅に削減することで推論速度を54.4倍に向上させることに成功しました。

なぜこの問題か

大規模言語モデル(LLM)は、中間的な思考ステップを逐次的に生成する「思考の連鎖(CoT)」という手法によって、数学的推論や常識的な判断において飛躍的な能力向上を遂げてきました。特に最新の推論特化型モデルは、人間のような深い思考プロセスを模倣することで複雑な課題を解決していますが、この能力には極めて高い代償が伴います。推論が詳細になればなるほど生成されるトークン数は増大し、それに比例して計算リソースの消費と応答の遅延(レイテンシ)が深刻化します。このリソース消費の激しさは、リアルタイム性が求められる対話システムや、計算資源が限られた環境でのモデル展開において、実用上の大きな障壁となっています。 この課題を解決するために、推論ステップをテキストとして出力せずにモデル内部の潜在的な隠れ状態として処理する「暗黙的CoT」の研究が進められてきました。暗黙的CoTは、トークン生成を省略できるため理論上は極めて高い効率性を持ちますが、これまでの研究では、なぜ特定のタスクで有効でありながら、数学的な多段階推論のような厳密な論理を必要とするタスクで急激に性能が低下するのかというメカニズムが解明されていませんでした。…

核心:何を提案したのか

本研究の最大の貢献は、暗黙的CoTの学習における困難さを「Order-$r$ Interaction($r$次の相互作用)」という概念を用いて理論的に定式化したことです。これは、あるターゲット変数が、入力変数のうち何個の結合された依存関係によって決定されるかを測定する指標です。例えば、単純な事実の関連付けは低次の相互作用で済みますが、複雑な数学の証明やパリティ問題のように、複数の要素が組み合わさって初めて意味を成す問題は高次の相互作用を必要とします。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related