思考の連鎖の圧縮:理論的分析

大規模言語モデルの思考プロセスを潜在状態に圧縮する「隠れ思考連鎖(Implicit CoT)」において、推論ステップの省略が学習信号の指数関数的な減衰を引き起こし、複雑な論理問題の解決を困難にすることを理論的に解明しました。

TL;DR(結論)

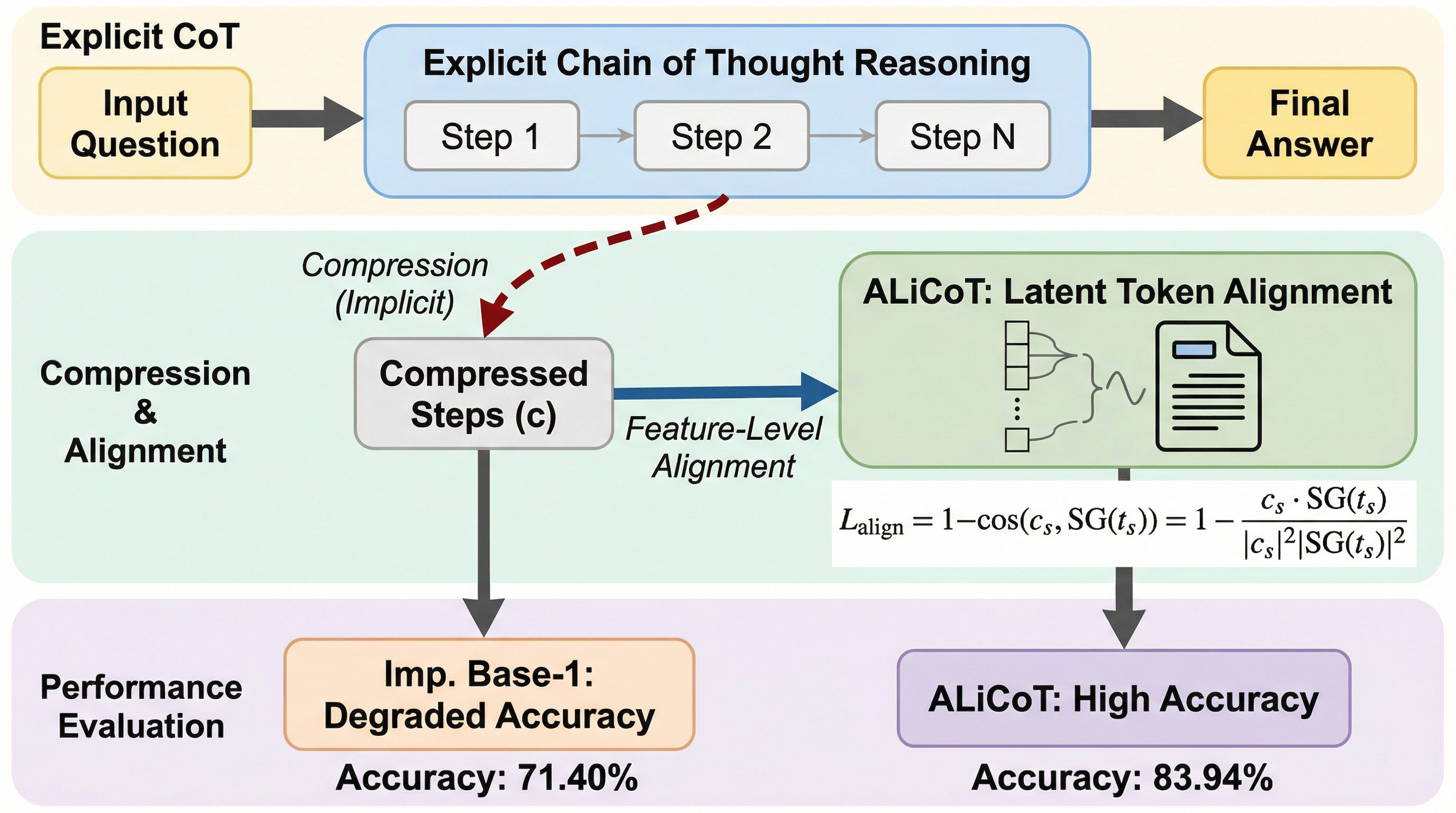

大規模言語モデルの思考プロセスを潜在状態に圧縮する「隠れ思考連鎖(Implicit CoT)」において、推論ステップの省略が学習信号の指数関数的な減衰を引き起こし、複雑な論理問題の解決を困難にすることを理論的に解明しました。この課題を解決するため、論理的依存関係を厳密に評価する新ベンチマーク「NatBool-DAG」を導入し、潜在トークンの分布を明示的な推論状態に整合させる新フレームワーク「ALiCoT」を提案することで、学習の安定性を大幅に向上させました。検証の結果、ALiCoTは従来の明示的な思考連鎖と同等の推論性能を維持しながら、推論速度を最大で54.4倍に高速化することに成功し、効率的かつ高精度な推論モデルの実現に向けた理論的・実践的な基盤を構築しました。

なぜこの問題か

近年、大規模言語モデル(LLM)は、中間的な推論ステップを生成する思考連鎖(Chain-of-Thought, CoT)を用いることで、複雑なタスクにおける推論能力を飛躍的に向上させてきました。Weiら(2022年)の研究以降、数学的推論や常識推論において、GPT-4-o1やDeepSeek-R1といった最新のモデルが顕著な成果を収めています。これらのモデルは、単純なパターンマッチングを超えて、順序立てた中間ステップを生成することで最終的な回答に到達するパラダイムシフトを実現しました。しかし、この「思考するモデル」の成功には、膨大なトークン消費量と推論遅延という深刻なコスト問題が伴っています。リアルタイムの展開や大規模な運用において、この高い計算負荷は大きなボトルネックとなっており、効率的な推論手法の開発が急務となっています。 この課題に対し、推論ステップを短縮する手法や、中間ステップを潜在的なベクトル状態に圧縮して隠れた形で推論を行う「隠れ思考連鎖」の研究が進められてきました。先行研究では、言語的な冗長性が高いタスクにおいて、隠れ思考連鎖が一定の成果を収めることが示されています。…

核心:何を提案したのか

本研究の最大の貢献は、思考連鎖の圧縮における学習の困難さを「Order-r Interaction(r次相互作用)」という概念を用いて初めて理論的に定義した点にあります。推論プロセスにおける論理的依存関係の複雑さを定量化することで、中間ステップを省略した際にモデルが直面する「高次相互作用の障壁」を証明しました。具体的には、中間ステップを飛ばして直接的な依存関係を学習しようとすると、学習に必要な勾配信号が指数関数的に減衰し、推論パスがノイズの中に埋もれてしまうことを明らかにしました。この理論的発見は、なぜ数学のような厳密なステップを要するタスクで隠れ思考連鎖が失敗するのかを明確に説明しています。 この理論的知見に基づき、本論文では3つの主要な提案を行っています。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related