パラメーター微調整を超えて:ノード分類のためのテスト時表現洗練

グラフニューラルネットワーク(GNN)が未知のデータ分布(OOD)に直面した際の性能低下を解決するため、従来のモデルパラメーターを更新する手法(PaFT)に代わり、潜在的な表現のみを修正する新しいパラメーター効率的な学習フレームワーク「TTReFT」が提案されました。

TL;DR(結論)

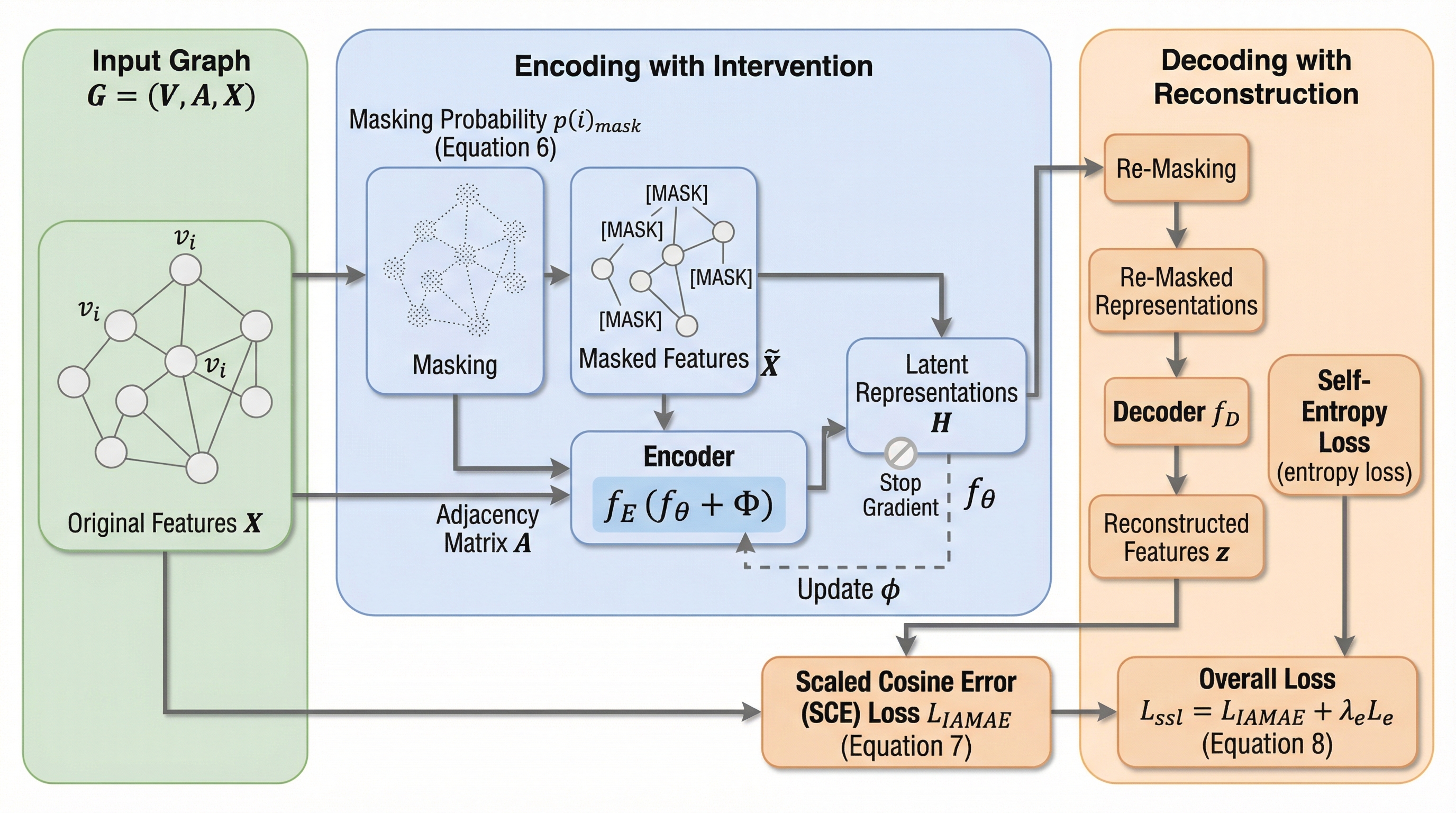

グラフニューラルネットワーク(GNN)が未知のデータ分布(OOD)に直面した際の性能低下を解決するため、従来のモデルパラメーターを更新する手法(PaFT)に代わり、潜在的な表現のみを修正する新しいパラメーター効率的な学習フレームワーク「TTReFT」が提案されました。 この手法は、予測の不確実性が高いノードを特定して選択的に介入し、低ランクの表現修正を適用することで、事前学習済みの知識を損なう「致命的な忘却」を防ぎながら、テストデータの分布に動的に適応することを可能にしています。 自己教師あり学習として、介入の密度に応じてマスク確率を調整する「介入認識型マスク自己符号化器(IAMAE)」を導入し、5つのベンチマークデータセットにおいて、従来のパラメーター微調整手法を上回る一貫した高い汎用性能と理論的な有効性が実証されました。

なぜこの問題か

グラフニューラルネットワーク(GNN)は、ソーシャルネットワーク分析や推薦システムなど、グラフ構造を持つデータの解析において大きな成功を収めてきました。しかし、多くのGNNモデルは、訓練データとテストデータが同じ分布に従うという「独立同一分布(IID)」の仮定に基づいています。現実のシナリオでは、ノードの特徴(属性の変化)やグラフの構造(ホモフィリの変化)において分布のシフトが発生することが多く、これが原因でモデルの性能が著しく低下するという課題がありました。この分布外(OOD)の課題に対処するため、データの拡張や敵対的訓練、因果的特徴学習などの手法が提案されてきましたが、これらは複数のドメインの訓練データを必要としたり、未知のテストデータに関する強い仮定に依存したりすることが多く、実用上の制約となっていました。 また、一部の手法では適応のためにテストデータの一部にラベルが必要な場合もあり、ラベルのない未知の環境への展開は困難でした。近年、テスト時のデータを用いてモデルを動的に適応させる「テスト時トレーニング(TTT)」が注目を集めています。…

核心:何を提案したのか

本研究では、従来のパラメーター微調整(PaFT)というパラダイムから脱却し、モデルの重みを完全に固定したまま潜在的な表現を修正する「テスト時表現洗練(TTReFT)」という新しいフレームワークを提案しています。これは、自然言語処理の分野で成功を収めている表現微調整(ReFT)の概念をグラフドメインに初めて導入し、グラフ特有の構造的性質に合わせて最適化したものです。TTReFTの核心は、事前学習済みのGNNモデルのパラメーターを一切変更せず、特定のノードの隠れ層の表現に対してのみ、軽量で学習可能な「介入」を適用する点にあります。これにより、モデルが持つ汎用的な知識を保護しつつ、テストデータの特定の分布シフトに対して局所的に最適化を行うことができます。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related