パラメータのファインチューニングを超えて:ノード分類のためのテスト時の表現の精緻化

グラフニューラルネットワーク(GNN)が未知のデータ分布に直面した際の性能低下を解決するため、モデルのパラメータを更新せずに潜在的な表現層のみを調整する新しい学習枠組み「TTReFT」が提案されました。

TL;DR(結論)

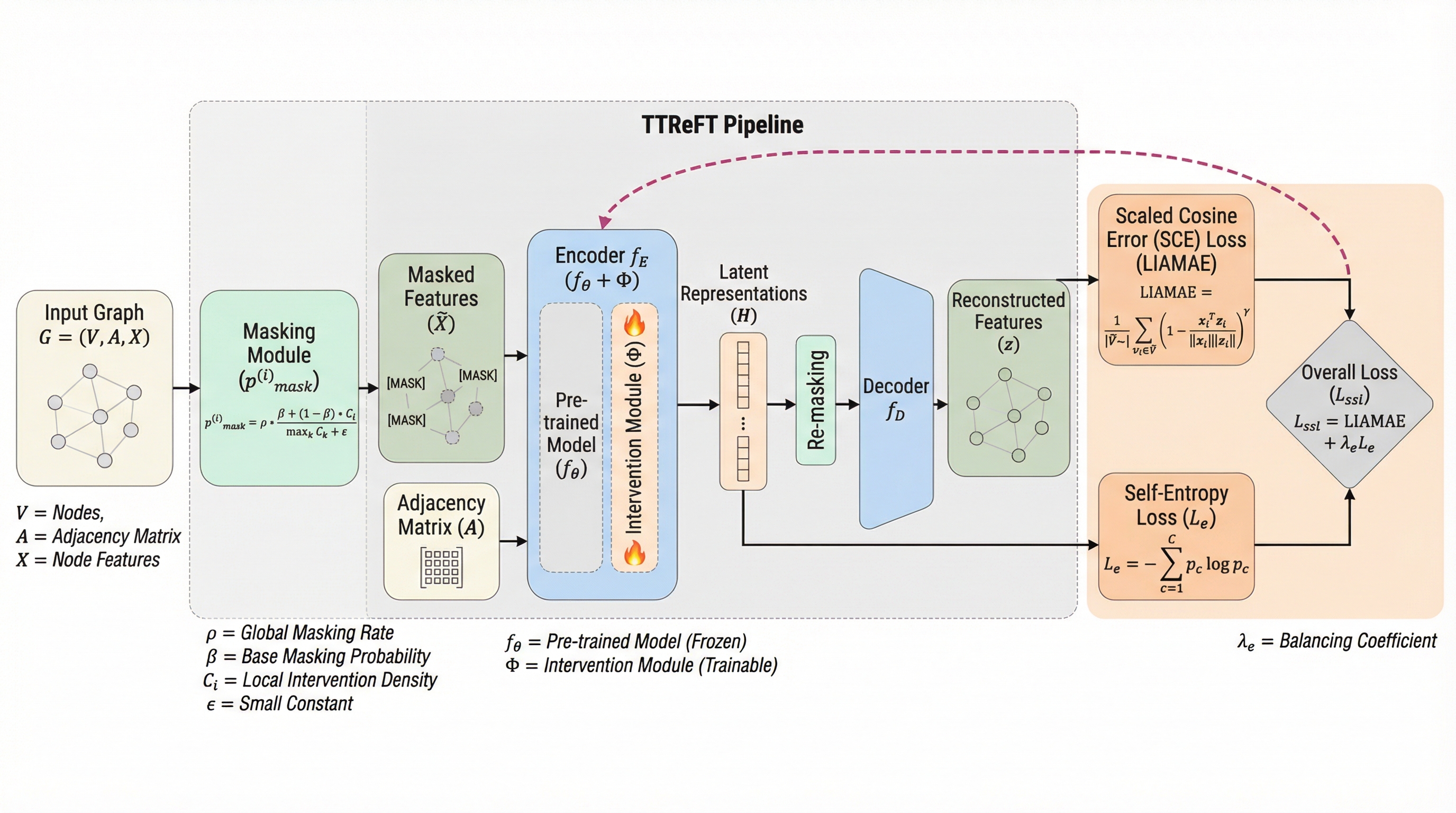

グラフニューラルネットワーク(GNN)が未知のデータ分布に直面した際の性能低下を解決するため、モデルのパラメータを更新せずに潜在的な表現層のみを調整する新しい学習枠組み「TTReFT」が提案されました。 この手法は、予測の不確実性が高いノードを特定して低ランクの介入を行う仕組みと、介入の密度に応じてマスクの確率を動的に変化させる自己教師あり学習タスクを組み合わせることで、従来の手法で課題となっていた学習済み知識の喪失を防ぎます。 5つのデータセットを用いた実験と理論的な解析により、分布の変化が生じる環境下でも高い汎用性能を維持しつつ、計算コストを大幅に削減しながら破滅的忘却を回避できることが実証されました。

なぜこの問題か

グラフニューラルネットワーク(GNN)は、ソーシャルネットワーク分析や推薦システムなど、グラフ構造を持つデータの解析において大きな成功を収めてきました。 しかし、多くのGNNモデルは、訓練データとテストデータが同じ分布に従うという「独立同一分布(IID)」の仮定に基づいて構築されています。 現実のシナリオでは、ノードの属性が変化したり、グラフの構造における同質性が変動したりすることで、この仮定が崩れる「分布外(OOD)」の状況が頻繁に発生します。 このような分布のシフトが生じると、モデルの性能は著しく低下し、実社会での応用を妨げる大きな要因となります。 これまでにも、訓練データを多様化させるデータ拡張や、摂動に対する不変性を高める敵対的訓練、因果関係に基づく特徴学習などが提案されてきました。 しかし、これらの手法の多くは、複数のドメインにわたる訓練データを必要としたり、未知のテストデータの特徴をシミュレートするために強い仮定を置いたりする必要があります。 中には、適応のためにテストデータの一部やラベルを必要とする手法もあり、これらは実際の運用環境では実現困難な場合が多いのが現状です。…

核心:何を提案したのか

本論文では、従来のパラメータ更新に依存する手法から脱却し、潜在的な表現空間での介入に焦点を当てた新しい枠組み「TTReFT(Test-Time Representation FineTuning)」を提案しています。 この枠組みの最大の特徴は、事前に学習されたモデルのパラメータを一切変更せずに凍結したまま、特定のノードの隠れ層の表現に対してのみ、軽量で学習可能な介入を行う点にあります。 自然言語処理の分野で成功を収めている表現精緻化の概念をグラフデータに導入し、モデル全体の重みを破壊することなく、効率的なノード単位の適応を実現しました。 TTReFTは、主に3つの革新的なコンポーネントで構成されています。 第一に、すべてのノードに対して無差別に介入するのではなく、予測の不確実性が高いノードを優先的に選択する「不確実性ガイド付きノード選択」を導入しました。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related