Bayesian-LoRA:大規模言語モデルの確率的低ランク適応

大規模言語モデル(LLM)の微調整において、従来のLoRAは決定論的であり、確信がない場合でも過剰に自信を持って予測を行う「不適合(miscalibration)」という課題があったが、本研究はこれを解決する。

TL;DR(結論)

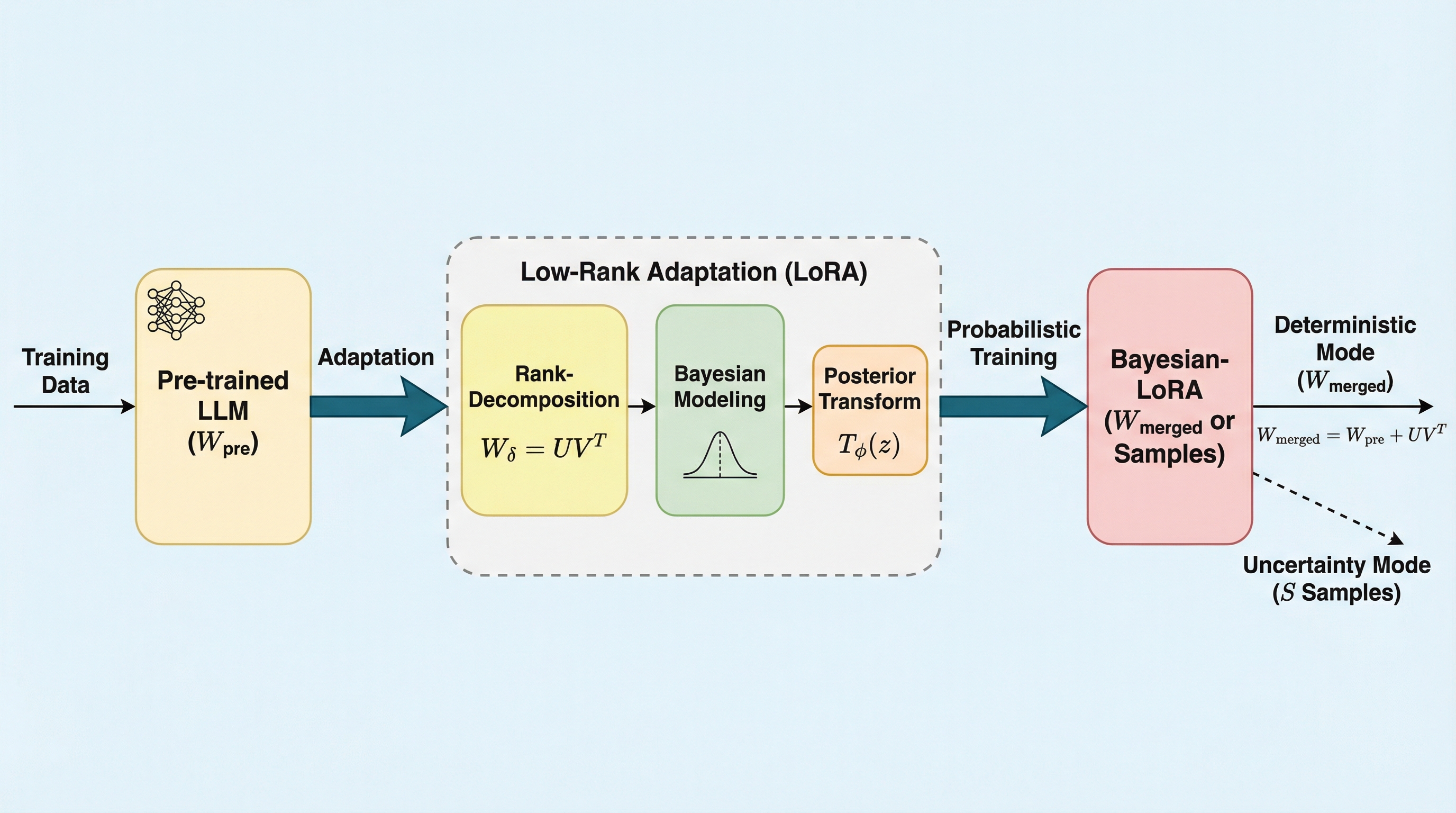

大規模言語モデル(LLM)の微調整において、従来のLoRAは決定論的であり、確信がない場合でも過剰に自信を持って予測を行う「不適合(miscalibration)」という課題があったが、本研究はこれを解決する。 提案手法のBayesian-LoRAは、稀疏ガウス過程(SGP)の理論を応用してLoRAの行列分解を確率的な低ランク表現へと再構成し、正規化流(Normalizing Flow)を用いることで、モデルの予測精度を維持しながら不確実性を適切に定量化する。 実験では30B規模のモデルまで適用可能であることを示し、標準的なLoRAと比較してわずかなパラメータ増加と計算コストで、較正誤差(ECE)を最大84%削減、負の対数尤度(NLL)を最大76%削減することに成功した。

なぜこの問題か

大規模言語モデル(LLM)を特定のタスクに適応させる際、LoRA(Low-Rank Adaptation)のようなパラメータ効率の良い微調整(PEFT)手法が標準的に用いられている。しかし、これらの手法は通常、予測の正確さのみを重視する決定論的な更新を行うため、モデルが自身の予測に対してどの程度確信を持っているかという「不確実性」を考慮できないという問題がある。特に、小規模なデータセットで微調整を行った場合、モデルは過学習を起こしやすく、実際には正解率が低い場面でも高い確率値を割り当ててしまう「過剰適合(miscalibration)」の傾向が顕著になる。このようなモデルの過信は、実社会の重要な意思決定の場面で深刻なリスクをもたらす。 例えば、自動運転における判断、医療診断の支援、あるいは法的な助言といった安全性が重視されるドメイン(safety-critical domains)において、モデルが「分からない」という状態を正しく表現できないことは致命的である。…

核心:何を提案したのか

本研究が提案する「Bayesian-LoRA」は、従来の決定論的なLoRAの更新式を、確率的なフレームワークへと拡張したものである。この提案の核心は、稀疏ガウス過程(Sparse Gaussian Process, SGP)における事後分布の構造と、LoRAの行列分解の間に「構造的同型性(structural isomorphism)」が存在するという発見にある。具体的には、SGPにおいて誘導変数(inducing variables)を用いた条件付き分布の平均が、LoRAの低ランク行列の積と同じ形式の双線形形式(bilinear form)をとることを特定した。この発見に基づき、Bayesian-LoRAはLoRAの重み更新を単なる固定値ではなく、確率分布として扱う。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related