ニューラルネットワーク学習のための自動的な安定性と回復

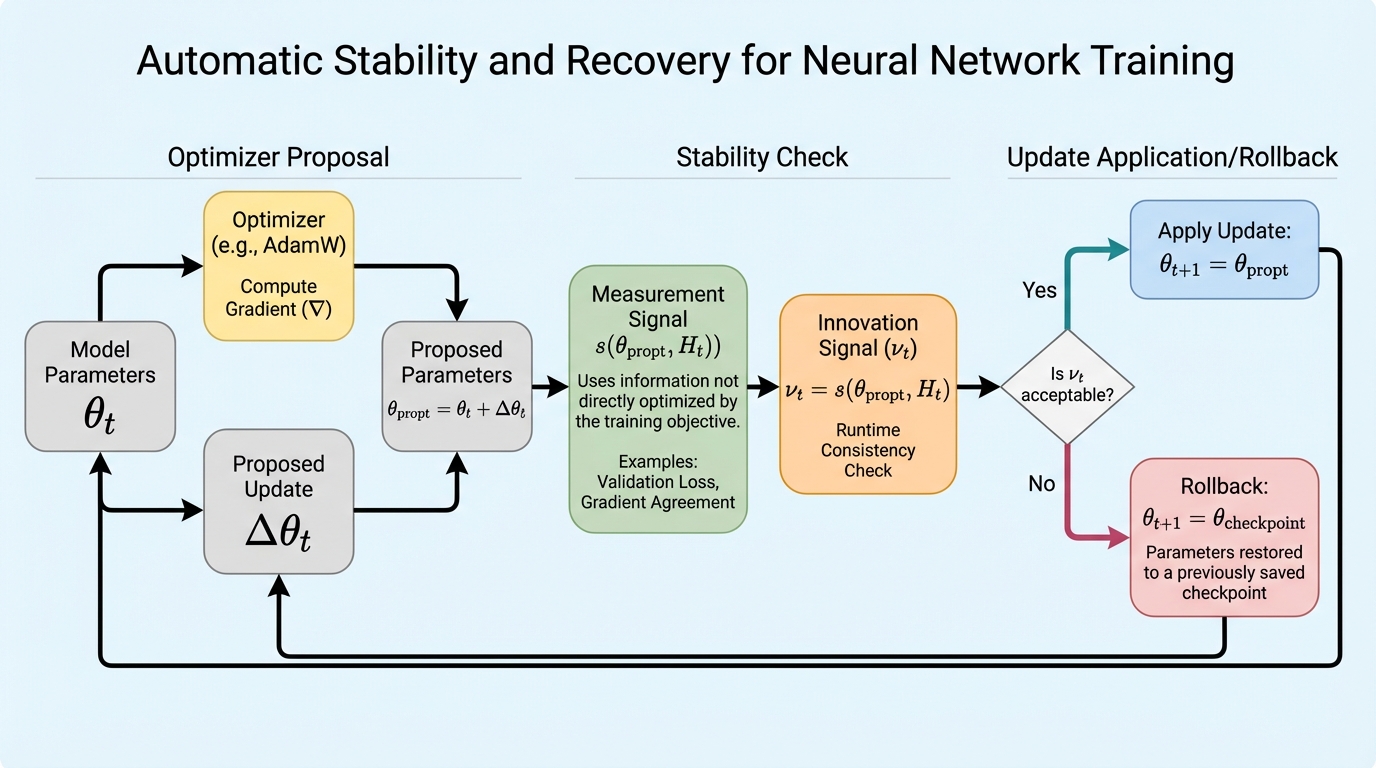

現代のニューラルネットワーク学習は非常に脆弱であり、稀に発生する深刻な不安定な更新が、回復不能な発散や静かな性能低下を引き起こすことが大きな課題となっている。既存の最適化手法は主にオプティマイザ内部に組み込まれた予防的なメカニズムに依存しており、一度不安定性が生じるとそれを検知して回復する能力が限られているため、計算資源の浪費や実験結果の不確実性を招く要因となっている。 本研究では、最適化を制御された確率過程として扱う監視型の実行時安定性フレームワークを提案し、バリデーションプローブなどの二次的な計測信号から導出される「イノベーション信号」を分離して利用することで、基底となるオプティマイザを変更することなく不安定な更新の自動検知と回復を可能にした。このフレームワークは、提案された更新が安定した学習動態と一致するかを評価し、異常が検知された場合には更新を拒否して以前の正常な状態へとロールバックする。 理論的には、有界な劣化と回復を定式化した実行時の安全保証を提供し、ResNet-18やTransformerを用いた実験において、標準的なパイプラインが失敗するような壊滅的な更新からも迅速に回復し、学習の発散を抑制して堅牢性を向上させることを実証した。この実装はメモリ制約のある環境にも対応しており、計算オーバーヘッドを最小限に抑えつつ、既存の多様なオプティマイザと組み合わせて使用できる実用的な制御レイヤーとして機能する。

TL;DR(結論)

現代のニューラルネットワーク学習は非常に脆弱であり、稀に発生する深刻な不安定な更新が、回復不能な発散や静かな性能低下を引き起こすことが大きな課題となっている。既存の最適化手法は主にオプティマイザ内部に組み込まれた予防的なメカニズムに依存しており、一度不安定性が生じるとそれを検知して回復する能力が限られているため、計算資源の浪費や実験結果の不確実性を招く要因となっている。 本研究では、最適化を制御された確率過程として扱う監視型の実行時安定性フレームワークを提案し、バリデーションプローブなどの二次的な計測信号から導出される「イノベーション信号」を分離して利用することで、基底となるオプティマイザを変更することなく不安定な更新の自動検知と回復を可能にした。このフレームワークは、提案された更新が安定した学習動態と一致するかを評価し、異常が検知された場合には更新を拒否して以前の正常な状態へとロールバックする。 理論的には、有界な劣化と回復を定式化した実行時の安全保証を提供し、ResNet-18やTransformerを用いた実験において、標準的なパイプラインが失敗するような壊滅的な更新からも迅速に回復し、学習の発散を抑制して堅牢性を向上させることを実証した。この実装はメモリ制約のある環境にも対応しており、計算オーバーヘッドを最小限に抑えつつ、既存の多様なオプティマイザと組み合わせて使用できる実用的な制御レイヤーとして機能する。

なぜこの問題か

ニューラルネットワークの学習において、モデルのパラメータを更新する過程は非常に繊細なバランスの上に成り立っている。近年の深層学習の進展により、最適化アルゴリズムやモデルアーキテクチャ、大規模なインフラストラクチャは大きく進化したものの、依然として学習の途中で突然モデルが崩壊したり、性能が著しく低下したりする現象が頻繁に観察される。このような不安定性は、特定のミニバッチに含まれる外れ値や、一時的な数値的不安定性、あるいはデータの分布が急激に変化することによって引き起こされる。たった一度の病的な更新が、それまでの膨大な計算資源を投じて得られた学習の軌跡を修復不可能なほどに破壊してしまうことがあり、これは研究者や実務家にとって極めて深刻な問題である。 既存の対策の多くは、オプティマイザの内部に組み込まれた予防的なメカニズムに焦点を当てている。例えば、モーメンタムを用いた勾配の平滑化や、Adamに代表される適応的な学習率の調整、あるいは勾配クリッピングといった手法が一般的に用いられている。これらの手法は、不安定性が発生する確率を下げるという点では一定の効果を発揮するが、本質的には「局所的」かつ「予防的」なアプローチに留まっている。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related