AgenticSimLaw:説明可能な意思決定のための法廷シミュレーション型マルチエージェント

AgenticSimLawは、検察官、弁護人、裁判官という明確な役割を持つエージェントが法廷形式で議論を行うマルチエージェント・フレームワークであり、ブラックボックス化しがちなAIの意思決定プロセスを透明化し、監査可能なものにすることを目指している。

TL;DR(結論)

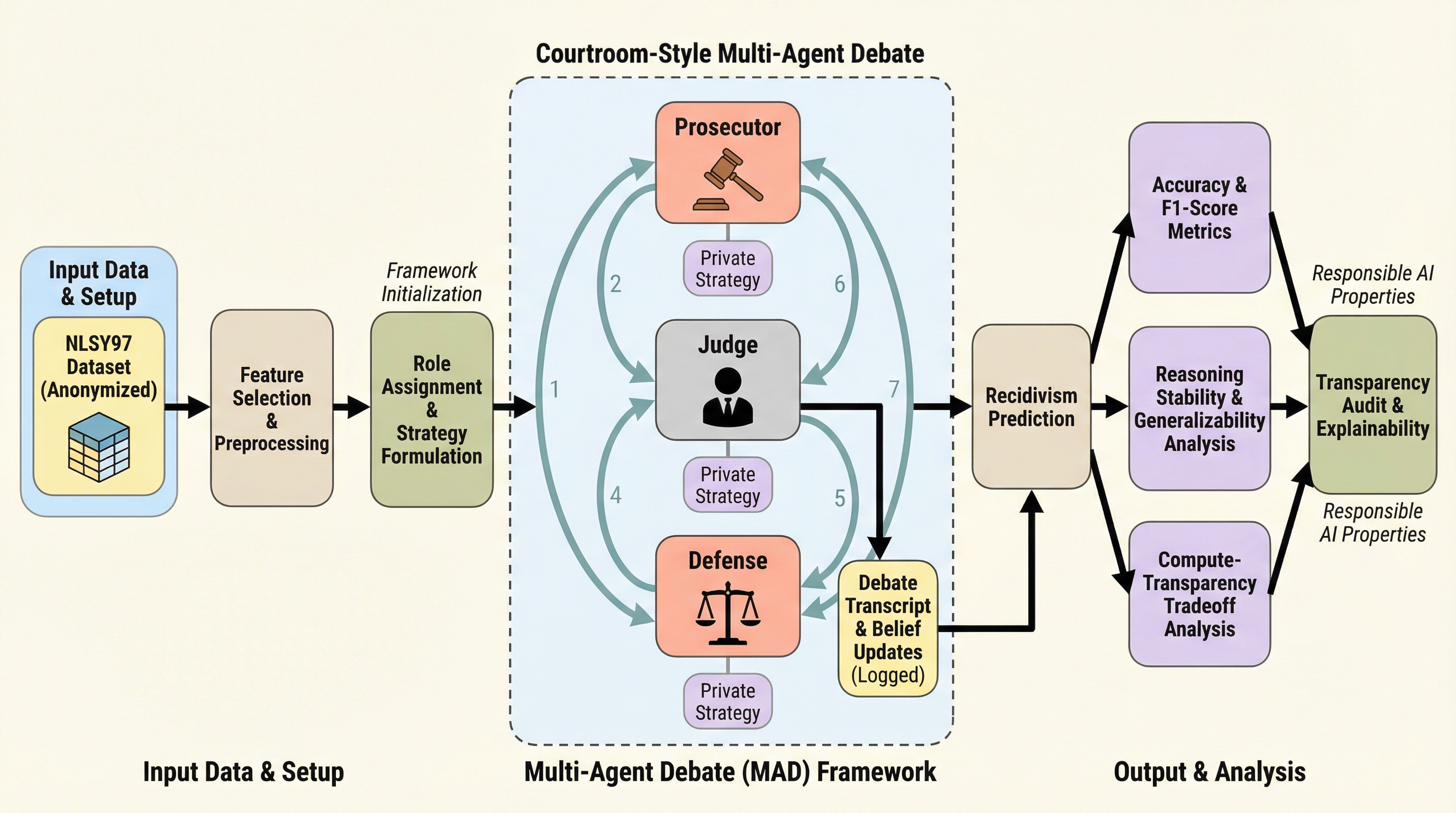

AgenticSimLawは、検察官、弁護人、裁判官という明確な役割を持つエージェントが法廷形式で議論を行うマルチエージェント・フレームワークであり、ブラックボックス化しがちなAIの意思決定プロセスを透明化し、監査可能なものにすることを目指している。このシステムは、若年成人の再犯予測という倫理的に複雑で高度な判断が求められるタスクにおいて、従来の単一エージェントによる推論よりも安定した性能と高い汎用性を示し、特に正確性とF1スコアの間に強い相関関係があることが確認された。7ターンの構造化された対話プロトコルを通じて、各エージェントの非公開の思考戦略と公開の主張、そして裁判官の確信度の推移をすべて記録することで、人間が意思決定の根拠を詳細に追跡し、バイアスや誤りを確認できる説明可能なAIとしての基盤を提供している。

なぜこの問題か

2017年のTransformerアーキテクチャの導入以来、AIの進歩は計算資源とデータのスケーリングによって加速してきたが、最先端モデルのトレーニングコストが1億ドルを超えるなど、性能向上の飽和状態が指摘されている。これに伴い、推論時の計算量、いわゆる「テストタイム・コンピューティング」を活用して複雑な推論タスクを解決する手法が注目されるようになった。しかし、大規模言語モデル(LLM)は線形なテキストの処理には長けているものの、表形式のデータ(タブラデータ)に含まれる複雑で非順序的な依存関係を捉えることには苦慮するという課題がある。また、司法判断や医療診断、信用評価といった高いリスクを伴うドメインにおいて、AIの意思決定プロセスが「ブラックボックス」であることは大きな問題である。 過去にはCOMPASのような再犯予測アルゴリズムにおいて、人種的な偏りがあることが指摘され、AIの透明性と公平性、そして監査可能性の欠如が批判の対象となってきた。具体的には、黒人が白人よりも再犯リスクが高いと誤って判定される確率が2倍近いという報告もあり、こうしたバイアスは社会的な信頼を損なう。…

核心:何を提案したのか

本論文は、役割構造化されたマルチエージェント討論フレームワークである「AgenticSimLaw」を提案している。これは、検察官、弁護人、裁判官という3つの明確な役割を定義し、7ターンの構造化された対話プロトコルを通じて意思決定を行う仕組みである。従来の単一エージェントによるChain-of-Thought(CoT)推論とは異なり、エージェント間の対立的な議論を外部化することで、推論の各ステップを完全に監査可能にしている。このフレームワークの最大の特徴は、各エージェントが公開の主張を行う前に、非公開の推論戦略(内部モノローグ)を策定する点にある。これにより、エージェントがどのような意図を持って特定の事実を強調し、あるいは反論しているのかを記録することができる。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related