エージェンティックな提案:構成的スキル合成による大規模言語モデルの推論の強化

大規模言語モデルの複雑な推論能力を向上させるためには、高品質かつ検証可能な学習データセットが不可欠ですが、人間によるアノテーションはコストが極めて高く、大規模な拡張が困難であるという深刻な課題に直面しています。

TL;DR(結論)

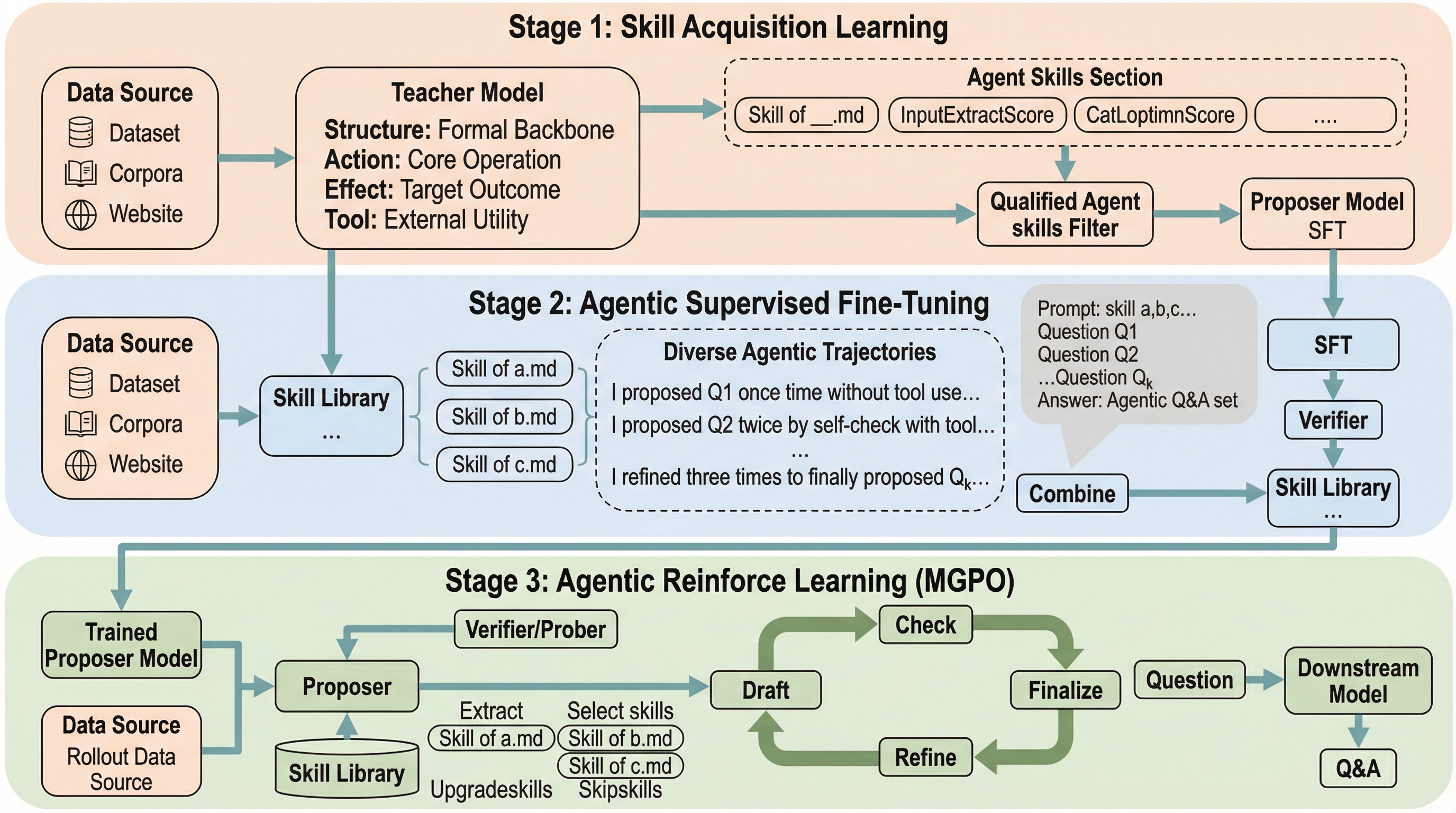

大規模言語モデルの複雑な推論能力を向上させるためには、高品質かつ検証可能な学習データセットが不可欠ですが、人間によるアノテーションはコストが極めて高く、大規模な拡張が困難であるという深刻な課題に直面しています。 本研究で提案された「Agentic Proposing」は、問題の合成を目標主導型の逐次意思決定プロセスとして捉え、専門のエージェントがモジュール化された推論スキルを動的に組み合わせて複雑な問題を生成する革新的なフレームワークです。 この手法を用いて生成されたわずか11,000件の高品質な合成データで学習した30B規模のモデルは、数学の難問集であるAIME25において91.6%という最高水準の精度を記録し、GPT-5やClaude-4.5-Opusといった巨大な商用モデルに匹敵する性能を証明しました。

なぜこの問題か

大規模言語モデル(LLM)の推論能力、特に数学やプログラミング、科学といった高度な領域における能力を向上させることは、現在のAI研究における中心的なフロンティアとなっています。OpenAI o1の登場やDeepSeek-Mathの成功により、強化学習が推論能力を引き出すための強力な手段であることが示されましたが、これらの手法は検証可能な環境からのフィードバックに根本的に依存しています。つまり、高品質で難易度が高く、かつ正誤が客観的に判定できる大量の問題データが必要とされているのです。しかし、このような問題を人間が作成し、アノテーションを行うには膨大なコストがかかり、スケールさせることは極めて困難です。 既存のデータ合成手法には、大きなトレードオフが存在していました。MetaMathやWizardMathのように既存の問題を書き換えたり進化させたりする手法は、データの規模を拡大することには成功しましたが、人間が設計したテンプレートや固定された構造に依存しているため、新しい複雑な推論の組み合わせを自律的に探索することができません。…

核心:何を提案したのか

本論文の核心は、問題合成を目標主導型の逐次意思決定プロセスとしてモデル化する「Agentic Proposing」というフレームワークの提案にあります。このフレームワークでは、専門の提案エージェントが、モジュール化された「推論スキル」を動的に選択し、それらを組み合わせることで複雑な問題を構築します。これは、従来の静的なプロンプトによる生成とは異なり、エージェントが内部的な内省(Reflection)と外部ツールの使用を繰り返しながら、論理的に健全で、かつ難易度が精密に調整された問題を生成する「クローズドループ」なプロセスです。 具体的には、推論の論理を「Composable Agent Skills」と呼ばれる原子的なモジュールに分解しました。…

続きはログイン/プランで閲覧できます。

続きを読む

ログインで全文を月 2 本まで無料で読めます

無料プランで全文は月 2 本まで読めます。

Related